AI实战训练营(Class 4)MMPretrain

MMPreTrain 算法库

算法库与任务组成

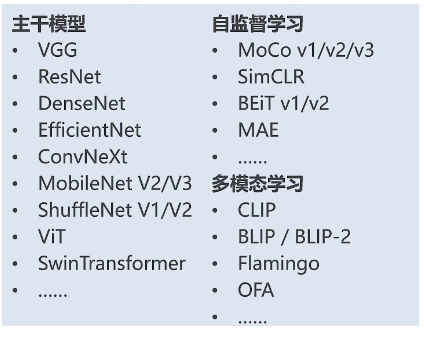

- 支持多样的主干网络与预训练模型

- 支持多种训练策略(有监督学习,无监督学习,多模态学习等)

- 提供多种训练技巧

- 大量的训练配置文件

- 高效率和高可扩展性

- 功能强大的工具箱,有助于模型分析和实验

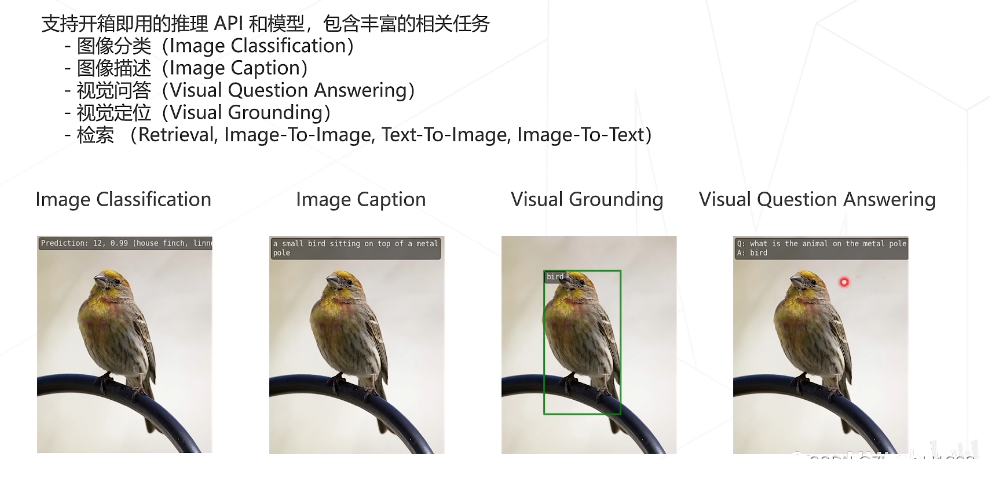

- 支持多种开箱即用的推理任务

- 图像分类

- 图像描述(Image Caption)

- 视觉问答(Visual Question Answering)

- 视觉定位(Visual Grounding)

- 检索(图搜图,图搜文,文搜图)

Python推理API

经典主干网络

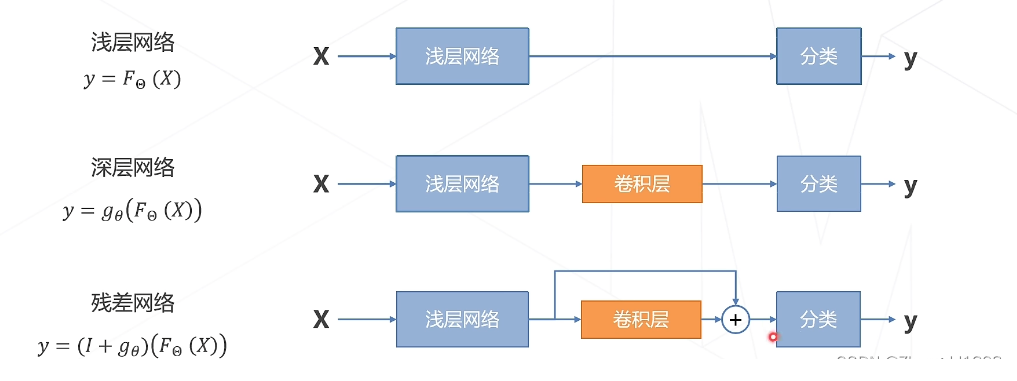

ResNet

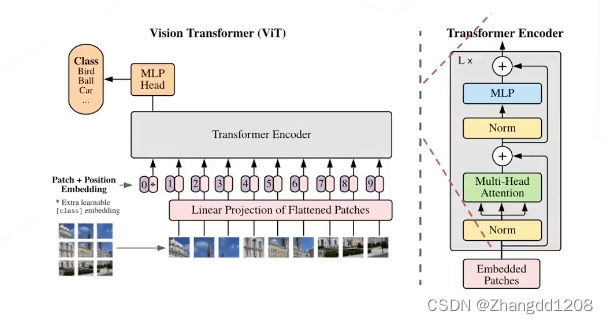

Vision Transformer

- 将图片切成若干16X16的小块,所有块排成词向量,先经过线形层映射,一张[H,W,C]的维度的图片变成[L,C],在经过多层Transformer Encoder的计算产生相应的特征向量。

- 图块之后加入额外的token,用于query其他patch得特征并给出最后的分类

- 注意力模块基于全局感受野,复杂度为尺寸的4次方

注意力Attention Mechanism

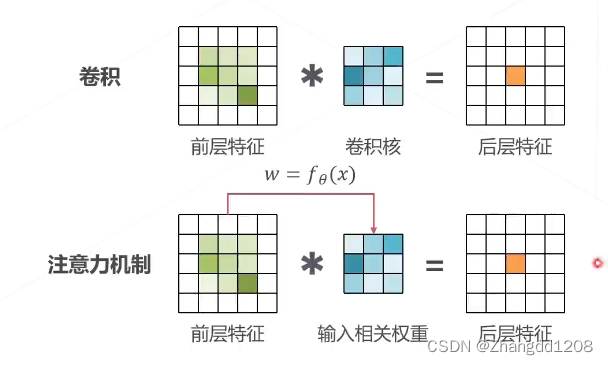

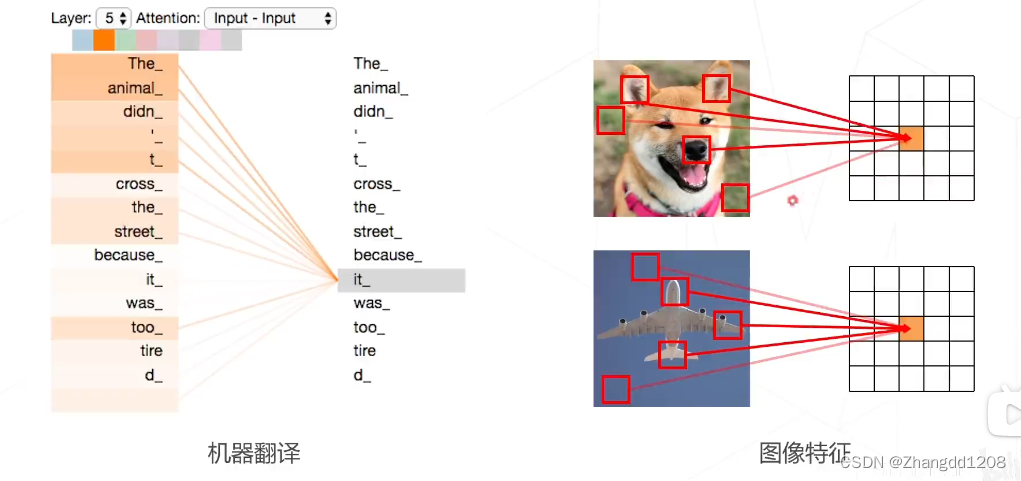

- 实现层次化特征:后层次化是空间领域内的前层特征的加权求和,权重越大,对应位置特征越重要

- 权重是可以学习的参数,但是与输入无关,只能建模局部关系,远距离关系只能通过多层卷积实现。

权重是输入的函数,与输入有关,可以不局限于领域,显式建模远距离关系。

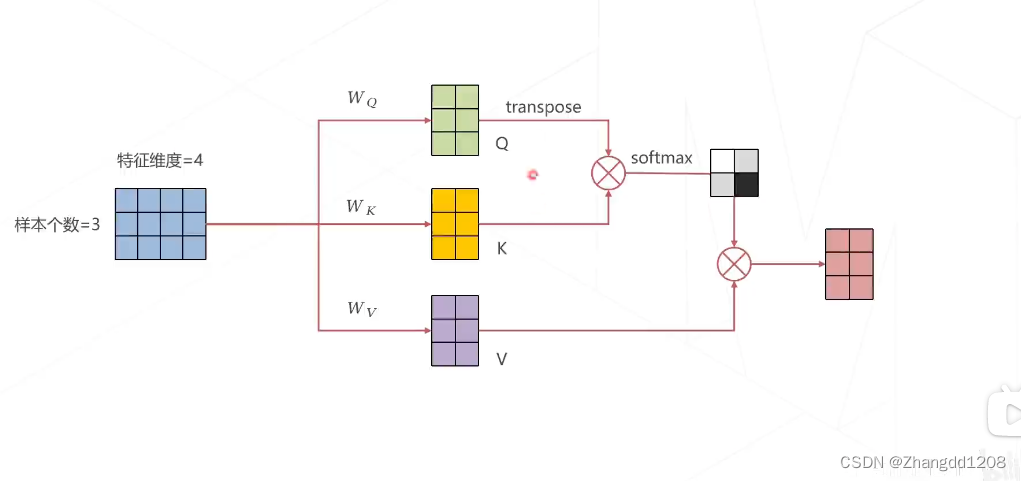

self Attention

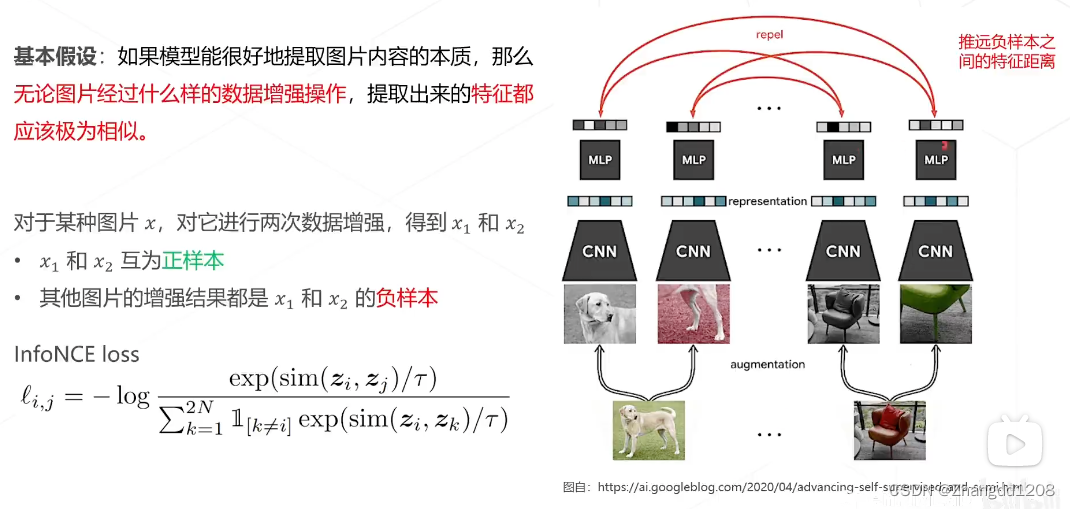

自监督

SimCLR

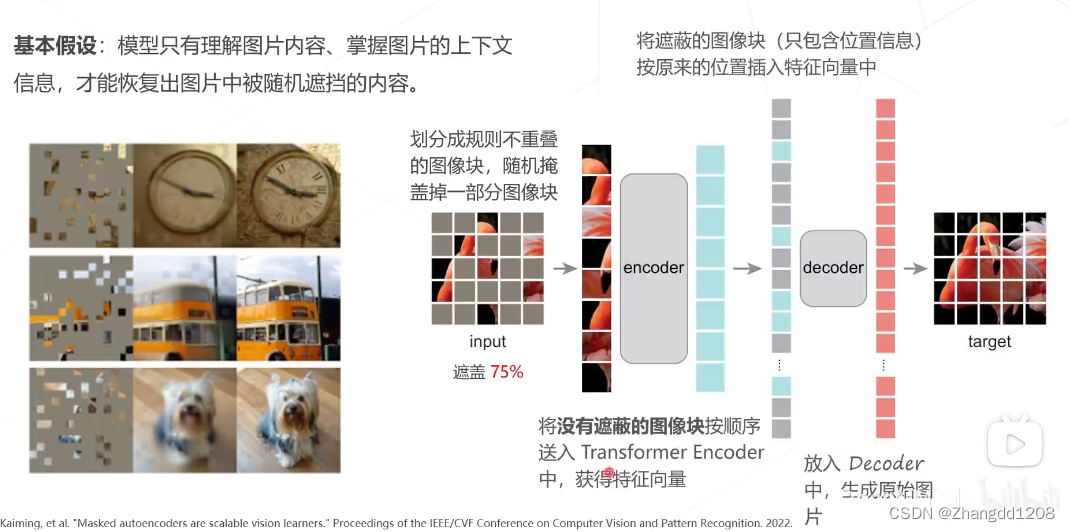

MAE

多模态算法

CLIP(双流网络)

MMPreTrain是一个算法库,支持多种主干网络如ResNet和VisionTransformer,采用无监督、有监督及多模态学习策略。它提供丰富的训练配置,适用于图像分类、图像描述、视觉问答等任务。此外,库中包含自监督方法如SimCLR和MAE,以及多模态算法如CLIP和BLIP,致力于提升模型的分析和实验能力。

MMPreTrain是一个算法库,支持多种主干网络如ResNet和VisionTransformer,采用无监督、有监督及多模态学习策略。它提供丰富的训练配置,适用于图像分类、图像描述、视觉问答等任务。此外,库中包含自监督方法如SimCLR和MAE,以及多模态算法如CLIP和BLIP,致力于提升模型的分析和实验能力。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?