朴素贝叶斯(naive Byes)法是基于贝叶斯定理与特征条件独立假设的分类方法。对于给定的训练数据集,首先基于特征条件独立于假设学习输入/输出的联合概率分布;然后基于此模型,对给定的输入x,利用贝叶斯定理求出后验概率最大输出y。朴素贝叶斯方法实现很很简单,学习与预测效率都很高,是一种常用的方法。

朴素贝叶斯法的学习与分类

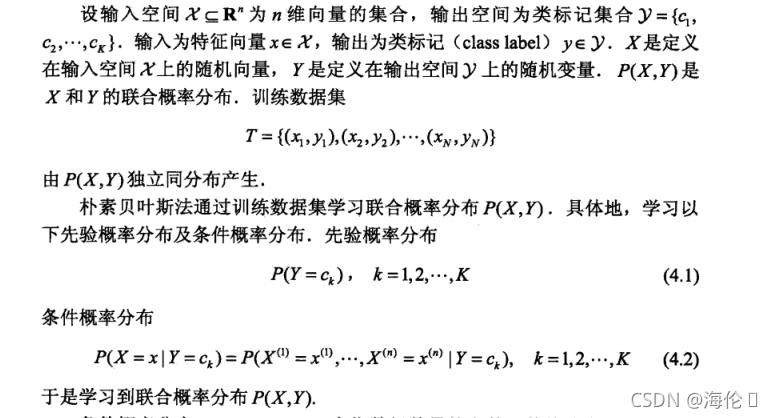

基本方法:

后验证概率最大化含义

朴素贝叶斯法将实例分到后验概率最大的类中,这等价于期望风险最小化。为了使得风险最小化对X = x逐个及小化,根据期望风险最小化准则就得到后验概率最大化准则,即朴素贝叶斯法所采用的原理。

朴素贝叶斯法的参数估计

极大似然估计

在贝叶斯法中,学习意味着估计,可以利用极大似然估计法估计相应的概率。

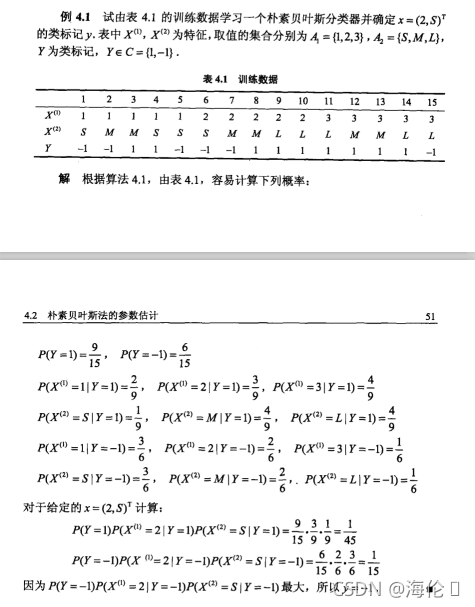

学习与分类算法

朴素贝叶斯法的学习与分类算法例题:

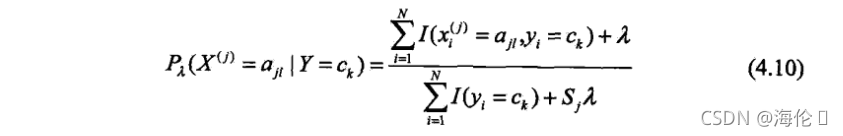

贝叶斯估计

用极大似然估计可能会出现所要估计的概率值为0的情况,这时会影响到后验概率的结算结果,使分类产生偏差。解决这一个问题就是采用贝叶斯估计。具体得,条件概率的贝叶斯估计是:

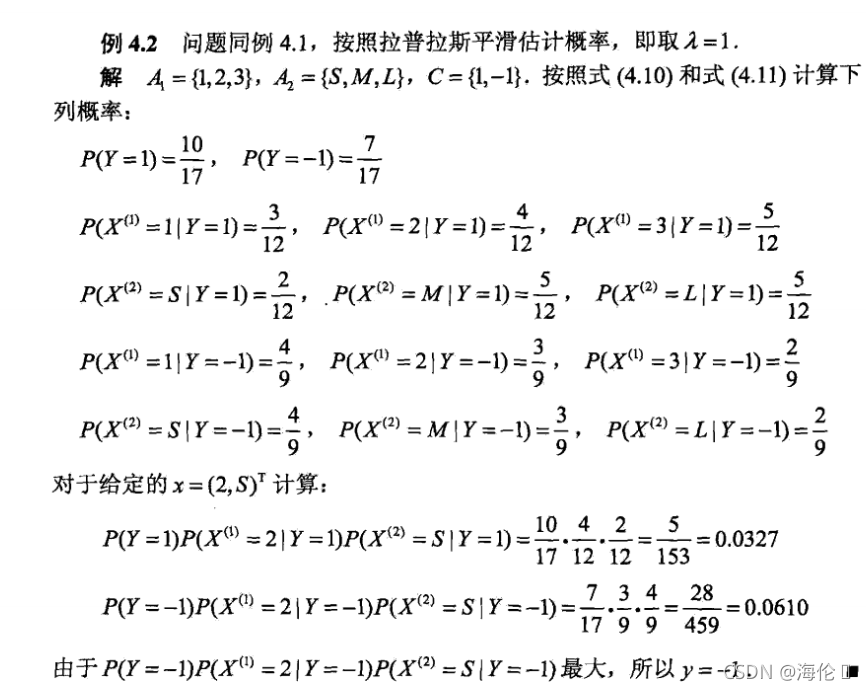

例题:

总结:

- 朴素贝叶斯法是典型的生成学习方法。生成方法由训练数据学习联合概率分布P(X,Y),然后求得后验概率分布P(X|Y)。具体来说,利用训练数据学习P(X|Y)和P(Y)的估计,得到联合概率分布。

- 朴素贝叶斯法的基本假设是条件独立性,这是一个较强的假设。由于这一假设,模型包含的条件概率的数量大为减少,朴素贝叶斯法的学习与预测大为简化。因而朴素贝叶斯法高效,且易于实现。其缺点是分类的性能不一定很高。

- 朴素贝叶斯法利用贝叶斯定理与学到的联合概率模型进行分类预测。

朴素贝叶斯法是一种基于贝叶斯定理和特征条件独立假设的分类方法。它通过极大似然估计来学习输入/输出的联合概率分布,并利用贝叶斯定理进行后验概率最大化分类。尽管其假设条件独立可能导致性能不足,但因其简单高效而被广泛应用。在遇到概率为0的问题时,通常采用贝叶斯估计来修正。该方法是生成学习的一种,学习联合概率分布并进行预测。

朴素贝叶斯法是一种基于贝叶斯定理和特征条件独立假设的分类方法。它通过极大似然估计来学习输入/输出的联合概率分布,并利用贝叶斯定理进行后验概率最大化分类。尽管其假设条件独立可能导致性能不足,但因其简单高效而被广泛应用。在遇到概率为0的问题时,通常采用贝叶斯估计来修正。该方法是生成学习的一种,学习联合概率分布并进行预测。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?