基于YOLOv8模型的海洋生物目标检测系统(PyTorch+Pyside6+YOLOv8模型)(含源码+模型+可修改)

简介: 基于YOLOv8模型的海洋生物目标检测系统可用于日常生活中检测与定位海洋生物目标,利用深度学习算法可实现图片、视频、摄像头等方式的目标检测,另外本系统还支持图片、视频等格式的结果可视化与结果导出。本系统采用YOLOv8目标检测算法训练数据集,使用Pysdie6库来搭建前端页面展示系统。另外本系统支持的功能还包括训练模型的导入、初始化;检测置信分与检测后处理IOU阈值的调节;图像的上传、检测、可视化结果展示与检测结果导出;视频的上传、检测、可视化结果展示与检测结果导出;摄像头的图像输入、检测与可视化结果展示;已检测目标个数与列表、位置信息;前向推理用时等功能。为科研人员、海洋生物观察者或其他相关用户提供了一站式的海洋生物目标识别解决方案,满足从单张图片分析到实时视频监控等多种应用场景的需求。

1. 基本介绍

1、模型训练与导入:

使用 YOLOv8(You Only Look Once version 8)目标检测模型进行深海鱼数据集的训练。YOLOv8 因其高效的速度和准确度而受到青睐。

训练好的模型可以以 ONNX 或 PyTorch(PT)格式导出,方便在不同的平台和框架上部署。

用户可以通过系统界面上传并导入自己的训练模型,实现模型的初始化。

2、图像、视频和摄像头检测:

图像检测:用户可以通过页面上传单张或多张图片,系统使用已训练的模型对图片中的深海鱼进行检测,并将结果可视化展示在页面上。

视频检测:系统支持上传视频文件,对视频帧进行逐帧检测,并将每帧的检测结果进行可视化处理,最终生成一个带有检测框的视频。

摄像头检测:系统可以通过连接摄像头进行实时检测,将摄像头捕获的画面中的深海鱼实时标记并展示在界面上。

3、检测结果的可视化与导出:

检测结果可以通过界面以图像或视频的形式展示给用户,同时提供检测结果图片的下载或视频导出功能。

用户可以根据需要调整置信分和 IOU(Intersection over Union,交并比)阈值,以过滤掉低于某个阈值的检测结果。

4、前向推理用时:

系统会记录每次检测的前向推理时间,即模型处理每张图片或视频帧所需的时间,这对于评估模型性能和优化系统非常重要。

5、界面与交互:

使用 Pyside6(或类似的库如 PyQt5/6、Tkinter 等)来搭建用户友好的图形界面,提供直观的操作体验。

界面设计应包含文件上传、参数设置、结果显示等必要的交互元素。

6、已检测目标列表与位置信息:

系统会维护一个已检测目标的列表,记录每个目标的类别、置信度、位置(如边界框的坐标)等信息。

用户可以通过列表查看和管理已检测到的深海鱼目标。

7、扩展性与灵活性:

系统应设计为可扩展和灵活,支持不同格式模型的导入和多种类型输入数据的检测。

提供 API 接口,方便与其他系统或平台进行集成。

2.安装环境及运行

(1)下载完整文件到自己电脑上,然后使用cmd打开到文件目录

(2)利用Conda创建环境(Anacodna),conda create -n yolo8 python=3.8 ;使用

pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple安装依赖包;

(3)安装Pyside6库

pip install pyside6==6.3 -i https://pypi.tuna.tsinghua.edu.cn/simple3.YOLOV8算法原理

YOLOv8 是 ultralytics 公司在 2023 年 1月 10 号开源的 YOLOv5 的下一个重大更新版本,目前支持图像分类、物体检测和实例分割任务,鉴于Yolov5的良好表现,Yolov8在还没有开源时就收到了用户的广泛关注YOLOv8是一种先进的深度学习模型,专为实现高效准确的目标检测而设计。其核心思想是将目标检测任务视为一个回归问题,通过单一的前向传播过程直接预测出图像中物体的类别和位置。

3.1 数据集介绍

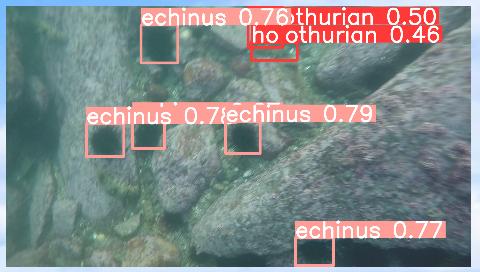

使用的海洋生物数据集手动标注了海胆、海参、扇贝和海星这四个类别(海胆:echinus,海参:holothurian,扇贝:scallop,海星:starfish),数据集总计6575张图片。该数据集中类别都有大量的旋转和不同的光照条件,有助于训练出更加鲁棒的检测模型。本文实验的海洋生物检测识别数据集包含训练集5260张图片,验证集1315张图片,选取部分数据部分样本数据集如下图所示。此外,为了增强模型的泛化能力和鲁棒性,我们还使用了数据增强技术,包括随机旋转、缩放、裁剪和颜色变换等,以扩充数据集并减少过拟合风险。

|

|

|

|---|---|

|

|

|

3.2 YOLOV8算法原理

yolov8的整体架构如下:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?