复习回顾:

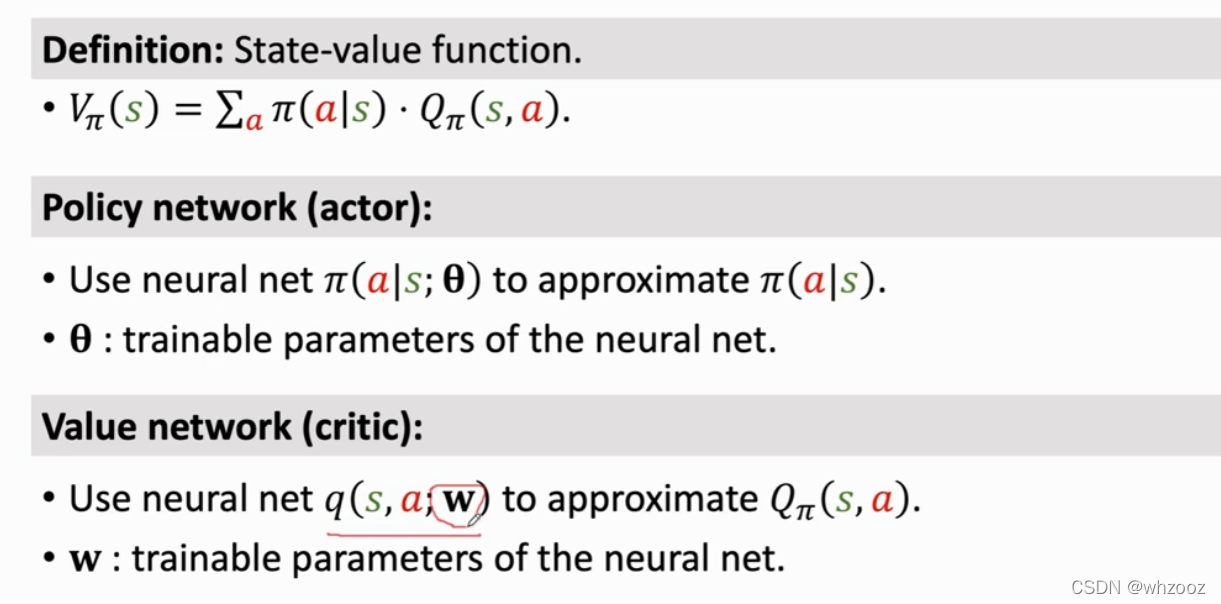

![]() 是动作价值函数

是动作价值函数![]() 的期望,如果动作是离散的,则是图中连加的形式,如果动作是连续的,则会是积分形式。

的期望,如果动作是离散的,则是图中连加的形式,如果动作是连续的,则会是积分形式。![]() 是策略函数,可以计算动作的概率值,从而控制agent做运动,

是策略函数,可以计算动作的概率值,从而控制agent做运动,![]() 是动作价值函数,可以评价动作的好坏程度。可惜策略函数和

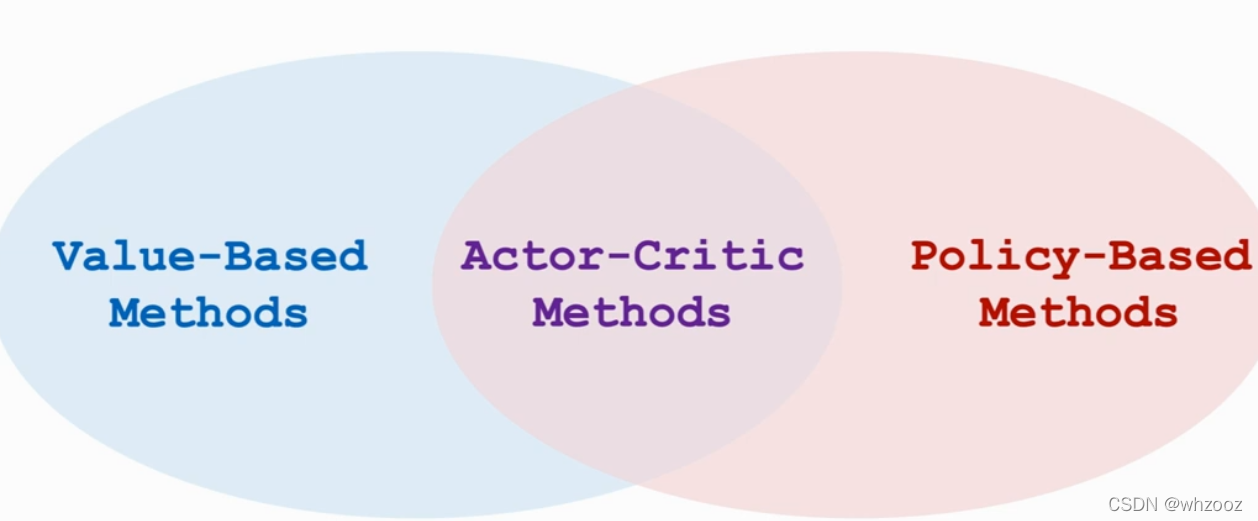

是动作价值函数,可以评价动作的好坏程度。可惜策略函数和![]() 都不知道,于是需要用两个神经网络分别近似这两个函数,再用Actor-Critic方法同时学习这两个神经网络。

都不知道,于是需要用两个神经网络分别近似这两个函数,再用Actor-Critic方法同时学习这两个神经网络。

我们可以用策略网络![]() 来近似策略函数

来近似策略函数![]() ,θ为策略网络的参数。我们用策略网络控制agent做运动,决策是由策略网络做的,所以策略网络也叫actor。相当于运动员。

,θ为策略网络的参数。我们用策略网络控制agent做运动,决策是由策略网络做的,所以策略网络也叫actor。相当于运动员。

用另一个神经网络![]() 来近似价值函数

来近似价值函数![]() ,这里的w是神经网络的参数,即价值神经网络,这里的价值网络不控制agent的运动,只是给动作打分而已,所以被称为critic。相当于裁判。

,这里的w是神经网络的参数,即价值神经网络,这里的价值网络不控制agent的运动,只是给动作打分而已,所以被称为critic。相当于裁判。

所以最后可以写成:

![]()

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?