第三章 模型搭建和评估-评估

根据之前的模型的建模,我们知道如何运用sklearn这个库来完成建模,以及我们知道了的数据集的划分等等操作。那么一个模型我们怎么知道它好不好用呢?以至于我们能不能放心的使用模型给我的结果呢?那么今天的学习的评估,就会很有帮助。

加载下面的库

import pandas as pd

import numpy as np

import seaborn as sns

import matplotlib.pyplot as plt

from IPython.display import Image

from sklearn.linear_model import LogisticRegression

from sklearn.ensemble import RandomForestClassifier

%matplotlib inline

plt.rcParams['font.sans-serif'] = ['SimHei'] # 用来正常显示中文标签

plt.rcParams['axes.unicode_minus'] = False # 用来正常显示负号

plt.rcParams['figure.figsize'] = (10, 6) # 设置输出图片大小

任务:加载数据并分割测试集和训练集

from sklearn.model_selection import train_test_split

# 一般先取出X和y后再切割,有些情况会使用到未切割的,这时候X和y就可以用,x是清洗好的数据,y是我们要预测的存活数据'Survived'

data = pd.read_csv('clear_data.csv')

train = pd.read_csv('train.csv')

X = data

y = train['Survived']

# 对数据集进行切割

X_train, X_test, y_train, y_test = train_test_split(X, y, stratify=y, random_state=0)

# 默认参数逻辑回归模型

lr = LogisticRegression()

lr.fit(X_train, y_train)

模型评估

- 模型评估是为了知道模型的泛化能力。

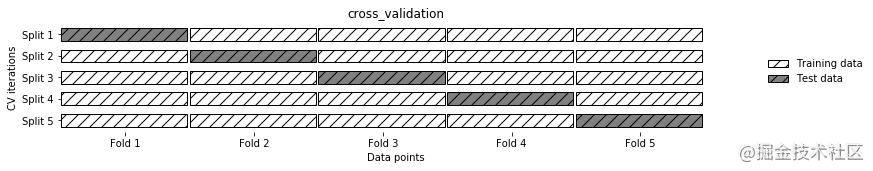

- 交叉验证(cross-validation)是一种评估泛化性能的统计学方法,它比单次划分训练集和测试集的方法更加稳定、全面。

- 在交叉验证中,数据被多次划分,并且需要训练多个模型。

- 最常用的交叉验证是 k 折交叉验证(k-fold cross-validation),其中 k 是由用户指定的数字,通常取 5 或 10。

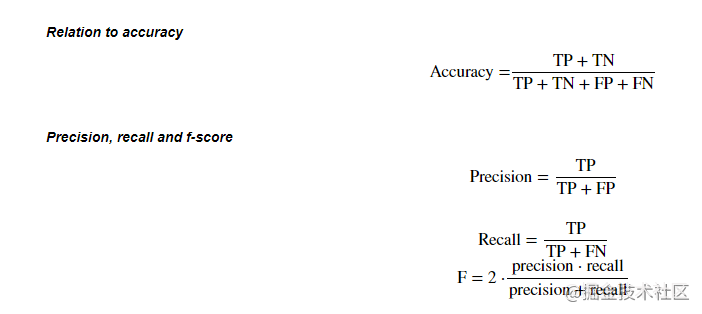

- 准确率(precision)度量的是被预测为正例的样本中有多少是真正的正例

- 召回率(recall)度量的是正类样本中有多少被预测为正类

- f-分数是准确率与召回率的调和平均

任务一:交叉验证

- 用10折交叉验证来评估之前的逻辑回归模型

- 计算交叉验证精度的平均值

交叉验证

提示4

- 交叉验证在sklearn中的模块为

sklearn.model_selection

from sklearn.model_selection import cross_val_score

lr = LogisticRegression(C=100)

scores = cross_val_score(lr, X_train, y_train, cv=10)

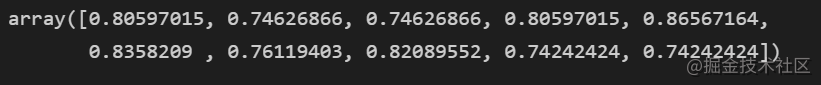

# k折交叉验证分数

scores

# 平均交叉验证分数

print("Average cross-validation score: {:.2f}".format(scores.mean()))

# Average cross-validation score: 0.79

思考4

- k折越多的情况下会带来什么样的影响?

思考回答:k折越多,平均误差被视为泛化误差这个结果就越可靠,但相应的所花费的时间也是线性增长的。

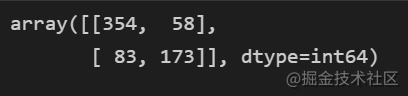

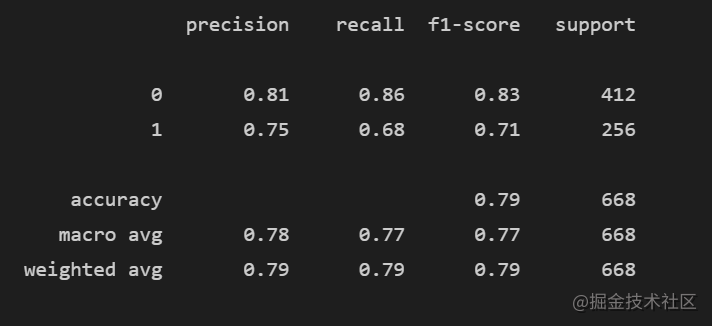

任务二:混淆矩阵

- 计算二分类问题的混淆矩阵

- 计算精确率、召回率以及f-分数

混淆矩阵

准确率 (Accuracy),精确度(Precision),Recall,f-分数计算方法

提示5

- 混淆矩阵的方法在sklearn中的

sklearn.metrics模块 - 混淆矩阵需要输入真实标签和预测标签

- 精确率、召回率以及f-分数可使用

classification_report模块

from sklearn.metrics import confusion_matrix

# 训练模型

lr = LogisticRegression(C=100)

lr.fit(X_train, y_train)

# 模型预测结果

pred = lr.predict(X_train)

# 混淆矩阵

confusion_matrix(y_train, pred)

from sklearn.metrics import classification_report

# 精确率、召回率以及f1-score

print(classification_report(y_train, pred))

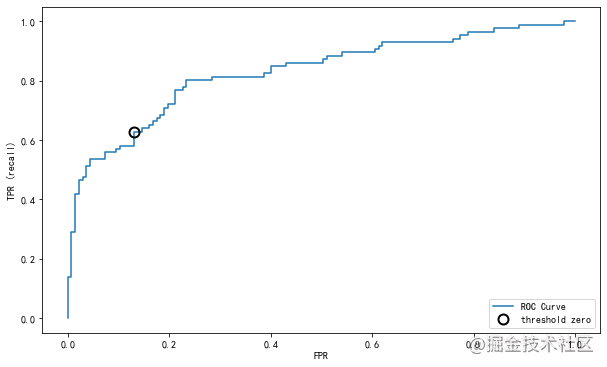

任务三:ROC曲线

- 绘制ROC曲线

【思考】什么是OCR曲线,OCR曲线的存在是为了解决什么问题?

提示6

- ROC曲线在sklearn中的模块为

sklearn.metrics - ROC曲线下面所包围的面积越大越好

from sklearn.metrics import roc_curve

fpr, tpr, thresholds = roc_curve(y_test, lr.decision_function(X_test))

plt.plot(fpr, tpr, label="ROC Curve")

plt.xlabel("FPR")

plt.ylabel("TPR (recall)")

# 找到最接近于0的阈值

close_zero = np.argmin(np.abs(thresholds))

plt.plot(fpr[close_zero], tpr[close_zero], 'o', markersize=10, label="threshold zero", fillstyle="none", c='k', mew=2)

plt.legend(loc=4)

思考6

- 对于多分类问题如何绘制ROC曲线

参考资料:多分类ROC曲线及AUC计算

【思考】你能从这条OCR曲线的到什么信息?这些信息可以做什么?

- 一个ROC曲线完全”包住“另一个ROC曲线—>第一个学习器效果更好

- 两个ROC曲线相交—>利用ROC曲线下的面积(AUC,area under ROC curve,是一个数值)进行比较学习器的效果

本文介绍了模型评估的重要性和常用方法,包括交叉验证(如10折交叉验证)、混淆矩阵以及ROC曲线。通过交叉验证评估了逻辑回归模型的泛化能力,展示了平均交叉验证分数。接着,利用混淆矩阵计算了精确率、召回率和F1分数,并绘制了ROC曲线以评估模型的二分类性能。ROC曲线下的面积(AUC)用于比较不同学习器的效果。

本文介绍了模型评估的重要性和常用方法,包括交叉验证(如10折交叉验证)、混淆矩阵以及ROC曲线。通过交叉验证评估了逻辑回归模型的泛化能力,展示了平均交叉验证分数。接着,利用混淆矩阵计算了精确率、召回率和F1分数,并绘制了ROC曲线以评估模型的二分类性能。ROC曲线下的面积(AUC)用于比较不同学习器的效果。

1732

1732

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?