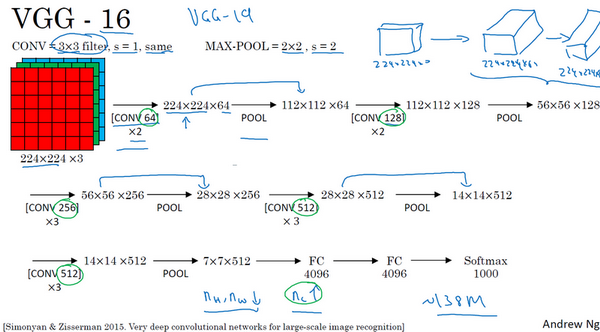

0.在探究 ResNets 之前,我们简单回顾 classic networks,即 plain networks: LeNet-5、AlexNet and VGGNet-16/19。

这些网络以CONV(若干)+POOL+FC这种串联形式组成,成为plain nets。

其中,VGG提出随着网络深度加深,可学习的性能就越强大。

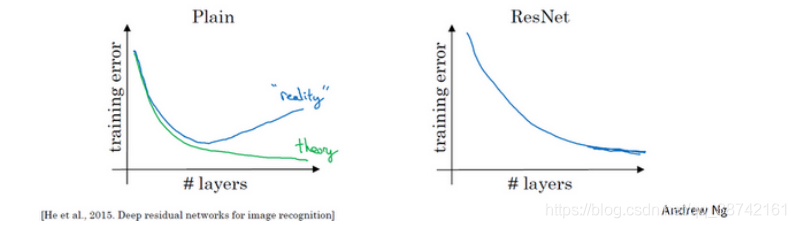

但是,网络深度的加深伴随着梯度消失和梯度爆炸等问题,使得目前的优化方法(随机梯度、Adam)难以优化至较好的性能。如果我们使用标准优化算法训练一个普通网络,比如说梯度下降法,或者其它热门的优化算法。如果没有残差,没有这些捷径或者跳跃连接,凭经验你会发现随着网络深度的加深,训练错误会先减少,然后增多。而理论上,随着网络深度的加深,应该训练得越来越好才对。也就是说,理论上网络深度越深越好。但实际上,如果没有残差网络,对于一个普通网络来说,深度越深意味着用优化算法越难训练。实际上,随着网络深度的加深,训练错误会越来越多。

所以,要想训练更深的网络,需要研究新的网络结构。

1.ResNets

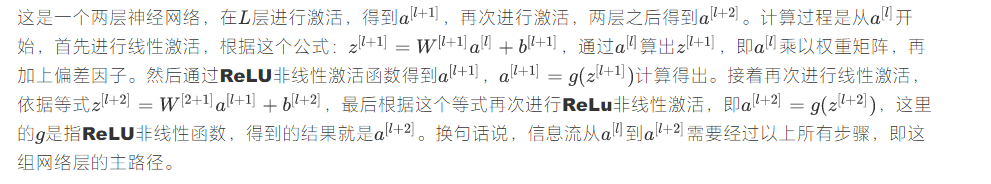

plain block:我们首先以两层普通网络举例

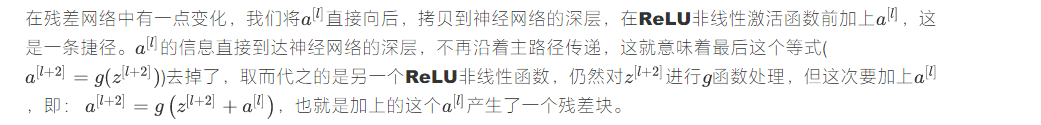

残差块(Residual block):下面构造残差块

ResNet:多个残差块连接

注意:残差块相加时![]() ,应注意维度是否匹配(在a前乘以w进行维度变换)。

,应注意维度是否匹配(在a前乘以w进行维度变换)。

深度学习之残差网络

深度学习之残差网络

426

426

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?