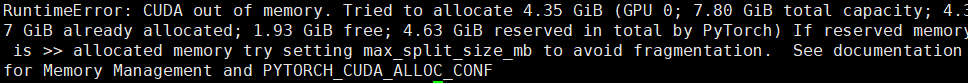

RuntimeError: CUDA out of memory. Tried to allocate 4.35 GiB (GPU 0; 7.80 GiB total capacity; 4.37 GiB already allocated; 1.93 GiB free; 4.63 GiB reserved in total by PyTorch) If reserved memory is >> allocated memory try setting max_split_size_mb to avoid fragmentation. See documentation for Memory Management and PYTORCH_CUDA_ALLOC_CONF

不知原因

且运行代码在cpu上可正常运行,只是慢了点,在gpu上报错:CUDA out of memory

试了几个方法

1、torch.cuda.empty_cache()

没用

2、是否模型太大

确定模型加载完成后,代码才开始崩溃

3、是否数据太大

先放30个图片,崩溃

10个,可正常运行

20个,正常运行

原因,数据以及数据的处理在gpu上负担不了

小tricks:

import time

t1

在使用PyTorch进行深度学习时遇到了CUDA内存不足的问题,尝试了清空缓存、检查模型大小和数据量等方法,发现是数据处理在GPU上导致的负担过重。通过限制数据量可以暂时解决,但需要找到更有效的内存管理策略。

在使用PyTorch进行深度学习时遇到了CUDA内存不足的问题,尝试了清空缓存、检查模型大小和数据量等方法,发现是数据处理在GPU上导致的负担过重。通过限制数据量可以暂时解决,但需要找到更有效的内存管理策略。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

742

742

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?