如果说CNN是神经网络在图像处理中应用最多的方法,那么RNN就是用在自然语言处理领域用得最多的方法。接下来的几节就用来学习下RNN的知识,以及怎么用pytorch来搭建一个RNN网络。

博客中的图片来自李宏毅老师的课程,课程中对于LSTM的讲解真的非常清晰,可以多观看几遍。同时也有篇很好的博客可以参考:博客。

1.RNN的介绍

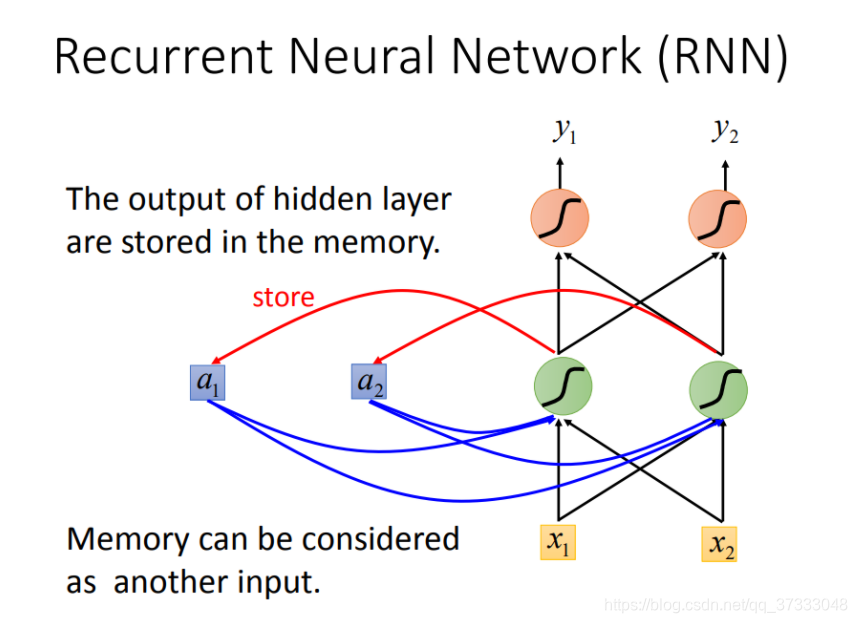

RNN也叫循环神经网络,全称为Recurrent Neural Network,它是一种对序列型数据进行处理的深度模型。它的原理框架如下图展示的一样:

它通过记忆单元(Memory Cell) 来储存上个样本的输出值或中间值,下一时刻的输出不仅与输入有关,还与上一时刻储存的值有关,因此RNN是具有记忆性的。

关于RNN的种类,先简单介绍3种,分别为:Elman Network、Jordan Network、Bidirectional RNN。

-

Elman Network: 它将recurrent层的输出经过时延后作为下一时刻这一层的输入的一部分,然后recurrent层的输出同时送到网络后续的层,比如最终的输出层。

-

Jordan Network: 直接把整个网络最终的输出(输出层的输出)经过时延后反馈回网络的输入层。

本文介绍了RNN及其变种LSTM在自然语言处理中的应用,详细阐述了RNN的工作原理,包括Elman Network、Jordan Network和双向RNN。接着深入解析LSTM解决长序列训练问题的机制,通过实例展示了LSTM的计算过程,并提供了多层LSTM的框架图。

本文介绍了RNN及其变种LSTM在自然语言处理中的应用,详细阐述了RNN的工作原理,包括Elman Network、Jordan Network和双向RNN。接着深入解析LSTM解决长序列训练问题的机制,通过实例展示了LSTM的计算过程,并提供了多层LSTM的框架图。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4843

4843

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?