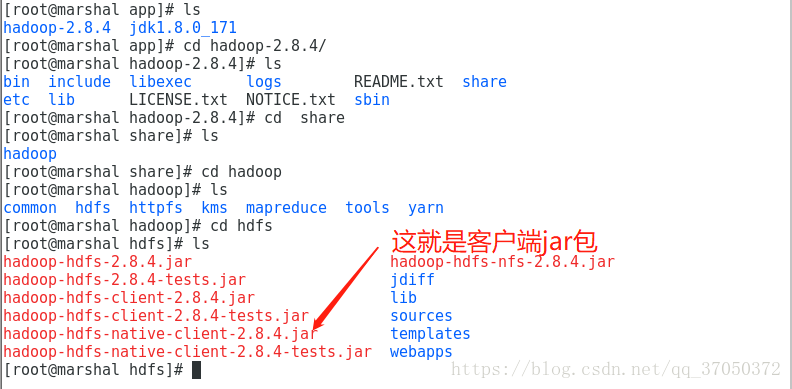

通过前面的操作,我们已经搭建好了hdfs集群,现在的hdfs集群就相当于一个整体,如果我们想要用这个集群的话,就需要使用一个客户端来对文件进行操作。hdfs中的文件 不是指本机的文件,而是指,交由namenode和datanode管理的文件。那么这个客户端在哪里呢?我们的hadoop安装包中已经自带了客户端。

那么我们如何使用这个客户端呢?我们只需要通过hadoop中自带的脚本,就可以操作

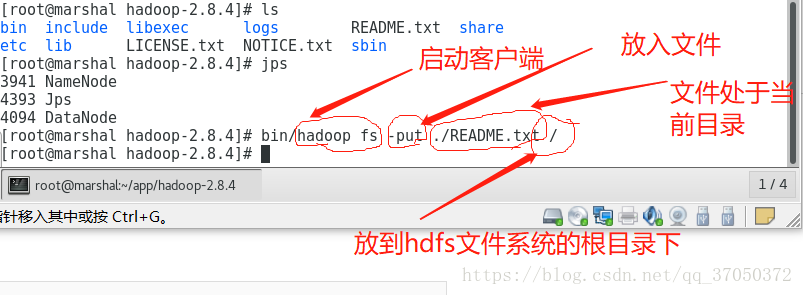

我们尝试操作一下:

这里一定要注意,如果我们想放到hdfs的根目录我们一定要配置好core-site.xml,否则这里的文件是传不到hdfs文件系统中的。默认会传到本地。

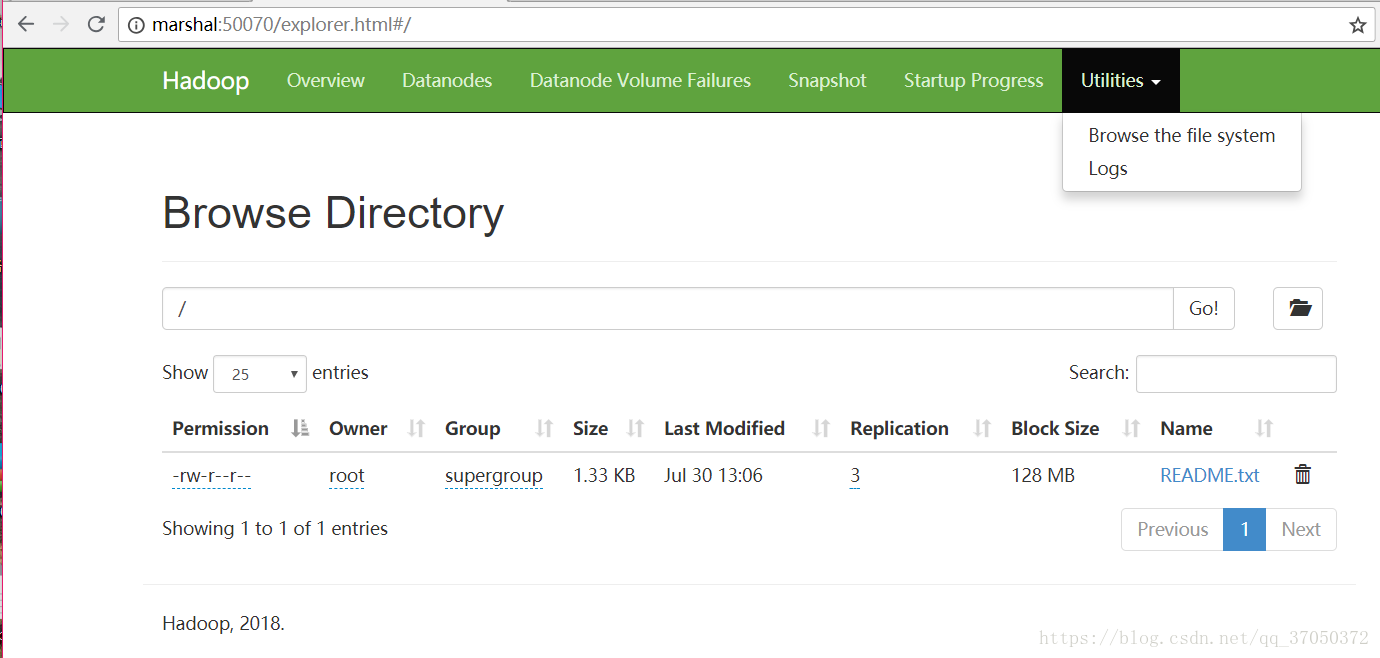

上传成功标志:

当我们再传这个文件的时候,就会提示文件已存在,这时候我们可以改个名字:

Hadoop HDFS客户端操作详解

Hadoop HDFS客户端操作详解

本文介绍了如何使用Hadoop自带的客户端操作HDFS文件系统。客户端上传文件至HDFS时,需要注意配置core-site.xml以确保文件能正确存入根目录。文件会被切分为128M的块,并默认保存3份副本在不同的datanode上,这些配置可在hdfs-site.xml中调整。

本文介绍了如何使用Hadoop自带的客户端操作HDFS文件系统。客户端上传文件至HDFS时,需要注意配置core-site.xml以确保文件能正确存入根目录。文件会被切分为128M的块,并默认保存3份副本在不同的datanode上,这些配置可在hdfs-site.xml中调整。

订阅专栏 解锁全文

订阅专栏 解锁全文

6555

6555

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?