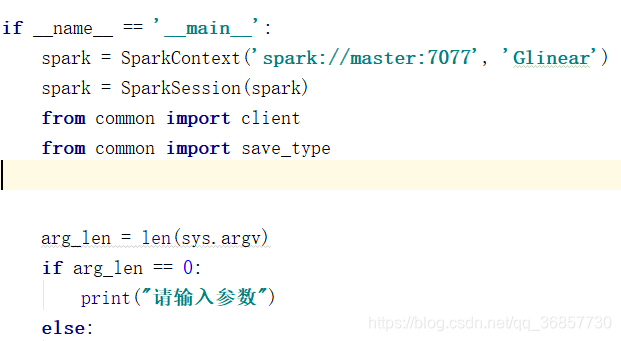

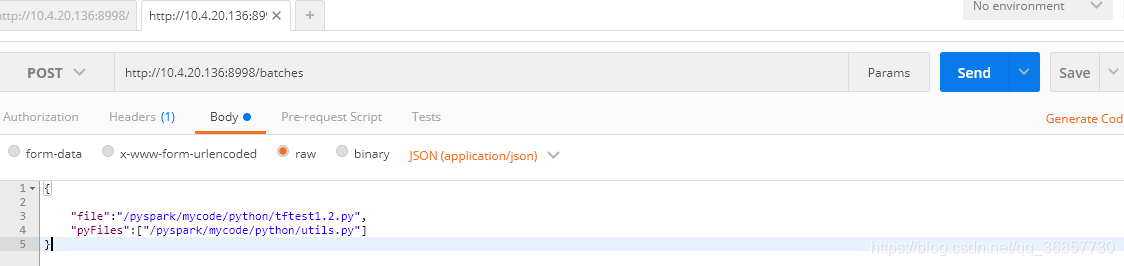

在spark平台上执行Python算法涉及到Python程序的改写,其中import部分需要额外注意。如果我们在执行某个test.py程序时需要调用另外一个common.py,需要在test.py内部添加import common,而此时的import common 不能放在程序头部,需要放在context之后。同时在执行程序时需要–py-files 参数指定引用模块的位置。图2为通过livy调用的情况截图。

Python到pyspark中的py-files的问题

最新推荐文章于 2022-06-21 15:52:36 发布

在Spark平台上执行Python算法时,需对Python程序进行特定改写。尤其在import语句使用上,需放置于context之后,并利用–py-files参数指定模块位置。此操作确保了程序在分布式环境下正确运行。

在Spark平台上执行Python算法时,需对Python程序进行特定改写。尤其在import语句使用上,需放置于context之后,并利用–py-files参数指定模块位置。此操作确保了程序在分布式环境下正确运行。

1038

1038

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?