前言:Tensorflow,与我们之前熟悉的C、C++、Python的确不太一样,建议初学者当作一门新的语言来学。如果看的过程中忽然有一种“的确不太一样”的感觉,并且明白了哪里不一样,你就跨出了第一小步。

首先,TF入门开天辟地第一句如下,以后见到tf就不会显得陌生了:

import tensorflow as tf

一、为什么叫Tensorflow,什么是Tensor?

Tensor的英文翻译为“张量”,由于它有维度而言,故也可以不严格地理解为Python中的列表、C语言中的数组。我们来看看张量是如何定义的:

a = tf.constant([1.0,2.0])

b = tf.constant([3.0,4.0])

二、图、会话基本操作:

在这个指令中,我们定义了两个一行两列的张量常量,它的维度为1。相信有博友会质疑,不就是定义一个常量么,我直接定义列表不可以吗?为什么非得用tf中的constant指令?其实,很遗憾的告诉大家,在之后tf的编程环境中,用到的语句基本上都是tf库内部的函数,举手投足皆tf,一眼望去尽Sess。就连定义个变量也不能随心所欲地信手拈来了,而需要:b=tf.Variable()一下。所以我还是挺主张抱着学一门新语言的心态来学Tensorflow的。

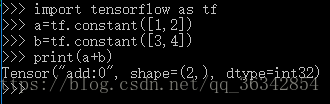

接下来我们来做一下这两个张量的加法,然后再输出结果,这次语法正常了一点 :

result = a+b

print(result)

但是输出的结果会让我们目瞪口呆:

结果显示,我们的结果是一个张量,维度为1,列数为2。按照C语言和Python的语法,天经地义应该输出[4,6]。为什么会输出这样的结果?怎样才能输出真正的结果?

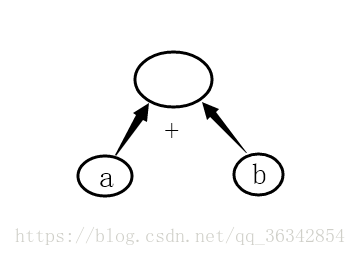

原因:Tensorflow有两大概念——计算图和会话。所谓计算图就是我们所搭建的运算图,以最基本的二叉树为例,如果父节点的值为左右儿子的数值和,我们可以画出一个简单的运算图:

而这句result=a+b的作用也仅限于此:这句话的作用相当于画了一张图,搭建了三个元素之间的关系网络,并没有进行张量的运算。如果想要得到这句话的结果,那么我们可以将这幅图放入一个会话中,执行会话,之后获得结果:[4,6]

with tf.Session() as sess:

print sess.run(result)

我们在之后的编程过程中也会发现,几乎有90%的代码用来框架的搭建,只有10%左右的代码是来执行会话。换句话说,我们会先用图来描述结构(如最基本的张量加法、乘法等操作),再用tf.Session()来跑这个结构。这就是Tensorflow与之前语言不同的地方。

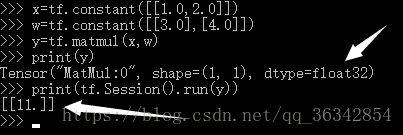

三、张量乘法:

我们可以仿照张量的加法做出张量的乘法,这个步骤就是神经网络参数前向传递的关键环节:

x = tf.constant([[1.0,2.0]])

w = tf.constant([[3.0],[4.0]])

y=tf.matmul(x,w)

print(y)

with tf.Session() as sess:

print(sess.run(y))

结果如下:

别扭吧?我也觉得很别扭,,,但是习惯就好。

下一步我们将会搭建最基本的前向传递网络。敬请关注!

本文从TensorFlow的基本概念出发,介绍了张量的概念及其操作方法,并通过实例演示了如何使用TensorFlow进行张量加法和乘法运算,最后还涉及了神经网络参数的前向传递。

本文从TensorFlow的基本概念出发,介绍了张量的概念及其操作方法,并通过实例演示了如何使用TensorFlow进行张量加法和乘法运算,最后还涉及了神经网络参数的前向传递。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?