Bert模型学习笔记

From https://www.bilibili.com/video/BV1Ey4y1874y emmm 讲实话这个视频太简单了,不建议看。

可以看看李沐的视频:https://www.bilibili.com/video/BV1PL411M7eQ

这篇文章主要是四个部分:

- bert的整体架构

- 如何做预训练 mlm + nsp

- 如何微调bert(没看)

- 代码解析(没看)

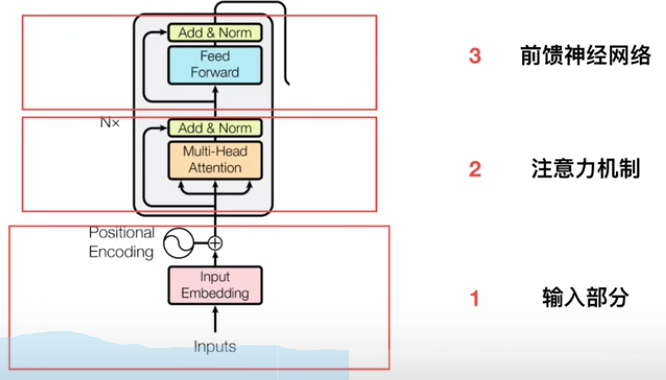

Bert架构

-

基础架构是Transformer

-

bert-base

- 6 个encoder在一起变成了编码端

- 6个decoder在一起变成了解码端

在Transformer中使用了位置编码作为输入,但是在bert中使用的是:

i

n

p

u

t

=

t

o

k

e

n

e

m

b

+

s

e

g

m

e

n

t

+

p

o

s

i

t

i

o

n

e

m

b

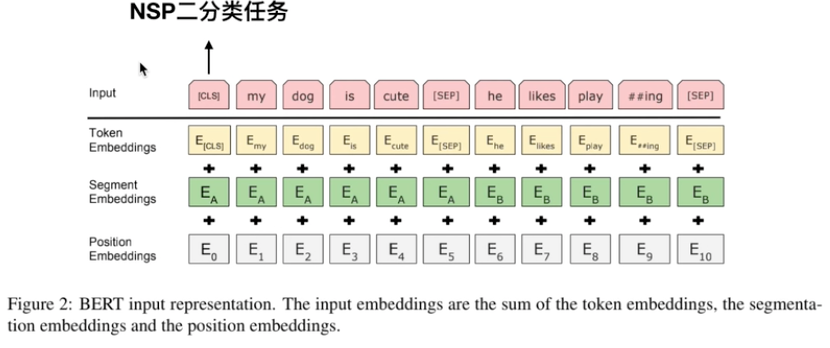

input = token emb + segment + position emb

input=tokenemb+segment+positionemb

二、如何做预训练任务

两种目标函数:

AR:其实就是类似GPT中的预训练任务,预测下一个单词。

AE:将某个位置的词语mask掉,然后进行预训练。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?