首先回顾一下什么是线性回归ML12

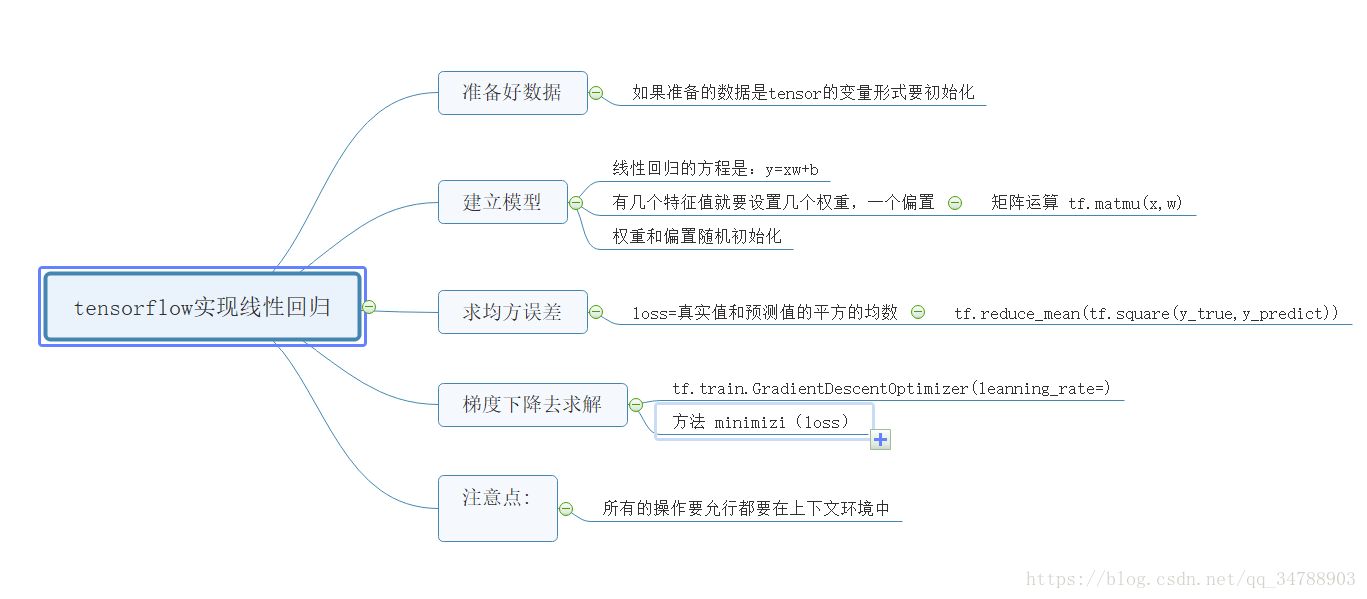

#思维导图

注意:

代码中可以自己构建数据,但是要是tensor的变量形式,要初始化变量

代码:

import tensorflow as tf

import numpy as np

def linnergression(data):

"""

线性回归练习,接收处理两个特征值的样本

:return: None

"""

# 分割数据

x_train = data[:, 0:2]

y_trian = data[3]

# 建立线性回归模型,两个权重,一个偏置

weight = tf.Variable(tf.random_normal(shape=[2, 1], mean=0.0, stddev=0.25), name="w")

bios = tf.Variable(0.0, name="b")

# 计算方差

y_predict = tf.matmul(x_train, weight) + bios

loss = tf.reduce_mean(tf.square(y_trian - y_predict))

# 梯度下降

train_op = tf.train.GradientDescentOptimizer(learning_rate=0.00005).minimize(loss)

# 初始化变量

init_op = tf.global_variables_initializer()

# 运行

with tf.Session() as sess:

sess.run(init_op)

# print("第1次权重是%f,偏置是%f" % ( weight.eval(), bios.eval()))

for i in range(20):

sess.run(train_op)

print(sess.run(weight), sess.run(bios))

return None

if __name__ == '__main__':

# 创建二维测试数据

data = tf.Variable(tf.random_normal(shape=[100, 2], stddev=0.2, mean=5), name="data")

# 初始化变量

init_op = tf.global_variables_initializer()

# 上下文环境

with tf.Session() as sess:

sess.run(init_op)

sess.run(linnergression(data))

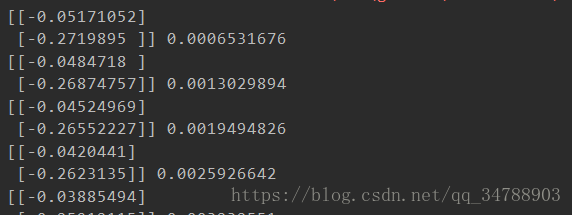

运行结果:

这里的学习率是超参数,调节一下改变很大,可以自己动手试试。

author :specyue@mail.ustc.edu.cn 欢迎交流

本文详细介绍了一个使用TensorFlow实现的线性回归模型实例,通过构建和训练模型来预测由两个特征值组成的样本数据,展示了如何使用梯度下降法进行权重和偏置的优化。

本文详细介绍了一个使用TensorFlow实现的线性回归模型实例,通过构建和训练模型来预测由两个特征值组成的样本数据,展示了如何使用梯度下降法进行权重和偏置的优化。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?