用keras理解循环神经网络

概述

本博客用伪代码来代替繁杂的数学公式,让跟多人能够避开令人眼花的复杂公式,通过伪代码快速理解RNN和LSTM RNN的计算步骤。然后用通俗的话来解释其工作原理,达到对其原理和结构的理解。然后用RNN和LSTM RNN做一个简单的应用,并分析其差异和优劣。

理解RNN

具体的RNN背景和数学推导,大家可以参考这篇博客

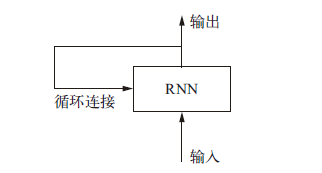

首先在结构上来感受一下RNN,如下图所示

我们用伪代码来解释其结构

#网络初始状态

state_t = 0

for input_t in input_sequence:

output_t = activation(dot(W, input_t) + dot(U, state_t) + b)

state_t = output_t

其中我们输入的样本形状为(timesteps, input_features),而整个网络对时间步(timestep)进行遍历,在每个时间步,它考虑t 时刻的当前状态与t时刻的输入[形状为(input_ features,)],对二者计算得到t 时刻的输出。然后,我们将下一个时间步的状态设置为上一个时间步的输出。

为了进一步了解其计算,我们用numpy来实现RNN的向前传播:

import numpy as np

timesteps = 100

input_features = 32

output_features = 64

inputs = np.random.random((timesteps, input_features))

state_t = np.zeros((output_features,))

W = np.random.random((output_features, input_features))

U = np.random.random((output_features, output_features))

b = np.random.random((output_features,))

successive_outputs = []

for input_t in inputs:

output_t = np.tanh(np.dot(W

本文避开复杂的数学公式,通过伪代码介绍RNN和LSTM的工作原理,以及它们在keras中的实现。用RNN和LSTM进行IMDB情感分类任务,结果显示LSTM的性能更优。

本文避开复杂的数学公式,通过伪代码介绍RNN和LSTM的工作原理,以及它们在keras中的实现。用RNN和LSTM进行IMDB情感分类任务,结果显示LSTM的性能更优。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9293

9293

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?