目录

- 1.卷积(Convolution)卷积核(Kernel)过滤器(Filters)

- 2.池化(pooling)

- 3.通道(channel)

- 4.全连接层

- 5.全卷积网络

- 6.零填充(Zero-padding)

- 7.步长(Stride)

- 8.权重(weight)

- 9.偏差(bias)

- 10.激活函数(Activation Function)

- 11.多层感知机MLP

- 12.神经网络

- 13.正向传播(Forward Propagation)

- 14.反向传播(Backpropagation)

- 15.损失函数(loss function)

- 16.梯度下降(Gradient Descent)

- 17.学习率(Learning Rate)

- 18.优化器(Optimizer)

本博客参考部分博客进行摘录和补充。

1.卷积(Convolution)卷积核(Kernel)过滤器(Filters)

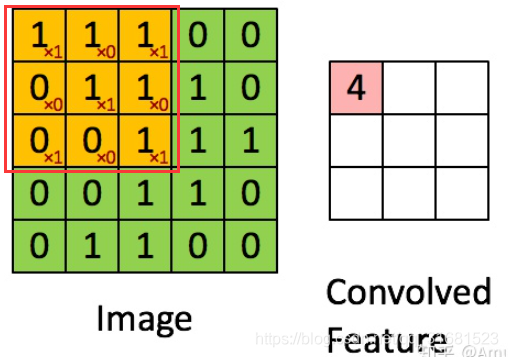

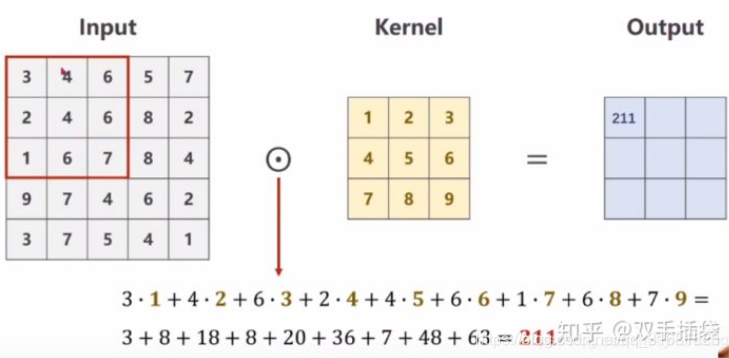

卷积:

可以看作是对某个区域的加权求和(作点积)

卷积核:

如图中红框中橘色区域右下角数字组成33的卷积核,常见卷积核尺寸11 33 55

过滤器:

单通道情况:过滤器=卷积核

多通道情况:过滤器是卷积核的集合(一个过滤器对应一个特征图)

过滤器与卷积核区别:

卷积核就是由长和宽来指定的,是一个二维的概念。

而过滤器是是由长、宽和深度指定的,是一个三维的概念。

过滤器可以看做是卷积核的集合。

过滤器比卷积核高一个维度——深度。

详解https://blog.youkuaiyun.com/weixin_38481963/article/details/109906338

2.池化(pooling)

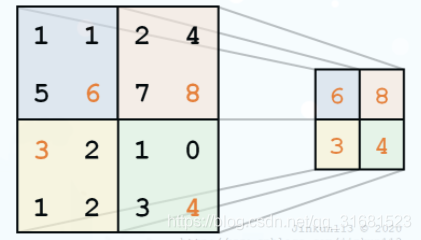

一般来说,卷积层后面都会加上一个池化层,它是对卷积层的进一步特征抽样,用于压缩数据与参数量,减小过拟合(Overfitting)。其具体操作与卷积层基本相同,但只取对应位置的最大值与平均值(最大池化、平均池化)。

池化过程强调特征不变性。尽可能保留图像的特征。

例如最大池化:

3.通道(channel)

无论是输入还是中间产生的特征图,通常并不是单一的二维图,而是多个图组成的,我们称每一张图为一个通道。

详细讲解:https://zhuanlan.zhihu.com/p/251068800

一个卷积核对应一个通道(channels)

(1)单通道卷积:

(2)多通道卷积(RGB三通道)

如果只要一个卷积核,则输出结果通道只有一个,为R、G、B三个颜色通道上卷积结果的累加;

增加卷积核数量到3,则输出结果有三个通道。

4.全连接层

将二维空间转化成一维向量,将全连接层的输出送入分类器或回归器来做分类和回归。

在卷积神经网络中,前面的卷积层的参数少但计算量大,后面的全连接层则相反,因此加速优化重心放在前面的卷积层,参数调优的重心放在后面的全连接层。

5.全卷积网络

将一般的卷积神经网络的全连接层替换成1x1的卷积层,使得网络可以接受任意大小的输入图像,网络输出的是一张特征图,特征图上的每个点对应其输入图像上的感受野区域。

多个3x3卷积比7x7卷积的优点在于:参数量减少并且非线性表达能力增强;

1x1卷积的作用在于:可以用于特征降维与升维,各通道特征融合,以及全卷积网络(支持任意输入图像大小)。

6.零填充(Zero-padding)

在输入矩阵的边缘使用零

本文梳理了深度学习中的关键概念,包括卷积、过滤器、池化、通道、全连接层、全卷积网络等,深入探讨了它们的作用和原理。同时,介绍了正向传播、反向传播、损失函数、优化器等训练过程中的重要环节,帮助读者建立深度学习的完整理解。

本文梳理了深度学习中的关键概念,包括卷积、过滤器、池化、通道、全连接层、全卷积网络等,深入探讨了它们的作用和原理。同时,介绍了正向传播、反向传播、损失函数、优化器等训练过程中的重要环节,帮助读者建立深度学习的完整理解。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

783

783

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?