必坑记录

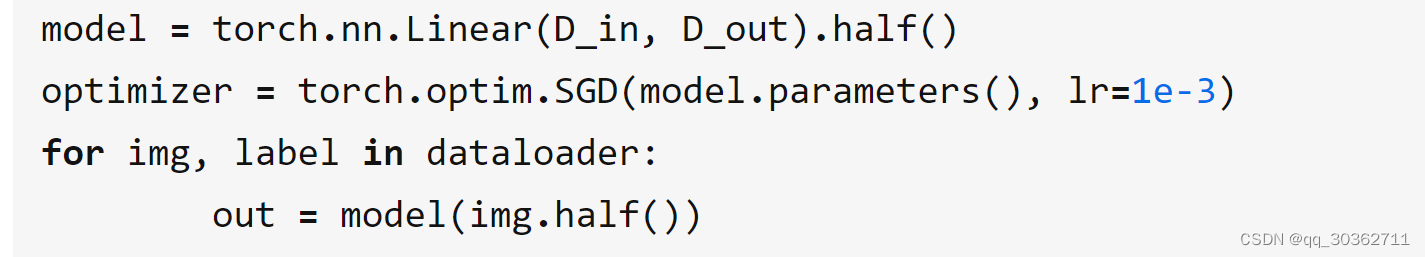

这种训练直接变成nan了结果

实验结果

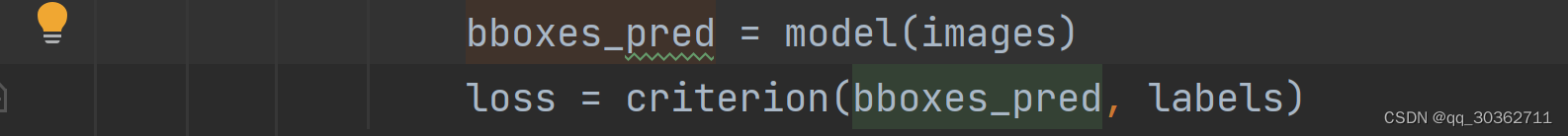

前者采用正常训练

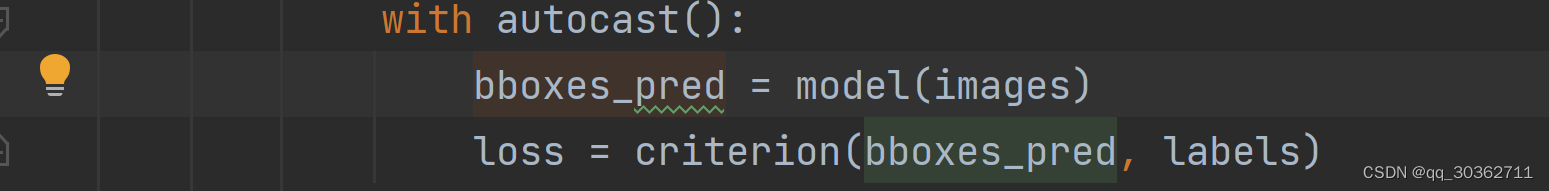

后者改进为

from torch.cuda.amp import autocast as autocast

实验发现从一epoch44秒,减少为35秒。

但是训练的速度下降???

1 0.1 0.24348857969172819 2023-03-24 13:55:18

train_iters::703

train_acc::0.4415

test_acc::0.5398

validation_acc::0.5471

2 0.1 0.19170414526042015 2023-03-24 13:56:02

train_iters::1406

train_acc::0.5842

test_acc::0.5678

validation_acc::0.5729

1 0.1 0.2459259320416118 2023-03-24 14:08:25

train_iters::703

train_acc::0.438

test_acc::0.5173

validation_acc::0.5286

2 0.1 0.19614916702846374 2023-03-24 14:08:59

train_iters::1406

train_acc::0.5719

test_acc::0.5507

validation_acc::0.5513

在应用torch.cuda.amp的autocast进行GPU加速后,训练时间从44秒减少到35秒,但发现训练过程中的精度出现了下降。具体表现为从epoch703时的train_acc0.4415到1406时的0.5842,以及对应的测试和验证精度变化。这表明优化可能影响了模型学习的稳定性。

在应用torch.cuda.amp的autocast进行GPU加速后,训练时间从44秒减少到35秒,但发现训练过程中的精度出现了下降。具体表现为从epoch703时的train_acc0.4415到1406时的0.5842,以及对应的测试和验证精度变化。这表明优化可能影响了模型学习的稳定性。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?