关键词提取是自然语言处理(NLP)中的一个重要任务,它有助于理解文本的主题和内容。在处理中英文关键词提取时,可以使用不同的方法和工具。本文将介绍一些常用的中英文关键词提取方法,并提供Python示例代码。

中文关键词提取

1. 基于TF-IDF的关键词提取

TF-IDF(Term Frequency-Inverse Document Frequency)是一种常用于关键词提取的统计方法。在Python中,你可以使用jieba库进行中文分词和TF-IDF计算。

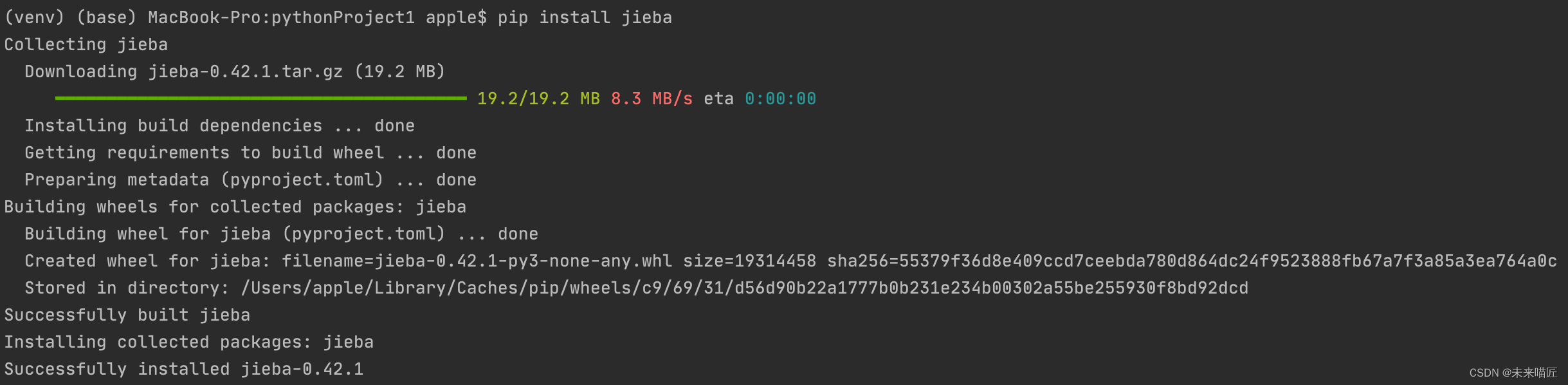

首先,确保已安装jieba库:

pip install jieba

然后,可以使用以下代码进行中文关键词提取:

import jieba.analyse

# 输入文本

text = "这是一段中文文本,我们要从中提取关键词。"

# 中文分词

words = jieba.cut(text)

# 提取关键词

keywords = jieba.analyse.extract_t

本文介绍了自然语言处理中关键词提取的重要性,并提供了使用Python的jieba库进行中文TF-IDF和TextRank关键词提取的示例,以及使用nltk库进行英文TF-IDF提取的方法。关键词提取对于文本分析、信息检索和文本摘要具有关键作用。

本文介绍了自然语言处理中关键词提取的重要性,并提供了使用Python的jieba库进行中文TF-IDF和TextRank关键词提取的示例,以及使用nltk库进行英文TF-IDF提取的方法。关键词提取对于文本分析、信息检索和文本摘要具有关键作用。

订阅专栏 解锁全文

订阅专栏 解锁全文

1078

1078

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?