实现官网上的最简单的Demo,即利用SoftMax Regression来对MNIST手写数字图片进行分类预测。目的是总结利用Tensorflow框架来完成神经网络学习的一般流程。

代码如下:

from TensorFlow import input_data

import tensorflow as tf

mnist = input_data.read_data_sets("MNIST_data/", one_hot=True)

print(mnist.train.images.shape,mnist.train.labels.shape)

print(mnist.test.images.shape,mnist.test.labels.shape)

print(mnist.validation.images.shape,mnist.validation.labels.shape)

#x表示样本集合

x=tf.placeholder(tf.float32,[None,784])

#W是样本中每一像素点对应于10个类别(数字)的权重

W=tf.Variable(tf.zeros([784,10]))

#b为偏置

b=tf.Variable(tf.zeros([10]))

#预测所得的标签集合

y=tf.nn.softmax(tf.matmul(x,W)+b)

#真实标签集合

y_=tf.placeholder(tf.float32,[None,10])

#用交叉熵来定义代价函数

cross_entropy=tf.reduce_mean(-tf.reduce_sum(y_*tf.log(y),reduction_indices=[1]))

#随机梯度优化,即每一步的训练操作

train_step=tf.train.GradientDescentOptimizer(0.5).minimize(cross_entropy)

init=tf.global_variables_initializer()

with tf.Session() as sess:

sess.run(init)

for i in range(1000):

#每次随机从训练集中抽取100条样本构成一个mini_batch

batch_xs,batch_ys=mnist.train.next_batch(100)

sess.run(train_step,feed_dict={x:batch_xs,y_:batch_ys})

#计算每一个训练样本的正确率,argmax(y,1)就是求出该样本预测标签集中概率最大的标签

correct_prediction=tf.equal(tf.argmax(y,1),tf.argmax(y_,1))

#总准确率

accuracy=tf.reduce_mean(tf.cast(correct_prediction,tf.float32))

print(accuracy.eval({x:mnist.test.images,y_:mnist.test.labels}))

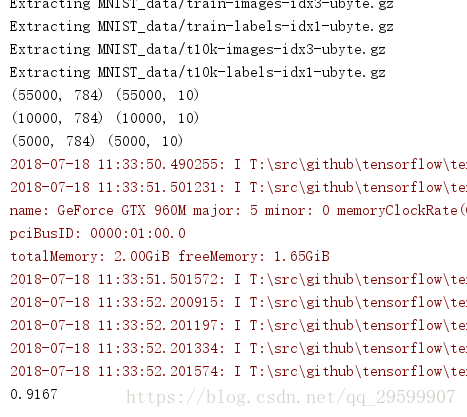

结果如下,采用softmax训练的准确率是92%左右

通过上面的Demo我们可以大致总结出,使用 Tensorflow进行神经网络训练的核心步骤为:

- 定义算法公式,即定义神经网络的结构和前向传播的计算(输出)

- 定义损失函数,以及反向传播优化算法

- 生成Session会话,并在数据集上反复迭代训练

- 测试算法准确率

本文介绍使用Tensorflow框架和SoftMax Regression对MNIST手写数字进行分类预测的方法。通过定义算法公式、损失函数及反向传播优化算法,并在数据集上反复迭代训练,最终达到92%左右的准确率。

本文介绍使用Tensorflow框架和SoftMax Regression对MNIST手写数字进行分类预测的方法。通过定义算法公式、损失函数及反向传播优化算法,并在数据集上反复迭代训练,最终达到92%左右的准确率。

5129

5129

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?