朴素贝叶斯法概念

朴素贝叶斯法是基于贝叶斯定理与特征条件独立假设的分类方法。

最为广泛的两种分类模型是决策树模型(Decision Tree Model)和朴素贝叶斯模型(Naive Bayesian Model,NBM)。和决策树模型相比,朴素贝叶斯分类器(Naive Bayes Classifier 或 NBC)发源于古典数学理论,有着坚实的数学基础,以及稳定的分类效率。同时,NBC模型所需估计的参数很少,对缺失数据不太敏感,算法也比较简单。理论上,NBC模型与其他分类方法相比具有最小的误差率。但是实际上并非总是如此,这是因为NBC模型假设属性之间相互独立,这个假设在实际应用中往往是不成立的,这给NBC模型的正确分类带来了一定影响。

贝叶斯定理

先验概率:即基于统计的概率,是基于以往历史经验和分析得到的结果,不需要依赖当前发生的条件。

后验概率:则是从条件概率而来,由因推果,是基于当下发生了事件之后计算的概率,依赖于当前发生的条件。

条件概率:记事件A发生的概率为P(A),事件B发生的概率为P(B),则在B事件发生的前提下,A事件发生的概率即为条件概率,记为P(A|B)。

P

(

A

∣

B

)

=

P

(

A

B

)

P

(

B

)

P(A|B)=\frac{P(AB)}{P(B)}

P(A∣B)=P(B)P(AB)

贝叶斯公式:贝叶斯公式便是基于条件概率,通过P(B|A)来求P(A|B),如下:

P

(

A

)

=

P

(

A

∣

B

)

×

P

(

B

)

P

(

B

∣

A

)

P(A)=\frac{P(A|B)\times P(B)}{P(B|A)}

P(A)=P(B∣A)P(A∣B)×P(B)

全概率公式:表示若事件{A_1},{A_2}, \cdots ,{A_n}构成一个完备事件组且都有正概率,则对任意一个事件B都有公式成立:

P

(

B

)

=

∑

i

=

1

n

P

(

B

∣

A

i

)

×

P

(

A

i

)

P(B)=\sum_{i=1}^{n} P\left(B \mid A_{i}\right) \times P\left(A_{i}\right)

P(B)=i=1∑nP(B∣Ai)×P(Ai)

将全概率公式带入贝叶斯公式中,得到:

P

(

A

)

=

P

(

A

∣

B

)

×

P

(

B

)

P

(

B

∣

A

)

=

P

(

A

∣

B

)

×

∏

i

=

0

N

P

(

B

i

)

P

(

B

∣

A

)

P(A)=\frac{P(A|B)\times P(B)}{P(B|A)} =\frac{P(A|B)\times \prod_{i=0}^{N}P(B_i)}{P(B|A)}

P(A)=P(B∣A)P(A∣B)×P(B)=P(B∣A)P(A∣B)×∏i=0NP(Bi)

朴素贝叶斯算法的优缺点

优点:

1.朴素贝叶斯模型有稳定的分类效率。

2.对小规模的数据表现很好,能处理多分类任务,适合增量式训练,尤其是数据量超出内存时,可以一批批的去增量训练。

3.对缺失数据不太敏感,算法也比较简单,常用于文本分类。

缺点:

1.需要知道先验概率,且先验概率很多时候取决于假设,假设的模型可以有很多种,因此在某些时候会由于假设的先验模型的原因导致预测效果不佳。

2.由于通过先验和数据来决定后验的概率从而决定分类,所以分类决策存在一定的错误率。

实现垃圾邮件分类

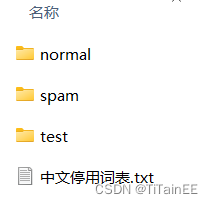

数据集

代码实现

读取数据集

#获得停用词表

def getStopWords(self):

stopList=[]

for line in open("data\中文停用词表.txt"):

stopList.append(line[:len(line)-1])

return stopList;

#获得词典

def get_word_list(self,content,wordsList,stopList):

#分词结果放入res_list

res_list = list(jieba.cut(content))

for i in res_list:

if i not in stopList and i.strip()!='' and i!=None:

if i not in wordsList:

wordsList.append(i)

计算15个影响最大的词

#通过计算每个文件中p(s|w)来得到对分类影响最大的15个词

def getTestWords(self,testDict,spamDict,normDict,normFilelen,spamFilelen):

wordProbList={}

for word,num in testDict.items():

if word in spamDict.keys() and word in normDict.keys():

#该文件中包含词个数

pw_s=spamDict[word]/spamFilelen

pw_n=normDict[word]/normFilelen

ps_w=pw_s/(pw_s+pw_n)

wordProbList.setdefault(word,ps_w)

if word in spamDict.keys() and word not in normDict.keys():

pw_s=spamDict[word]/spamFilelen

pw_n=0.01

ps_w=pw_s/(pw_s+pw_n)

wordProbList.setdefault(word,ps_w)

if word not in spamDict.keys() and word in normDict.keys():

pw_s=0.01

pw_n=normDict[word]/normFilelen

ps_w=pw_s/(pw_s+pw_n)

wordProbList.setdefault(word,ps_w)

if word not in spamDict.keys() and word not in normDict.keys():

#若该词不在脏词词典中,概率设为0.4

wordProbList.setdefault(word,0.4)

sorted(wordProbList.items(),key=lambda d:d[1],reverse=True)[0:15]

return (wordProbList)

计算贝叶斯概率

#计算贝叶斯概率

def calBayes(self,wordList,spamdict,normdict):

ps_w=1

ps_n=1

for word,prob in wordList.items() :

print(word+"/"+str(prob))

ps_w*=(prob)

ps_n*=(1-prob)

p=ps_w/(ps_w+ps_n)

# print(str(ps_w)+"////"+str(ps_n))

return p

垃圾邮件贝叶斯

import jieba;

import os;

class spamEmailBayes:

#获得停用词表

def getStopWords(self):

stopList=[]

for line in open("data\中文停用词表.txt"):

stopList.append(line[:len(line)-1])

return stopList;

#获得词典

def get_word_list(self,content,wordsList,stopList):

#分词结果放入res_list

res_list = list(jieba.cut(content))

for i in res_list:

if i not in stopList and i.strip()!='' and i!=None:

if i not in wordsList:

wordsList.append(i)

#若列表中的词已在词典中,则加1,否则添加进去

def addToDict(self,wordsList,wordsDict):

for item in wordsList:

if item in wordsDict.keys():

wordsDict[item]+=1

else:

wordsDict.setdefault(item,1)

def get_File_List(self,filePath):

filenames=os.listdir(filePath)

return filenames

#通过计算每个文件中p(s|w)来得到对分类影响最大的15个词

def getTestWords(self,testDict,spamDict,normDict,normFilelen,spamFilelen):

wordProbList={}

for word,num in testDict.items():

if word in spamDict.keys() and word in normDict.keys():

#该文件中包含词个数

pw_s=spamDict[word]/spamFilelen

pw_n=normDict[word]/normFilelen

ps_w=pw_s/(pw_s+pw_n)

wordProbList.setdefault(word,ps_w)

if word in spamDict.keys() and word not in normDict.keys():

pw_s=spamDict[word]/spamFilelen

pw_n=0.01

ps_w=pw_s/(pw_s+pw_n)

wordProbList.setdefault(word,ps_w)

if word not in spamDict.keys() and word in normDict.keys():

pw_s=0.01

pw_n=normDict[word]/normFilelen

ps_w=pw_s/(pw_s+pw_n)

wordProbList.setdefault(word,ps_w)

if word not in spamDict.keys() and word not in normDict.keys():

#若该词不在脏词词典中,概率设为0.4

wordProbList.setdefault(word,0.4)

sorted(wordProbList.items(),key=lambda d:d[1],reverse=True)[0:15]

return (wordProbList)

#计算贝叶斯概率

def calBayes(self,wordList,spamdict,normdict):

ps_w=1

ps_n=1

for word,prob in wordList.items() :

print(word+"/"+str(prob))

ps_w*=(prob)

ps_n*=(1-prob)

p=ps_w/(ps_w+ps_n)

# print(str(ps_w)+"////"+str(ps_n))

return p

#计算预测结果正确率

def calAccuracy(self,testResult):

rightCount=0

errorCount=0

for name ,catagory in testResult.items():

if (int(name)<1000 and catagory==0) or(int(name)>1000 and catagory==1):

rightCount+=1

else:

errorCount+=1

return rightCount/(rightCount+errorCount)

预测实现

from spam.spamEmail import spamEmailBayes

import re

#spam类对象

spam=spamEmailBayes()

#保存词频的词典

spamDict={}

normDict={}

testDict={}

#保存每封邮件中出现的词

wordsList=[]

wordsDict={}

#保存预测结果,key为文件名,值为预测类别

testResult={}

#分别获得正常邮件、垃圾邮件及测试文件名称列表

normFileList=spam.get_File_List(r"data\normal")

spamFileList=spam.get_File_List(r"data\spam")

testFileList=spam.get_File_List(r"data\test")

#获取训练集中正常邮件与垃圾邮件的数量

normFilelen=len(normFileList)

spamFilelen=len(spamFileList)

#获得停用词表,用于对停用词过滤

stopList=spam.getStopWords()

#获得正常邮件中的词频

for fileName in normFileList:

wordsList.clear()

for line in open("data/normal/"+fileName):

#过滤掉非中文字符

rule=re.compile(r"[^\u4e00-\u9fa5]")

line=rule.sub("",line)

#将每封邮件出现的词保存在wordsList中

spam.get_word_list(line,wordsList,stopList)

#统计每个词在所有邮件中出现的次数

spam.addToDict(wordsList, wordsDict)

normDict=wordsDict.copy()

#获得垃圾邮件中的词频

wordsDict.clear()

for fileName in spamFileList:

wordsList.clear()

for line in open("data/spam/"+fileName):

rule=re.compile(r"[^\u4e00-\u9fa5]")

line=rule.sub("",line)

spam.get_word_list(line,wordsList,stopList)

spam.addToDict(wordsList, wordsDict)

spamDict=wordsDict.copy()

# 测试邮件

for fileName in testFileList:

testDict.clear( )

wordsDict.clear()

wordsList.clear()

for line in open("data/test/"+fileName):

rule=re.compile(r"[^\u4e00-\u9fa5]")

line=rule.sub("",line)

spam.get_word_list(line,wordsList,stopList)

spam.addToDict(wordsList, wordsDict)

testDict=wordsDict.copy()

#通过计算每个文件中p(s|w)来得到对分类影响最大的15个词

wordProbList=spam.getTestWords(testDict, spamDict,normDict,normFilelen,spamFilelen)

#对每封邮件得到的15个词计算贝叶斯概率

p=spam.calBayes(wordProbList, spamDict, normDict)

if(p>0.9):

testResult.setdefault(fileName,1)

else:

testResult.setdefault(fileName,0)

#计算分类准确率(测试集中文件名低于1000的为正常邮件)

testAccuracy=spam.calAccuracy(testResult)

for i,ic in testResult.items():

print(i+"/"+str(ic))

print(testAccuracy)

结果展示

使用朴素贝叶斯分类达到了95%的分类精度。

总结

朴素贝叶斯算法在处理垃圾邮件数据较少的情况下仍然有效,可以处理多类别问题,但是对于输入数据的准备方式较为敏感

文章介绍了朴素贝叶斯法的概念,包括其基于贝叶斯定理和特征条件独立假设。通过Python代码展示了如何实现垃圾邮件分类,计算影响最大的词并计算贝叶斯概率。虽然朴素贝叶斯模型有参数少、对缺失数据不敏感等优点,但也存在假设属性独立的问题。最后,文章提到在数据集上实现了95%的分类精度,证明了朴素贝叶斯在小数据量时的有效性。

文章介绍了朴素贝叶斯法的概念,包括其基于贝叶斯定理和特征条件独立假设。通过Python代码展示了如何实现垃圾邮件分类,计算影响最大的词并计算贝叶斯概率。虽然朴素贝叶斯模型有参数少、对缺失数据不敏感等优点,但也存在假设属性独立的问题。最后,文章提到在数据集上实现了95%的分类精度,证明了朴素贝叶斯在小数据量时的有效性。

2673

2673

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?