UnOS: Unified Unsupervised Optical-flow and Stereo-depth Estimation by Watching Videos

Code

摘要

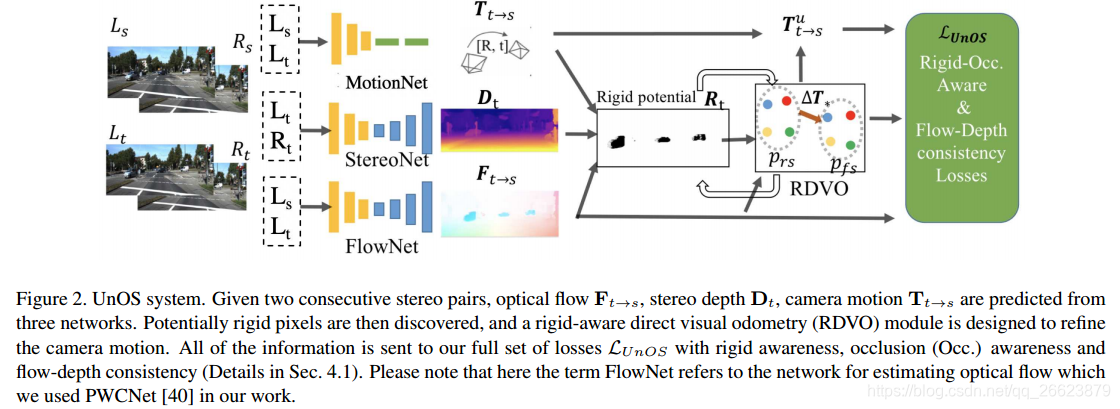

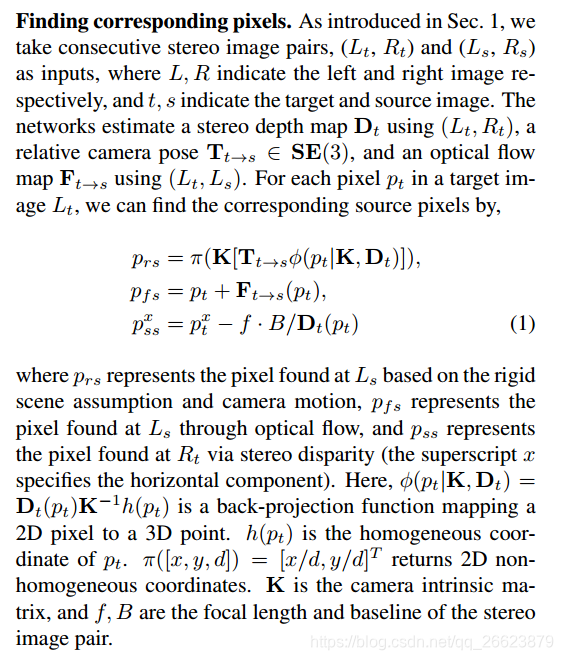

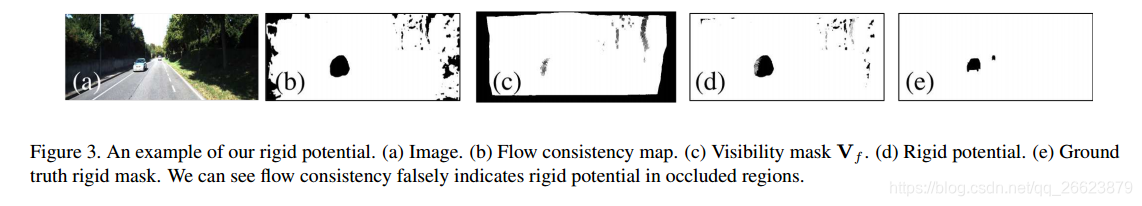

本文在文献[31]的基础上,利用卷积神经网络(CNN)固有的几何一致性,提出了UnOS,一个统一的无监督光流和立体深度估计系统。UnOS明显优于其他独立处理这两个任务的最新(SOTA)无监督方法。具体来说,给定视频中的两个连续立体图像对,UnOS使用三个平行cnn估计每像素立体深度图像、相机ego运动和光流。基于这些量,UnOS计算刚性光流,并将其与从流网络估计的光流进行比较,得到满足刚性场景假设的像素。然后,我们鼓励在刚性区域内两个估计流之间的几何一致性,并由此导出刚性感知直接视觉里程(RDVO)模块。我们还提出了刚性和阻塞感知的流一致性损失来学习UnOS。我们在流行的KITTI数据集上评估了4个相关任务的结果,即立体深度、光流、视觉里程和运动分割。

贡献

1.我们设计了一个统一的无监督光流和立体深度学习框架,称为“UnOS”,通过显式地鼓励它们与自动发现的刚性区域的几何一致性,从而在这两个任务中都产生SOTA性能。

2.我们设计了一个刚性感知直接视觉里程计(RDVO)模块,该模块使用光流匹配小心地处理刚性区域,从而产生更精确的摄像机运动估计。

3.我们在训练模式中加入了刚性和遮挡的特性,这对CNNs的学习是有效的。

方法

T-S,和L-R的像素图像上的转换规则

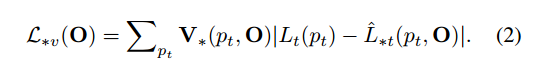

有遮挡的视角合成

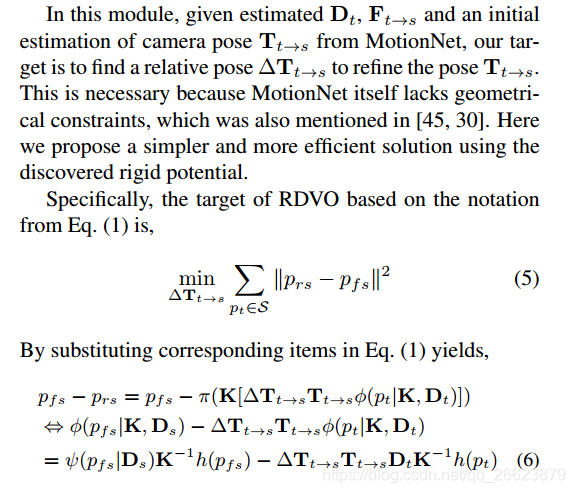

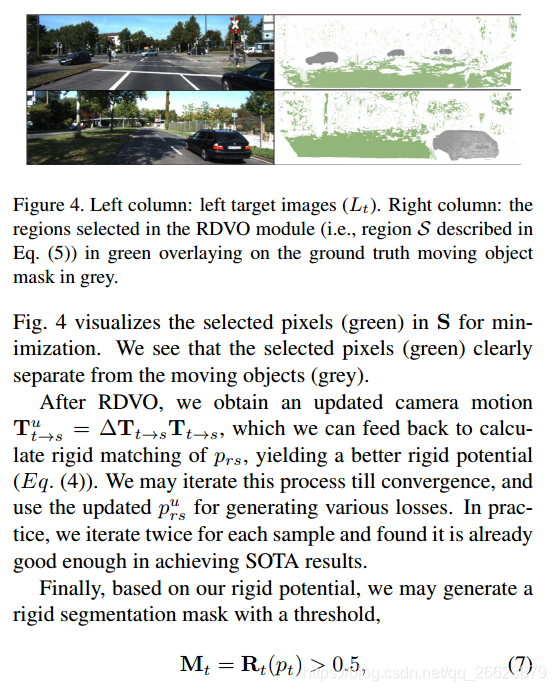

非结构下直接VO

这点比较像动态SLAM在场景中将运动的非刚体运动点过滤,只用刚体运动的点进行匹配

结果

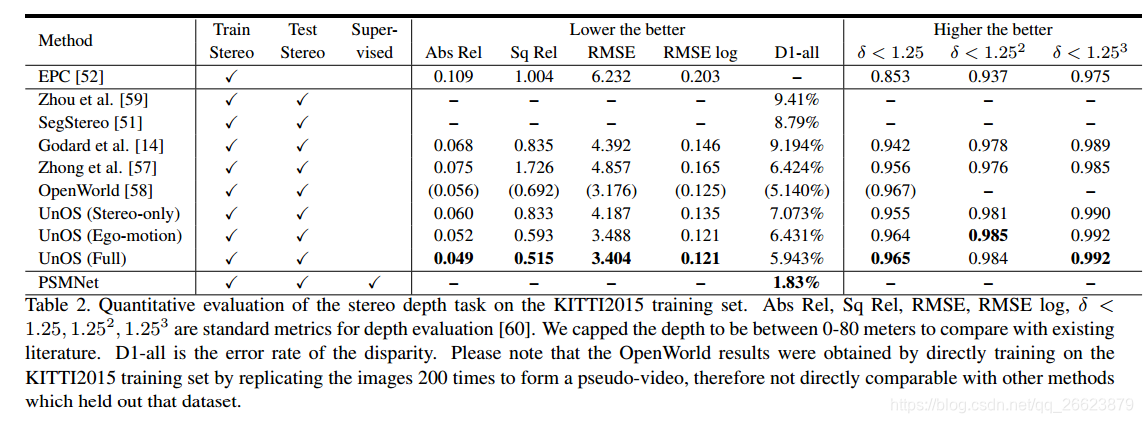

深度估计

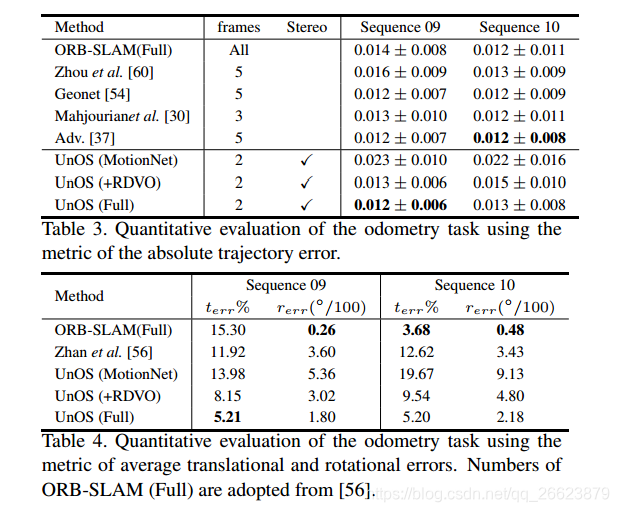

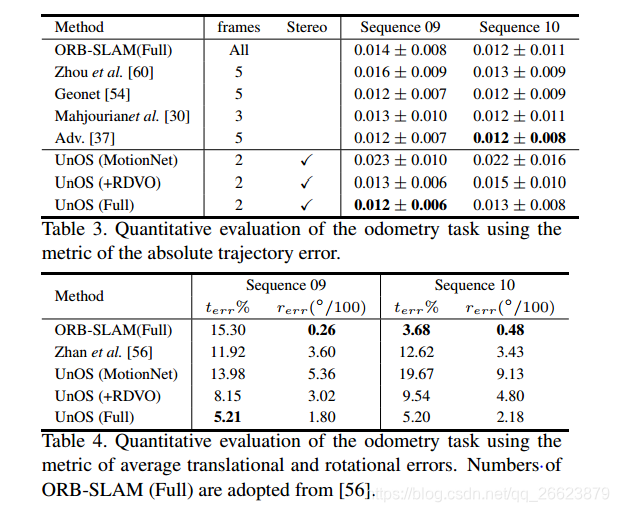

2.里程计估计

光流深度估计

提出UnOS,一种基于视频的统一无监督学习框架,用于光流和立体深度估计,通过几何一致性提升性能。设计了刚性感知直接视觉里程模块,改进相机运动估计。引入刚性和遮挡感知流一致性损失,优化CNN学习。

提出UnOS,一种基于视频的统一无监督学习框架,用于光流和立体深度估计,通过几何一致性提升性能。设计了刚性感知直接视觉里程模块,改进相机运动估计。引入刚性和遮挡感知流一致性损失,优化CNN学习。

1013

1013

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?