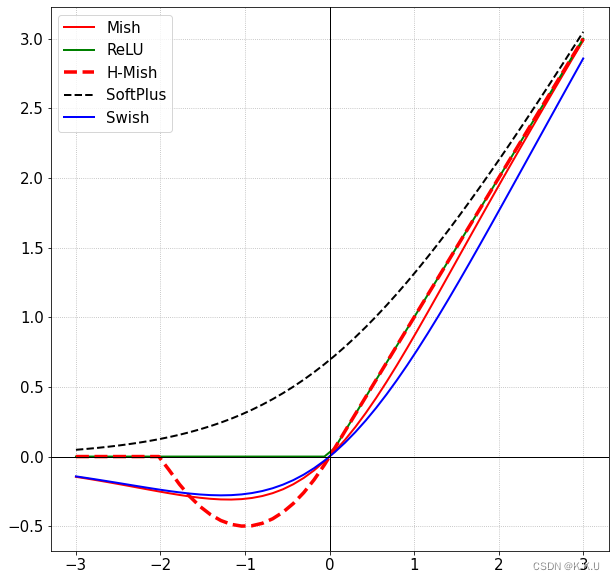

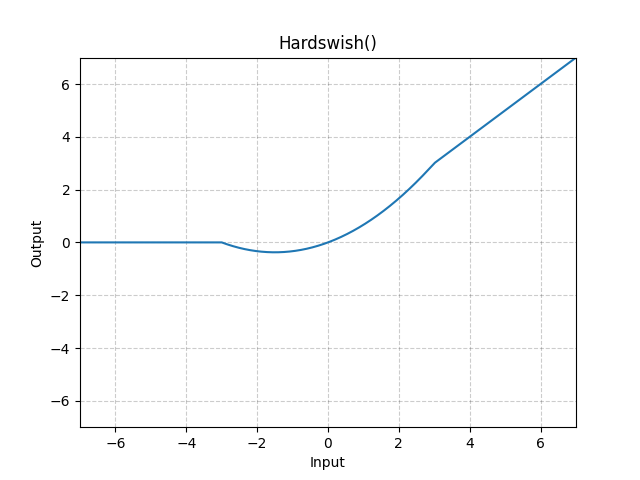

hardswish和hardmish是两个比ReLu更强的激活函数,在姿态估计网络中使用可以带来一定的涨点,故本篇文章想要在mmpose中替换一下激活函数,测试一下两种新的激活函数的效果。

1.测试环境

python 3.7.6

pytorch 1.13

cuda 11.6

windows 11

2.替换lite-henet.py的激活函数为hardswish

将mmpose\models\backbones\litehrnet.py拷贝一份重新命名为litehrnet_hswish.py同样存放在将mmpose\models\backbones\目录。

在litehrnet_hswish.py注册新的激活函数Hardswish:

from mmcv.cnn.bricks.registry import ACTIVATION_LAYERS

@ACTIVATION_LAYERS.register_module()

class Hardswish(nn.Module):

r"""Appli

文章介绍了如何在MMPose框架中替换Lite-HRNet的ReLU激活函数,使用Hardswish和自定义的Hardmish激活函数。通过修改网络代码和训练配置文件,以测试这两种新激活函数对姿态估计性能的影响。注意,Hardmish可能增加显存占用。

文章介绍了如何在MMPose框架中替换Lite-HRNet的ReLU激活函数,使用Hardswish和自定义的Hardmish激活函数。通过修改网络代码和训练配置文件,以测试这两种新激活函数对姿态估计性能的影响。注意,Hardmish可能增加显存占用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

8366

8366