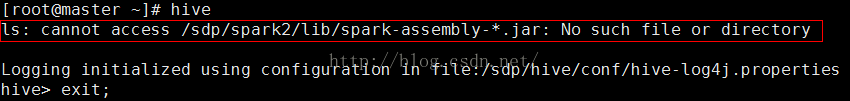

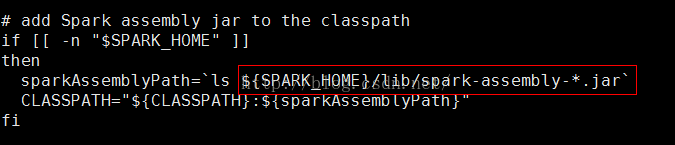

1.自从spark2.0.0发布没有assembly的包了,在jars里面,是很多小jar包

修改目录查找jar

2.异常HiveConf of name hive.enable.spark.execution.engine does not exist

在hive-site.xml中:

hive.enable.spark.execution.engine过时了,配置删除即可

3.异常

Failed to execute spark task, with exception 'org.apache.hadoop.hive.ql.metadata.HiveException(Failed to create spark client.)' FAILED: Execution Error, return code 1 from org.apache.hadoop.hive.ql.exec.spark.SparkTask

Spark与hive版本不对,spark的编译,在这里我使用的是hive稳定版本2.01,查看他的pom.xml

本文详细介绍了在尝试使用Hive on Spark时遇到的一系列错误及解决方案,包括:1) spark2.0.0后jar包变化;2) 过时的hive.enable.spark.execution.engine配置;3) Hive和Spark版本不匹配问题;4) 缺少Scala相关类库;5) impersonation权限问题;6) Hive和Metastore版本不一致的问题。解决这些问题需要正确配置文件、更新版本以及调整环境变量。

本文详细介绍了在尝试使用Hive on Spark时遇到的一系列错误及解决方案,包括:1) spark2.0.0后jar包变化;2) 过时的hive.enable.spark.execution.engine配置;3) Hive和Spark版本不匹配问题;4) 缺少Scala相关类库;5) impersonation权限问题;6) Hive和Metastore版本不一致的问题。解决这些问题需要正确配置文件、更新版本以及调整环境变量。

订阅专栏 解锁全文

订阅专栏 解锁全文

2295

2295

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?