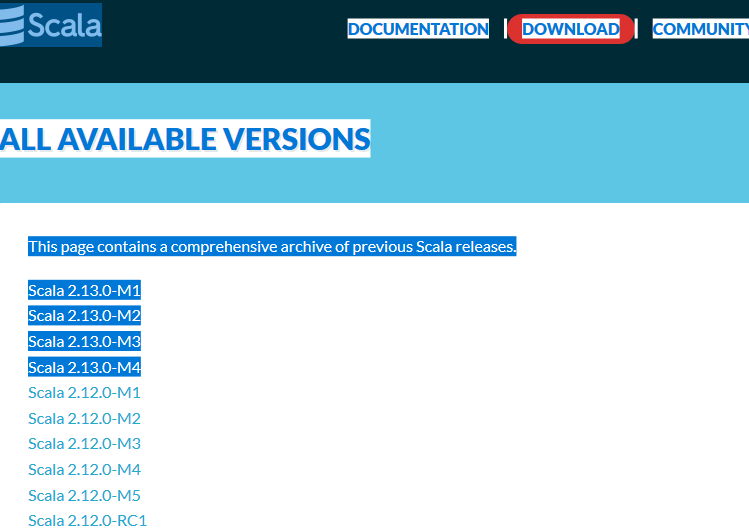

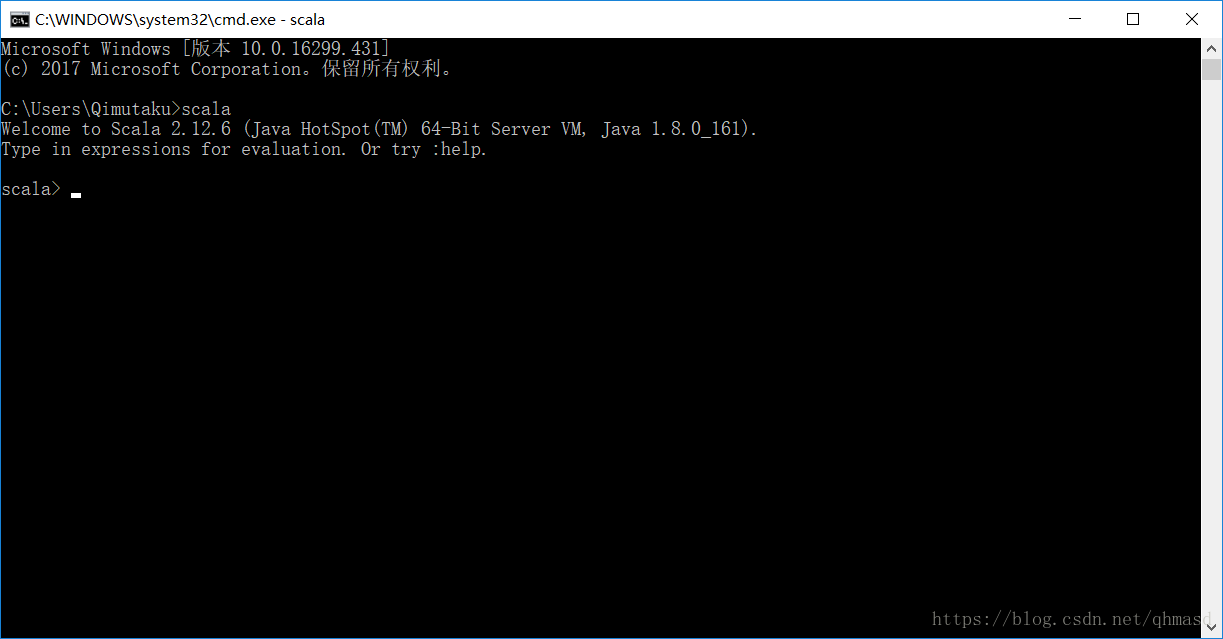

1)安装Scala 2.12.0(好像要2.11.0的,修改)

从https://www.scala-lang.org/download/all.html下载Scala相应版本

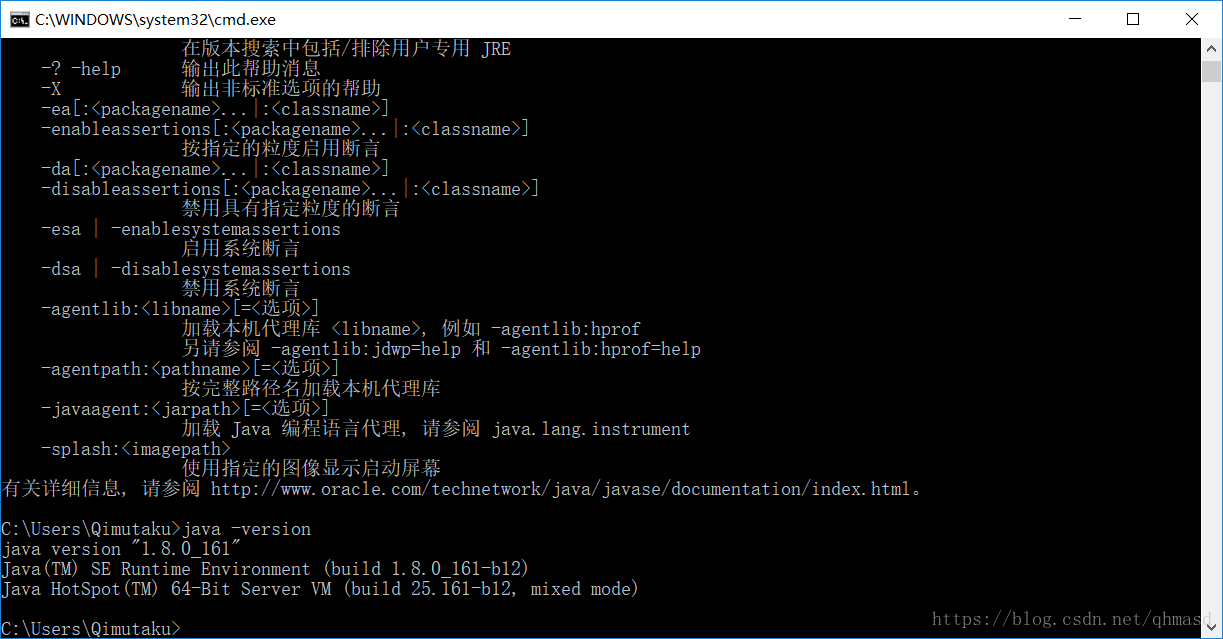

查看JAVA版本

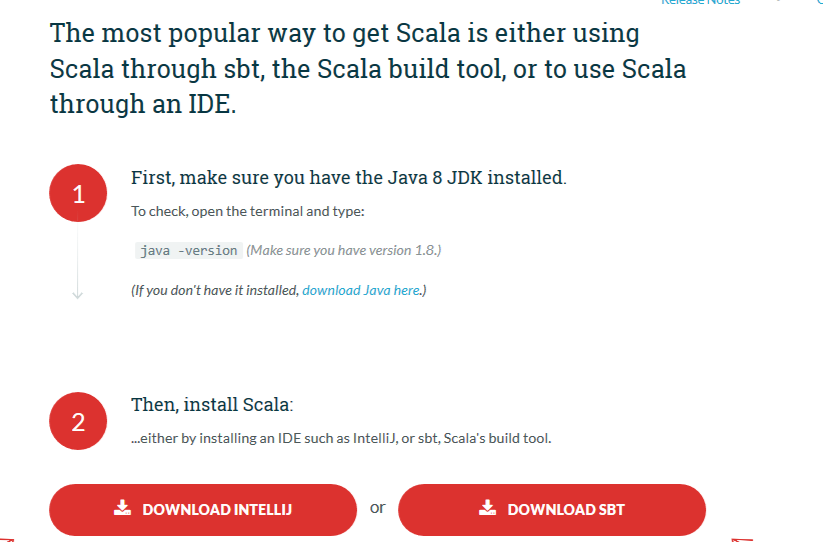

两种下载

前者的IDE

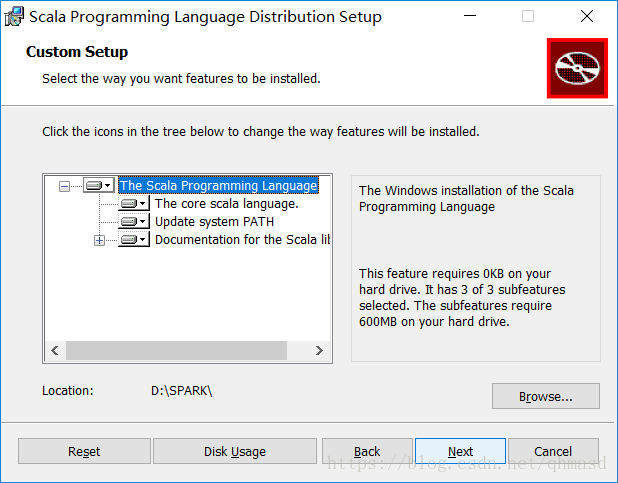

还是选择msi吧。。。

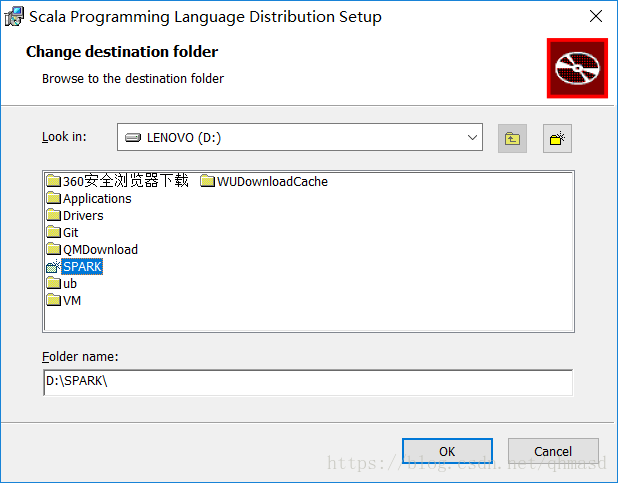

装到固态上吧

cmd没Scala出来呀。。。

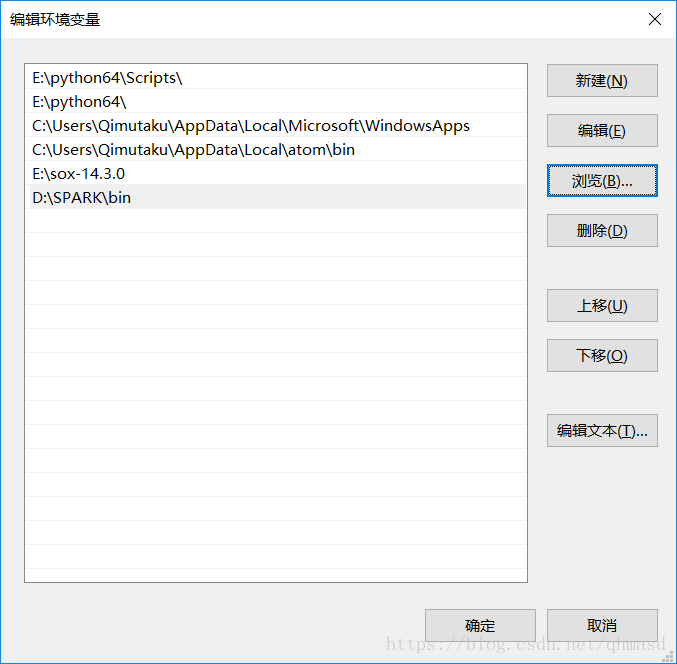

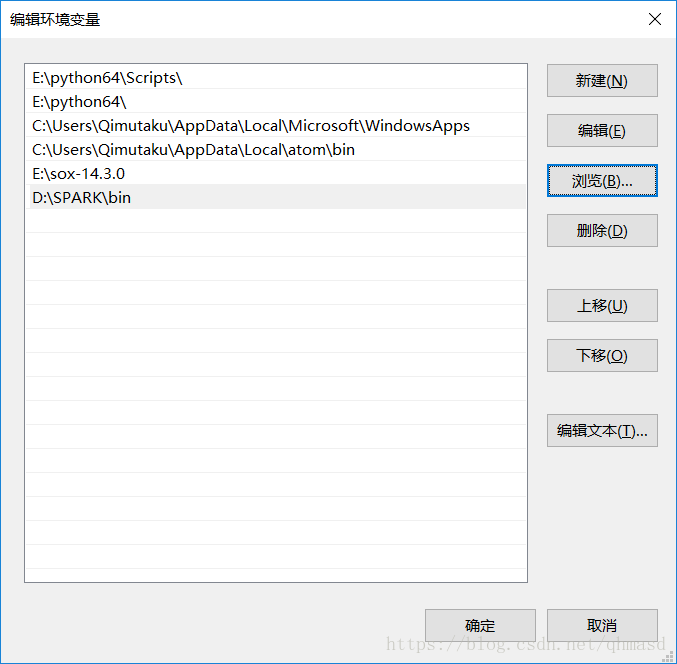

看看环境变量添加一下行不行

失败了。。。

哎呦重新进一回可以了!!!

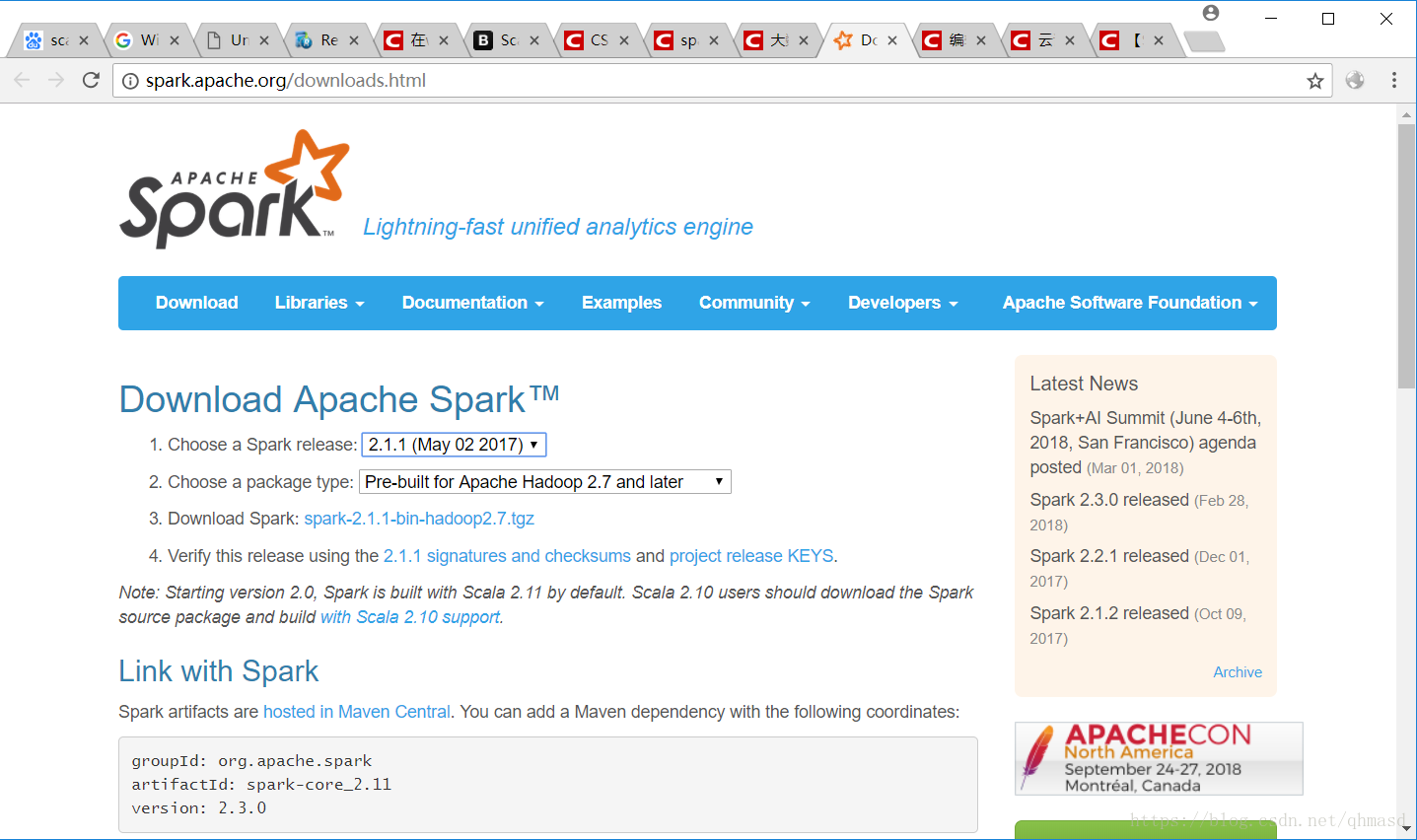

2)Spark

来装Spark吧!!

http://spark.apache.org/downloads.html

这里用个适中的版本试一下(2.1.1)(用最新版了(2.3.0))

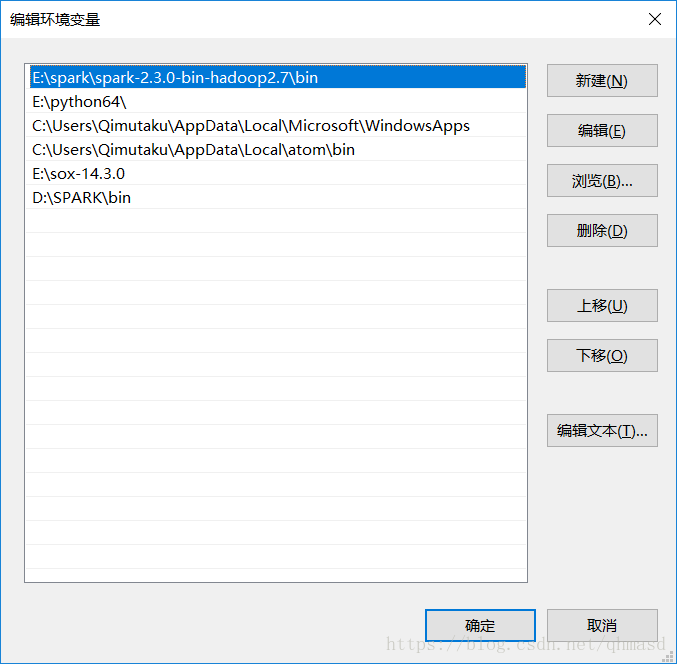

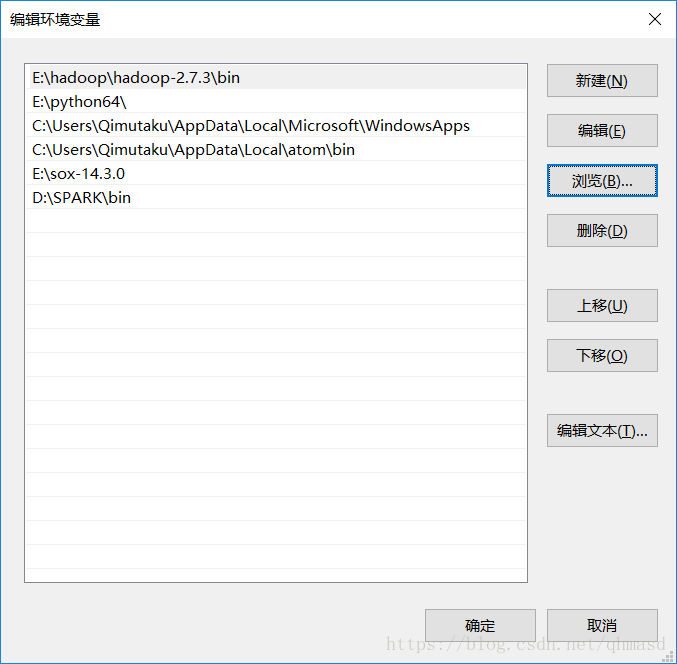

加个环境变量

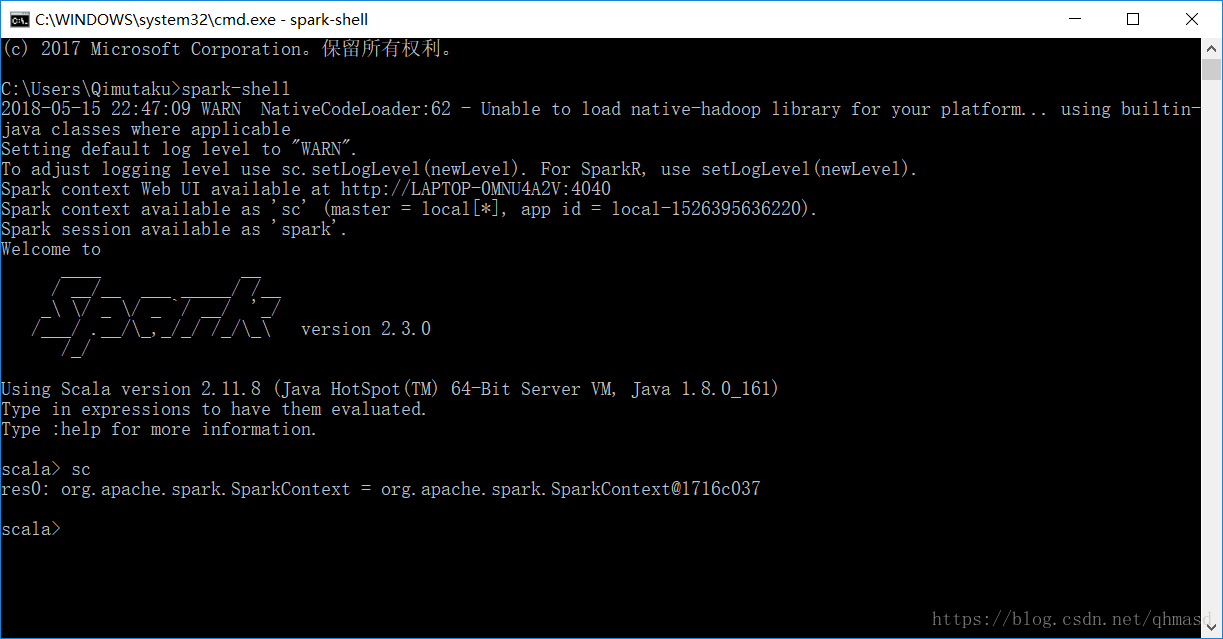

跑一下从cmd

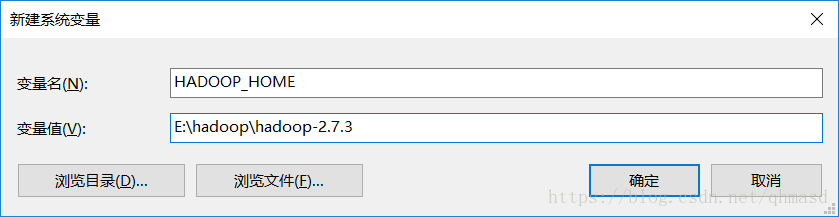

Hadoop

这里已经有winutils.exe了,没有的话去https://github.com/steveloughran/winutils 下一个,改下权限

e:\hadoop\bin\winutils.exe chmod 777 /tmp/hive输入spark-shell,Emmmm,还有个Warn

本文详细记录了Scala 2.12.0及Spark 2.3.0的安装过程,包括环境变量配置与常见问题解决方法。此外还介绍了如何获取必要的winutils.exe工具并确保Spark shell正常运行。

本文详细记录了Scala 2.12.0及Spark 2.3.0的安装过程,包括环境变量配置与常见问题解决方法。此外还介绍了如何获取必要的winutils.exe工具并确保Spark shell正常运行。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?