一、摘要

自下而上的机制(基于Faster R-CNN):提取出图像区域,每个区域都有一个相关的特征向量。

自上而下的机制:确定特征权重。

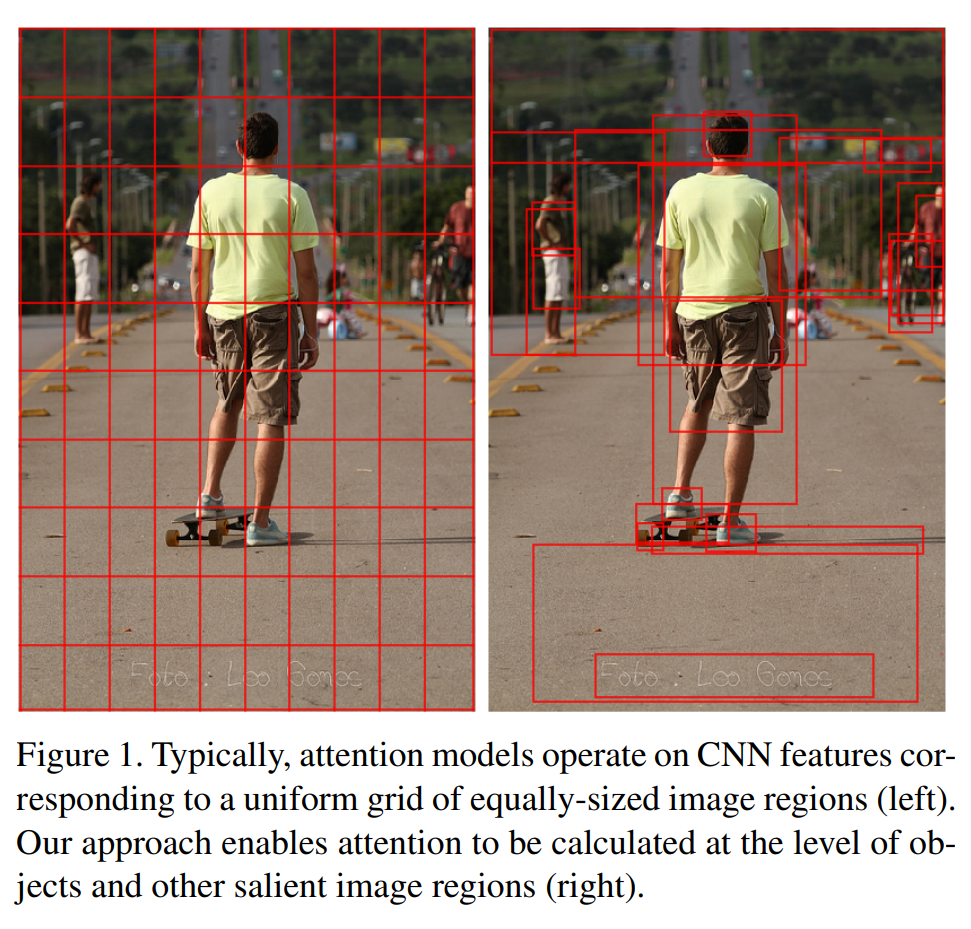

提出了一种自下而上和自上而下的结合注意力机制,使注意力能够在对象和其他显著图像区域上计算。这是注意力(Attention)被考虑的基础。

二、简介

视觉注意机制:基于深度神经网络架构,通过学习 关注图像中显著的区域来提高性能。

自上而下(Top-Down ):非视觉或任务特定环境驱动的注意机制。

自下而上(Bottom-Up ):纯视觉前馈注意机制。

图像字幕(Image Captioning)和视觉问答(VQA) 通常需要执行一些细粒度的可视化处理,甚至多个推理步骤来生成高质量的输出。

大多数用于图像字幕和VQA的传统视觉注意机制都是自上而下的。它们一般被训练为只是选择性地关注CNN输出中的某一层或某几层。然而,这种方法很少考虑如何确定受注意的图像区域。

本文提出了一种自下而上和自上而下结合的视觉注意机制。

自下而上(Bottom-Up)机制提取出了一组显著图像区域,每个区域由一个汇集的卷积特征向量表示。使用Faster R-CNN实现自下而上的注意,它代表了自下而上注意机制的自然表达。

自上而下(Top-Down)的机制使用任务特定的上下文(context)来预测图像区域的注意力分布。然后,将参与的特征向量计算为所有区域图像特征的加权平均值。

三、相关工作

大量基于注意力的深度神经网络被提出用于图像字幕和VQA。通常,这些模型可以被描述为自顶向下(Top-Down)的方法。

这些方法确定图像区域的最佳数量时总是需要在粗和细的细节水平之间进行无法取胜的权衡。此外,区域相对于图像内容的任意定位可能使得难以检测与区域对齐不良的物体,并难以绑定与同一物体相关的视觉概念。

以前的工作相对较少考虑将注意力应用到突出的图像区域。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1017

1017