- Bagging

- Boosting

- Stacking

- 代码演示

集成算法目的:简单来说就是构建并结合多个学习分类器来完成学习任务,也称为多分类器系统。

例如:有分类任务,使用A分类器和B分类器分别做分类,再结合结果输出。当然有多种模式。

1.Bagging

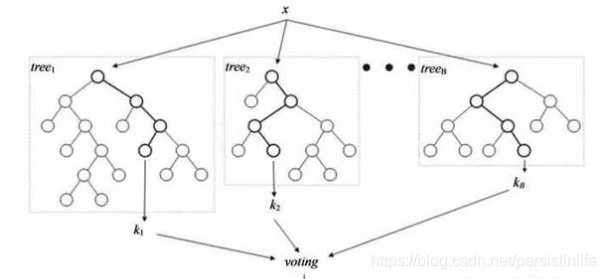

训练多个分类器取平均值

f ( x ) = 1 M ∑ m = 1 M f ( x ) f(x) = \frac{1}{M} \sum_{m=1}^M f(x) f(x)=M1m=1∑Mf(x)

也就是并行进行一堆分类器,最后求平均

代表的算法就是随机森林,各个tree之间不影响。

随机:数据随机采样(数据有放回的随机采样,特征采集随机采集)

2.Boosting

从弱学习器开始加强,通过加权来进行训练(类似与串行运行)

本文介绍了集成学习的三种主要方法:Bagging、Boosting和Stacking,并以随机森林为例,详细讲解了其工作原理。随机森林是一种基于Bagging的算法,通过数据的随机抽样和特征选择构建多个决策树,最后通过投票或平均决定最终结果。此外,文章还利用泰坦尼克号数据集展示了随机森林的实际应用,包括数据预处理和模型构建过程。

本文介绍了集成学习的三种主要方法:Bagging、Boosting和Stacking,并以随机森林为例,详细讲解了其工作原理。随机森林是一种基于Bagging的算法,通过数据的随机抽样和特征选择构建多个决策树,最后通过投票或平均决定最终结果。此外,文章还利用泰坦尼克号数据集展示了随机森林的实际应用,包括数据预处理和模型构建过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1512

1512

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?