问题

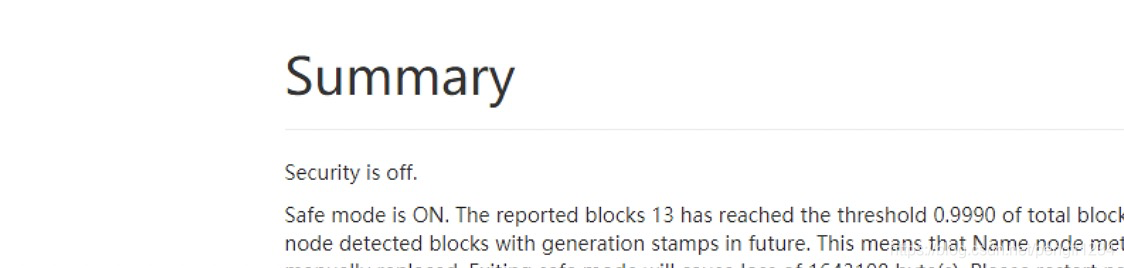

Hadoop集群启动的时候,一起处于安全模式中,无法自动退出。

问题产生原因

因为经常非正常关闭hadoop集群,如直接关闭虚拟机,导致hdfs中有些块丢失了或者损坏。这时hadoop就会进入安全模式。

处理

要先手动退出安全模式,再把损坏的block删掉就行。

退出安全模式

第一种:正常退出安全模式

hdfs dfsadmin -safemode leave

如提示Safe mode is OFF,那就说明退出成功,但有时候这个命令也没办法退出安全模式,就需要使用强制退出

第二种:强制退出安全模式

hdfs dfsadmin -safemode forceExit

safemode 后面可以接

- enter 进入安全模式

- get 获取安全模式的状态

- leave 退出安全模式

- forceExit 强制退出安全模式

- wait 等待安全模式结束

删除损坏的block

hdfs fsck / -delete

这时候就正常了。

当Hadoop集群因非正常关闭导致进入安全模式时,可以尝试手动退出。使用`hdfs dfsadmin -safemode leave`退出,若无效则用`hdfs dfsadmin -safemode forceExit`强制退出。接着,通过`hdfs fsck -delete`删除损坏的block。这些步骤能帮助恢复集群正常运行。

当Hadoop集群因非正常关闭导致进入安全模式时,可以尝试手动退出。使用`hdfs dfsadmin -safemode leave`退出,若无效则用`hdfs dfsadmin -safemode forceExit`强制退出。接着,通过`hdfs fsck -delete`删除损坏的block。这些步骤能帮助恢复集群正常运行。

9749

9749

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?