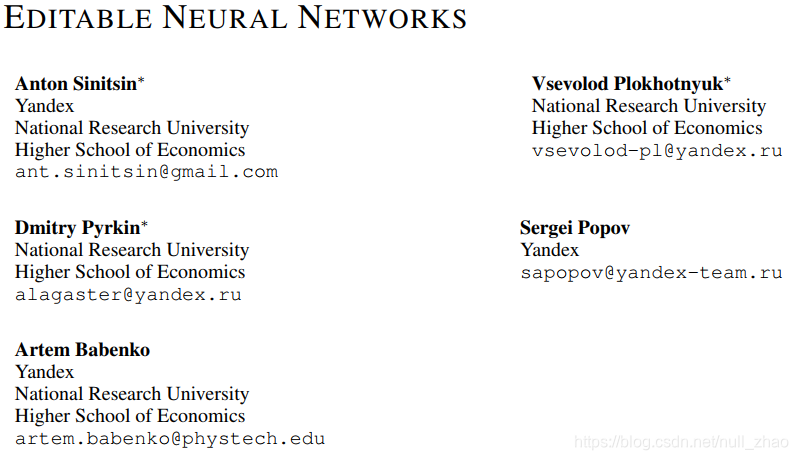

ICLR2020,居然是俄罗斯的经济学学校。

文章关注的问题是,如何有效地纠正模型在特定错误上的表现,而不至于影响模型总体性能。本文称其为Editable Training,相当于是一个新问题。(感觉有点类似小样本增量学习?)

1.Introduction

大部分模型,对单个输入的预测要依赖所有的模型参数,做特定纠正很难不影响模型在其它输入上的性能表现。

现有方法是:1.重训练 2.人工缓存(lookup table之类的)

本文提出一种Editable Training的方法。

2.Related work

解释下Editable Neural Networks的idea和以下几个领域的关联:

- meta-learning:ENN同属于此,“learn to allow effective patching”

- 灾难性遗忘:与CL不同,排除了序列任务假设

- 对抗训练:ENN可通过直接学习网络的脆弱样本解决这个问题

3.Editing Neural Networks

定义一下问题:

原模型 f(x,θ),参数θ由目标函数学习得到

编辑函数:

本文提出了可编辑训练(Editable Training)的概念,旨在修正模型在特定错误上的表现,同时保持整体性能。通过编辑函数和梯度下降编辑器,实现了对模型参数的局部调整。实验结果显示,该方法在CIFAR-10分类任务和机器翻译任务中表现出良好的效果,具有较高的编辑效率和局部性。

本文提出了可编辑训练(Editable Training)的概念,旨在修正模型在特定错误上的表现,同时保持整体性能。通过编辑函数和梯度下降编辑器,实现了对模型参数的局部调整。实验结果显示,该方法在CIFAR-10分类任务和机器翻译任务中表现出良好的效果,具有较高的编辑效率和局部性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

474

474

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?