Hadoop面试

HDFS

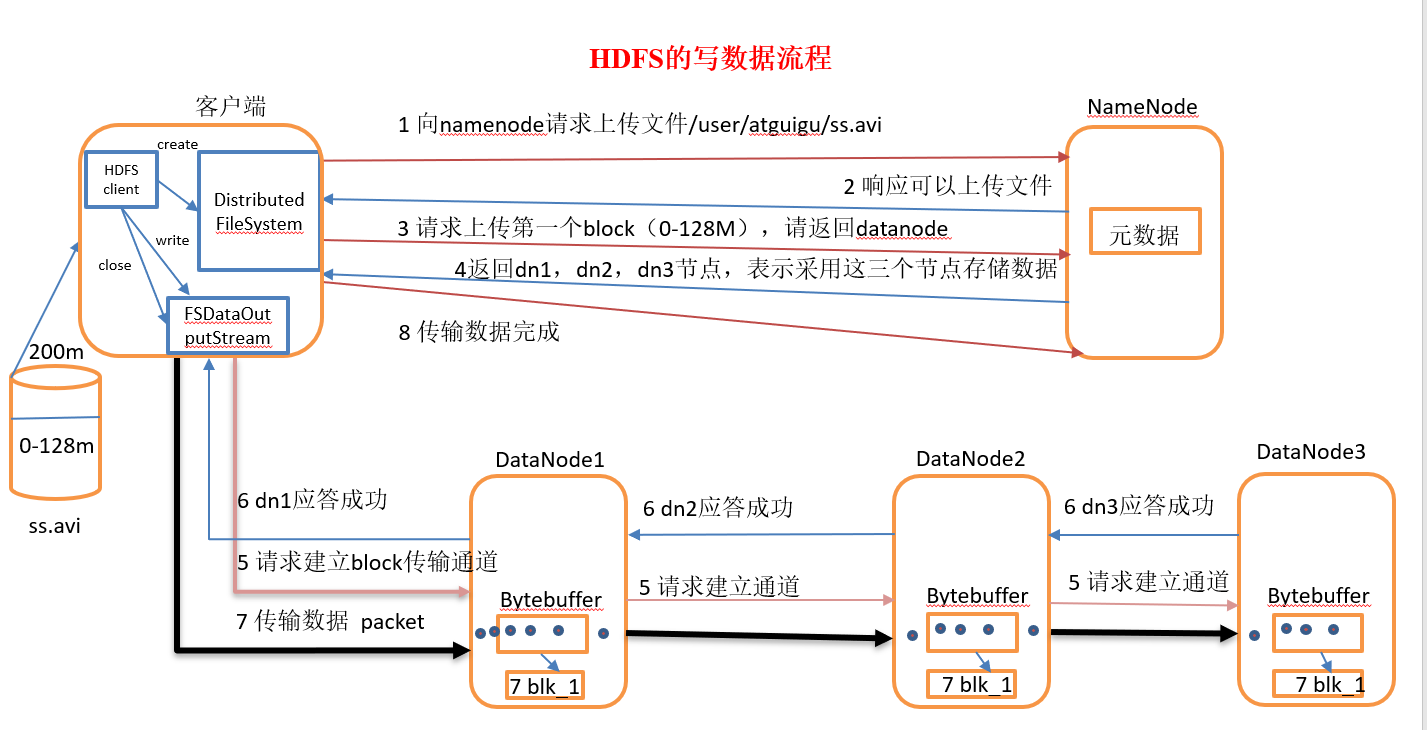

###1.hdfs写流程

(1)客户端通过 Distributed FileSystem 模块向 NameNode 通信请求上传文件,NameNode 检查目标文件是否已存在,父目录是否存在。

(2)NameNode 返回是否可以上传。

(3)客户端请求第一个 Block 上传到哪几个 DataNode 服务器上。

(4)NameNode 返回 3 个 DataNode 节点,分别为 dn1、dn2、dn3。

(5)客户端通过 FSDataOutputStream 模块请求 dn1 上传数据(本质上是一个RPC调用,建立pipeline),dn1 收到请求会继续调用 dn2,然后 dn2 调用 dn3,将这个通信管道建立完成。

(6)dn1、dn2、dn3 逐级应答客户端。

(7)客户端开始往 dn1 上传第一个 Block(先从磁盘读取数据放到一个本地内存缓存), 以 Packet 为单位,dn1 收到一个 Packet 就会传给 dn2,dn2 传给 dn3;dn1 每传一个 packet 会放入一个应答队列等待应答。

(8)当一个 Block 传输完成之后,客户端再次请求 NameNode 上传第二个 Block 的服务 器。(重复执行 3-7 步)

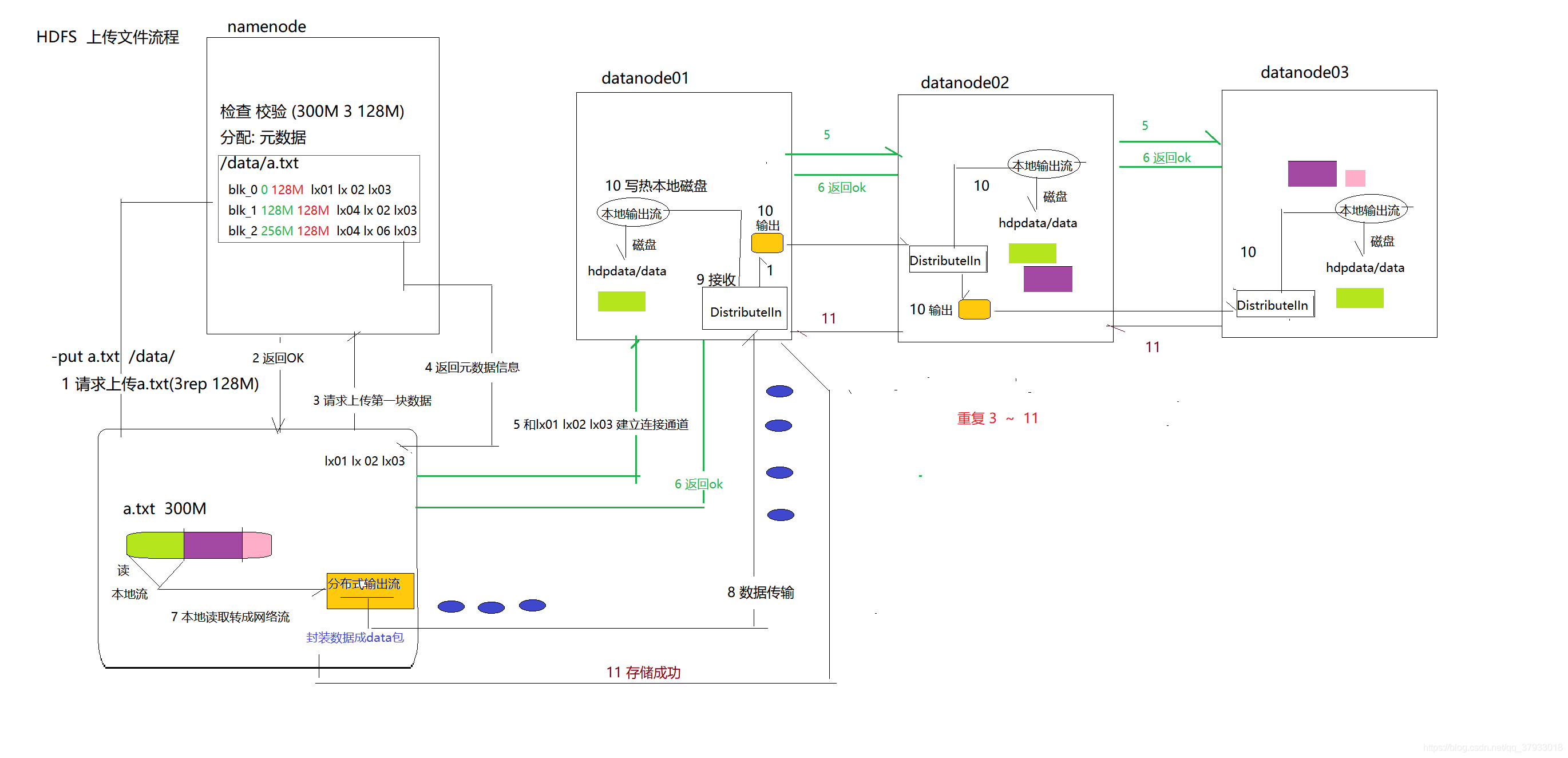

###行哥版:

1 客户端请求namenode上传文件数据(大小 , 物理切块大小, 副本个数)

2 namenode接收到客户端的上传请求以后, 各种校验(权限 , 存储容量,分配元数据信息)

3 客户端收到namenode的ok响应

4 客户端请求namenode上传第一块数据, NN返回第一块数据的元信息

5 客户端和返回的元数据中的3台机器建立连接通道 ,

6 返回OK

7 客户端本地读取待上传文件的第一块数据的内容 io.read length=128M

8 本地流一边读取数据 一边转换成分布式输出流(DistributeOutputStream)[封装字节数据为数据包 提高传输效率]

9 分布式输出流输出数据包到lx01在lx01上接收数据, 一边写到本地 一边输出给linux02 Linux02 传输给Linux03

10 linux01 02 03 都会将数据存储到本地的指定目录, 目录结构一样

11 当集群中有一个数据块存储成功 , 当次上传的数据块就是成功 , 如果副本个数不够,后续的NN会自动维护副本个数

12 返回ok 上传成功

上传后续的数据块的流程执行 4 — 12 步

在数据上传过程中要注意,客户端在将数据传输到第一个节点后,如果这个过程中这个节点宕机,或者发生其他情况,导致数据无法正常上传,那么数据就会上传失败,主节点会重新规划元数据,然后进行再次的上传,如果客户端已经成功的将数据块上传到第一个节点上后,那么这个数据块就是上传成功了,在第一个节点将数据的副本传输到其他节点上时,某个接收数据副本的节点宕机了,不会影响第一个节点将数据上传成功的信息返回给客户端,后续会根据datanode和namenode的心跳机制,将数据的副本存储到其他节点上的.

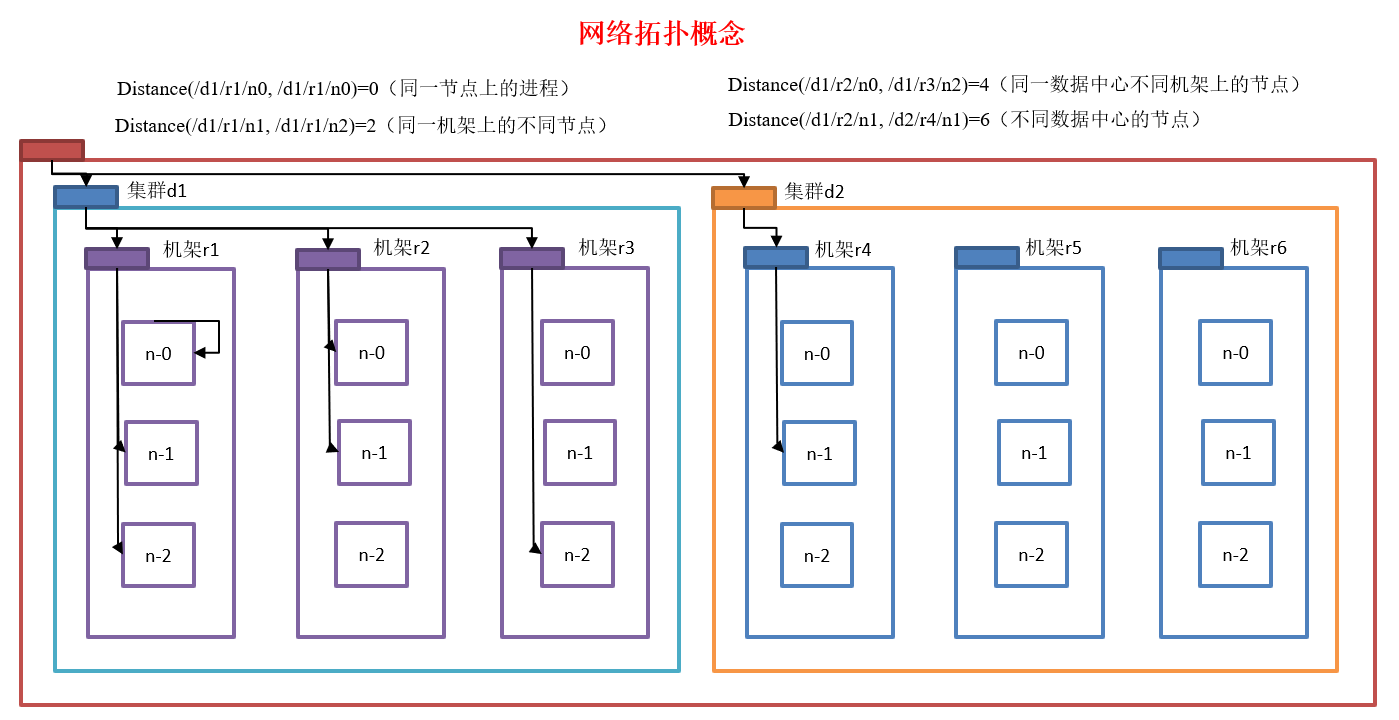

2.网络拓扑-节点距离计算

在 HDFS 写数据的过程中,NameNode 会选择距离待上传数据最近距离的 DataNode 接 收数据。那么这个最近距离怎么计算呢?

节点距离:两个节点到达最近的共同祖先的距离总和。

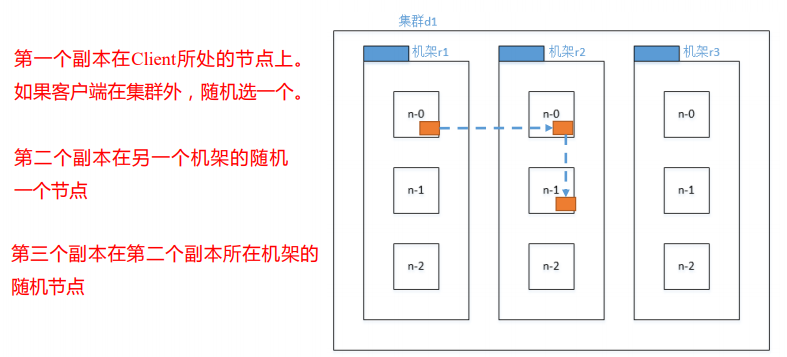

3.机架感知(副本存储节点选择)

1)机架感知说明

(1)官方说明 http://hadoop.apache.org/docs/r3.1.3/hadoop-project-dist/hadoop-hdfs/HdfsDesign.html#Data_Replication

For the common case, when the replication factor is three, HDFS’s placement policy is to put one replica on the local machine if the writer is on a datanode, otherwise on a random datanode, another replica on a node in a different (remote) rack, and the last on a different node in the same remote rack. This policy cuts the inter-rack write traffic which generally improves write performance. The chance of rack failure is far less than that of node failure; this policy does not impact data reliability and availability guarantees. However, it does reduce the aggregate network bandwidth used when reading data since a block is placed in only two unique racks rather than three. With this policy, the replicas of a file do not evenly distribute across the racks. One third of replicas are on one node, two thirds of replicas are on one rack, and the other third are evenly distributed across the remaining racks. This policy improves write performance without compromising data reliability or read performance.

(2)源码说明 Crtl + n 查找 BlockPlacementPolicyDefault,在该类中查找 chooseTargetInOrder 方法。

2)Hadoop3.1.3 副本节点选择

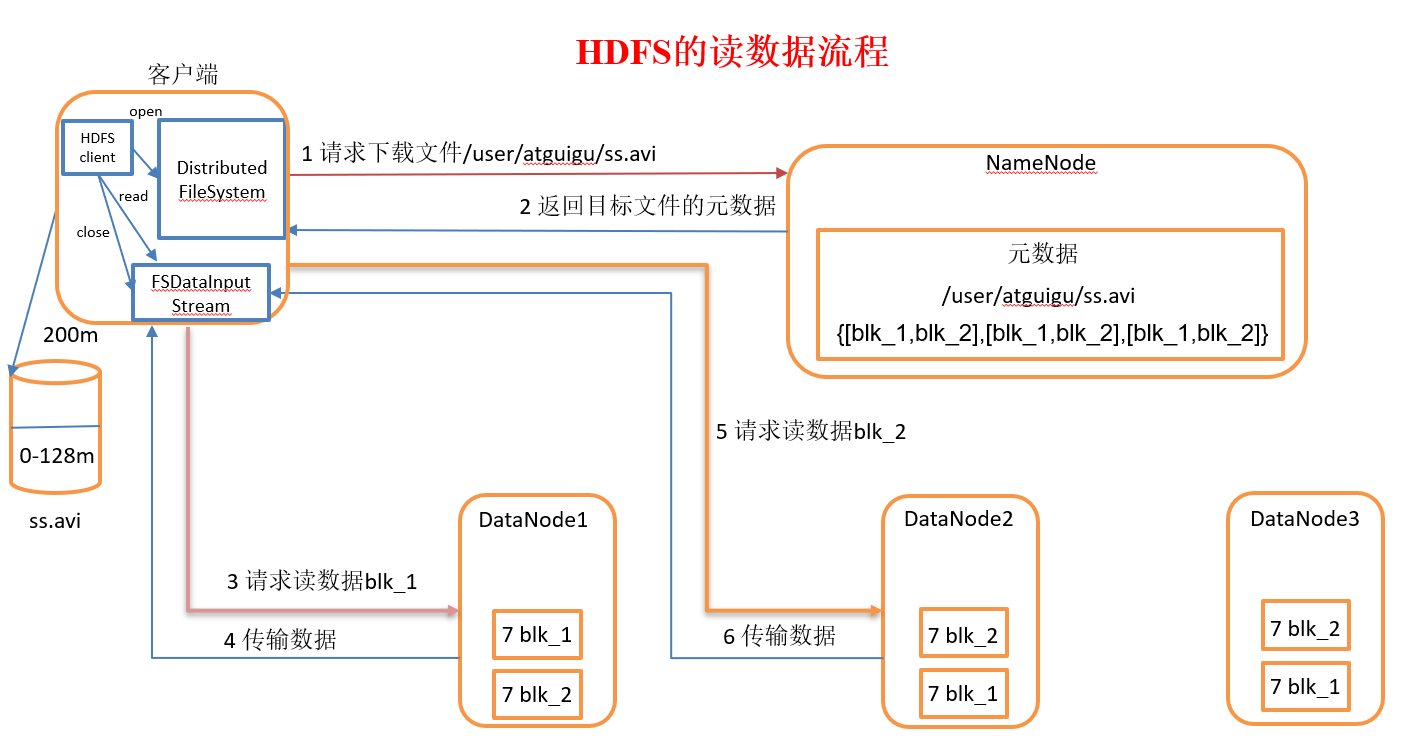

###4.hdfs读流程

(1)客户端通过 DistributedFileSystem 向 NameNode 请求下载文件,NameNode 通过查 询元数据,找到文件块所在的 DataNode 地址。

(2)挑选一台 DataNode(就近原则,然后随机)服务器,请求读取数据。

(3)DataNode 开始传输数据给客户端(从磁盘里面读取数据输入流,以 Packet 为单位 来做校验)。

(4)客户端以 Packet 为单位接收,先在本地缓存,然后写入目标文件。

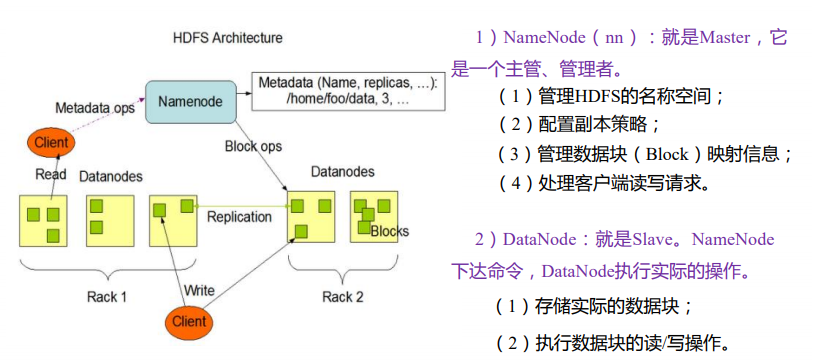

###5.hdfs的体系结构

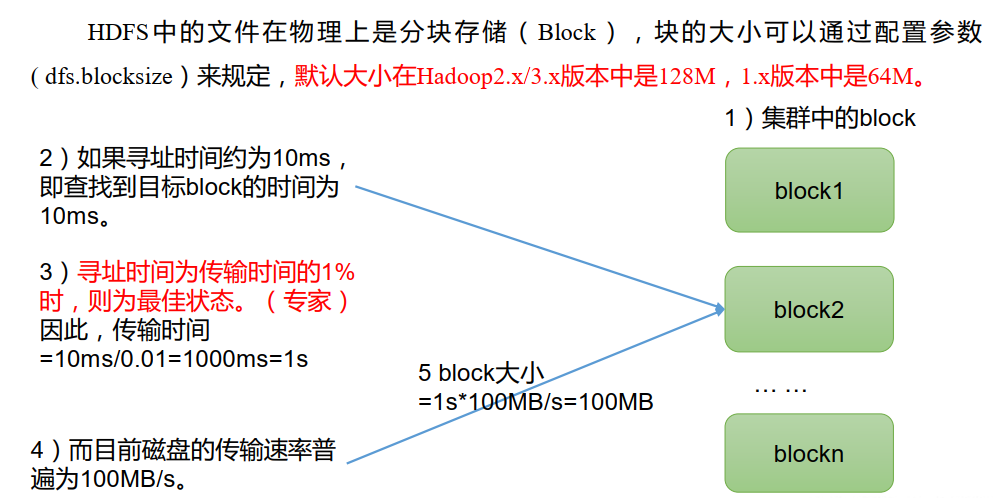

###6.HDFS 文件块大小

思考:为什么块的大小不能设置太小, 也不能设置太大?

( 1) HDFS的块设置太小, 会增加寻址时间, 程序一直在找块的开始位置;

( 2) 如果块设置的太大, 从磁盘传输数据的时间会明显大于定位这个块开

始位置所需的时间。 导致程序在处理这块数据时, 会非常慢。

总结: HDFS块的大小设置主要取决于磁盘传输速率。

7.一个datanode 宕机,怎么一个流程恢复

Datanode宕机了后,如果是短暂的宕机,可以实现写好脚本监控,将它启动起来。如果是长时间宕机了,那么datanode上的数据应该已经被备份到其他机器了,那这台datanode就是一台新的datanode了,删除他的所有数据文件和状态文件,重新启动。

8.hadoop 的 namenode 宕机,怎么解决

先分析宕机后的损失,宕机后直接导致client无法访问,内存中的元数据丢失,但是硬盘中的元数据应该还存在,如果只是节点挂了,重启即可,如果是机器挂了,重启机器后看节点是否能重启,不能重启就要找到原因修复了。但是最终的解决方案应该是在设计集群的初期就考虑到这个问题,做namenode的HA。

9.namenode对元数据的管理

namenode对数据的管理采用了三种存储形式:

- 内存元数据(NameSystem)

- 磁盘元数据镜像文件(fsimage镜像)

- 数据操作日志文件(可通过日志运算出元数据)(edit日志文件)

10.NN 和 2NN 工作机制 (了解就行)

思考: NameNode 中的元数据是存储在哪里的?

首先,我们做个假设,如果存储在 NameNode 节点的磁盘中,因为经常需要进行随机访

问,还有响应客户请求,必然是效率过低。因此,元数据需要存放在内存中。但如果只存在

内存中,一旦断电,元数据丢失,整个集群就无法工作了。 因此产生在磁盘中备份元数据的

FsImage。

这样又会带来新的问题,当在内存中的元数据

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?