向大家安利一篇CVPR 2020的论文 HOPE-Net: A Graph-based Model for Hand-Object Pose Estimation,基于自适应图卷积技术,作者提出了一种称之为HOPE-Net的“人手-物体”姿势估计模型,在这个问题上不仅计算结果精度更高、速度也更快,GPU上达到实时!而且代码已开源。

以下是作者信息:

作者来自美国印第安纳大学和华盛顿大学。

何为“人手-物体”姿势估计?

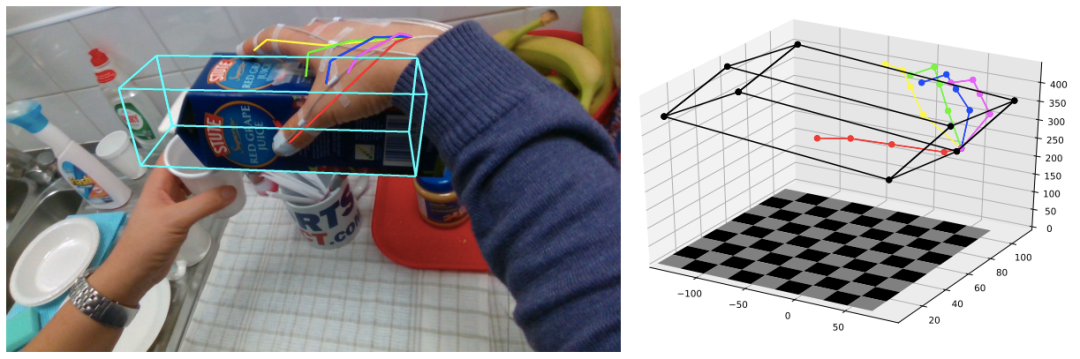

如下图所示:

在手拿物体这个动作时,对人手和物体分别进行3D检测,输出物体的2D和3D顶点和手部的关节点。对于理解场景中的人-物交互可以带来很多信息。

提出算法

下图为作者提出算法的流程图:

CVPR 2020论文HOPE-Net提出了一种基于自适应图卷积的"人手-物体"姿态估计算法,实现高精度、快速的3D检测,已在GPU上实现实时运行。该模型通过轻量级CNN和图卷积网络提升2D到3D坐标的准确性,并在First-Person Hand Action和HO-3D数据集上取得优异效果。代码已开源。

CVPR 2020论文HOPE-Net提出了一种基于自适应图卷积的"人手-物体"姿态估计算法,实现高精度、快速的3D检测,已在GPU上实现实时运行。该模型通过轻量级CNN和图卷积网络提升2D到3D坐标的准确性,并在First-Person Hand Action和HO-3D数据集上取得优异效果。代码已开源。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?