1. Introduction

- GPT-3含有175B参数使用了570GB的数据进行训练。但大多数语料是基于英文(93%),并且GPT-3的参数没有分布,所以提出了CPM(Chinese Pretrained language Model):包含2.6B参数,使用100GB中文训练数据。

- CPM可以对接下游任务:对话、文章生成、完形填空、语言理解。

- 随着参数规模的增加,CPM在一些数据集上表现更好,表示大模型在语言生成和理解上面更有效。

- 文章的主要贡献

- 发布了一个CPM:2.6B参数,100GB中文训练数据

- 我们在分词语料库的基础上构建了一种新的子词词汇来适应汉语语料库,并将批处理量增加到3072个,以获得更稳定的模型训练

- 在小样本甚至0样本中得到较好的性能

2. Approach

2.1 Chinese PLM

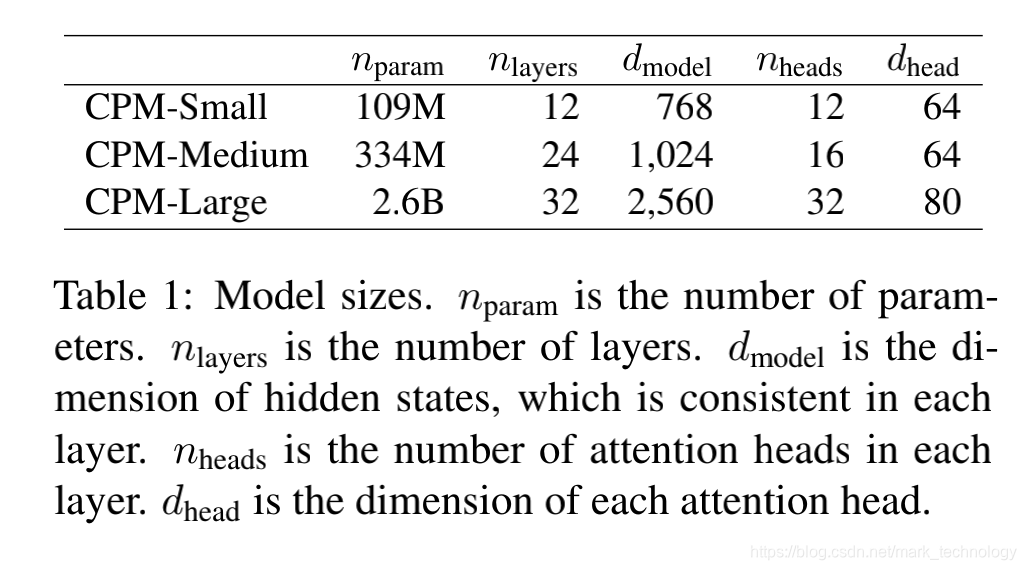

CPM的模型架构与GPT的架构类似(从左到右的Transformer encoder),下图是三个不同规模的预训练模型

为了使CPM适配中文语料,build a new sub-word vocabulary and adjust the training batch size

**Vocabulary construction:**BERT-Chinese(2019)是characters-level的词汇表,失去了中文词汇的意思,这里构建了一个新的词汇表:单词和字级别

**Training Strategy:**中文的离散分布比英文更严重,在训练阶段,采用了比GP

本文介绍了CPM,一个2.6B参数的中文预训练语言模型,使用100GB中文数据训练。CPM在对话、文章生成、完形填空和语言理解等任务中表现出色。与GPT架构类似,CPM针对中文特点构建了新的子词词汇,并采用大批次训练策略。实验结果显示,CPM在文本分类、成语填空、对话生成、问答系统和实体生成等多个任务中取得良好效果。

本文介绍了CPM,一个2.6B参数的中文预训练语言模型,使用100GB中文数据训练。CPM在对话、文章生成、完形填空和语言理解等任务中表现出色。与GPT架构类似,CPM针对中文特点构建了新的子词词汇,并采用大批次训练策略。实验结果显示,CPM在文本分类、成语填空、对话生成、问答系统和实体生成等多个任务中取得良好效果。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3143

3143

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?