-

NB的原理

朴素贝叶斯法是基于贝叶斯定理与特征条件独立假设的分类方法。对于给定的待分类项xxx,通过学习到的模型计算后验概率分布,即:在此项出现的条件下各个目标类别出现的概率,将后验概率最大的类作为xxx所属的类别。 -

朴素贝叶斯朴素在哪里?

在计算条件概率分布P(X=x∣Y=ck)P\left( X=x|Y=c_k\right)P(X=x∣Y=ck)时,NB引入了一个很强的条件独立假设,即,当YYY确定时,XXX的各个特征分量取值之间相互独立。 -

怎么理解朴素贝叶斯中的“朴素”?

因为它假定所有的特征在数据集中的作用是独立同分布的,但这个假设在现实生活中很不真实,因此很“朴素”。 -

为什么引入条件独立性假设?

为了避免贝叶斯定理求解时面临的组合爆炸、样本稀疏问题。假设条件概率分为P(X=x∣Y=ck)=P(X(1)=x(1),...,x(n)=x(n)∣Y=ck)P\left( X=x|Y=c_k\right) = P\left( X^{(1)}=x^{(1)},...,x^{(n)}=x^{(n)}|Y=c_k\right)P(X=x∣Y=ck)=P(X(1)=x(1),...,x(n)=x(n)∣Y=ck)其中x(j)x^{(j)}x(j)可能取值有SjS_jSj个,j=1,2,...,nj=1,2,...,nj=1,2,...,n,YYY可能取值有KKK个,那么参数个数为K∏j=1nSjK\prod_{j=1}^nS_jK∏j=1nSj个,这就导致条件概率分布的参数数量为指数级别。 -

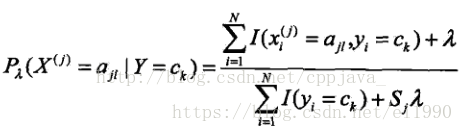

在估计条件概率P(X∣Y)P(X|Y)P(X∣Y)时出现概率为0的情况怎么办?

解决这一问题的方法是采用贝叶斯估计。简单来说,引入λ\lambdaλ,当λ=1\lambda=1λ=1时,就是普通的极大似然估计;当λ=1\lambda=1λ=1时称为拉普拉斯平滑。 -

为什么属性独立性假设在实际情况中很难成立,但朴素贝叶斯仍能取得较好的效果?

- 人们在使用分类器之前,首先做的第一步(也是最重要的一步)往往是特征选择,这个过程的目的就是为了排除特征之间的共线性、选择相对较为独立的特征;

- 对于与分类任务来说,只要各类别的条件概率排序正确,无需精准概率值就可以导致正确分类;

- 如果属性间依赖对所有类别影响相同,或依赖关系的影响能相互抵消,则属性条件独立性假设在降低计算复杂度的同时不会对性能产生负面影响。

-

为什么要后验概率最大化?

等价于期望风险最小化。假设选取0-1损失函数,即分类正确取1,错误取0,这时的期望风险最小化为

-

朴素贝叶斯的优缺点

- 优点

- 朴素贝叶斯模型发源于古典数学理论,有着坚实的数学基础,以及稳定的分类效率;

- 对小规模数据表现很好,能够处理多分类任务,适合增量式训练;

- 适用于文本分类任务,对待预测样本进行预测时,过程简单速度快(想想邮件分类的问题,预测急救室分词后进行概率乘积,在log域直接做加法更快)。

- 缺点

- 特征条件独立性假设在实际应用中往往是不成立的,在属性个数比较多或者属性之间相关性较大时,分类效果不好。而在属性相关性较小时,朴素贝叶斯性能最为良好;

- 需要计算先验概率,而先验概率很多时候取决于假设,假设的模型可以有很多种,因此在某些时候会由于假设的先验模型的原因导致预测效果不佳;

- 对输入数据的表达形式很敏感(离散、连续、值极大极小之类的)。

- 优点

-

朴素贝叶斯与LR的区别?

(1)简单来说:- 朴素贝叶斯是生成模型,根据已有样本进行贝叶斯估计学习出先验概率P(Y)和条件概率P(X|Y),进而求出联合分布概率P(XY),最后利用贝叶斯定理求解P(Y|X), 而LR是判别模型,根据极大化对数似然函数直接求出条件概率P(Y|X);

- 朴素贝叶斯是基于很强的条件独立假设(在已知分类Y的条件下,各个特征变量取值是相互独立的),而LR则对此没有要求;

- 朴素贝叶斯适用于数据集少的情景,而LR适用于大规模数据集。

(2)进一步说明:前者是生成式模型,后者是判别式模型,二者的区别就是生成式模型与判别式模型的区别。

- 首先,Navie Bayes通过已知样本求得先验概率P(Y), 及条件概率P(X|Y), 对于给定的实例,计算联合概率,进而求出后验概率。也就是说,它尝试去找到底这个数据是怎么生成的(产生的),然后再进行分类。哪个类别最有可能产生这个信号,就属于那个类别。

- 优点: 样本容量增加时,收敛更快;隐变量存在时也可适用。

- 缺点:时间长;需要样本多;浪费计算资源

- 相比之下,Logistic回归不关心样本中类别的比例及类别下出现特征的概率,它直接给出预测模型的式子。设每个特征都有一个权重,训练样本数据更新权重w,得出最终表达式。梯度法。

- 优点:直接预测往往准确率更高;简化问题;可以反应数据的分布情况,类别的差异特征;适用于较多类别的识别。

- 收敛慢;不适用于有隐变量的情况。

-

算法问题

实际项目中,概率值往往是很小的小数,连续微小小数相乘容易造成下溢出使乘积为0.

解决方法:对乘积取自然对数,将连乘变为连加。

另外需要注意:给出的特征向量长度可能不同,这是需要归一化为通长度的向量(这里以文本分类为例),比如说是句子单词的话,则长度为整个词汇量的长度,对应位置是该单词出现的次数。 -

先验条件概率的计算方法

- 离散分布时:统计训练样本中每个类别出现的频率。若某一特征值的概率为0会使整个概率乘积变为0(称为数据稀疏),这破坏了各特征值地位相同的假设条件。

- 解决方法一:采用贝叶斯估计(λ=1 时称为拉普拉斯平滑):

- 解决方法二:通过聚类将未出现的词找出系统关键词,根据相关词的概率求平均值。

- 解决方法一:采用贝叶斯估计(λ=1 时称为拉普拉斯平滑):

- 连续分布时:假定其值服从高斯分布(正态分布)。即计算样本均值与方差。

- 离散分布时:统计训练样本中每个类别出现的频率。若某一特征值的概率为0会使整个概率乘积变为0(称为数据稀疏),这破坏了各特征值地位相同的假设条件。

参考资料:

https://www.cnblogs.com/zhibei/p/9394758.html

https://blog.youkuaiyun.com/dinkwad/article/details/78842338

https://blog.youkuaiyun.com/han_xiaoyang/article/details/50629608

微信关注博主:挑灯看剑王知事

本文深入解析朴素贝叶斯算法的原理,探讨其基于贝叶斯定理与特征条件独立假设的分类方法,以及在文本分类等场景中的应用优势与局限。通过对比逻辑回归,阐明两者在模型性质上的区别。

本文深入解析朴素贝叶斯算法的原理,探讨其基于贝叶斯定理与特征条件独立假设的分类方法,以及在文本分类等场景中的应用优势与局限。通过对比逻辑回归,阐明两者在模型性质上的区别。

546

546