MapReduce是什么?

1.我们不采用框架需要考虑机器和机器之间是怎么通信的

2.我们现在只需要自己处理业务问题和相关代码+mapreduce自身的默认代码

3.是一个分布式运算程序的编程框架,是用户开发基于hadoop的分析的核心框架

4.核心功能是将用户编写的业务逻辑代码和自带默认组件整合成了一个完整的分布式运算程序,分布在hadoop集群上

为什么要用MapReduce?

易于编程,它能实现一系列的接口,就可以完成一个分布式程序,这个分布式程序可以分布到大量廉价的pc的机器上运行,这个特点使得Mapreduce编程变的非常流行

良好的扩展性 ,可以动态增加服务器,解决资源有时候不够用的情况

高容错性,出错时可以转移到其它节点

适合海量数据的计算

但是它也有点瑕疵的地方:

不适合实时计算,适用于离线计算,不擅长DAG计算

MR架构

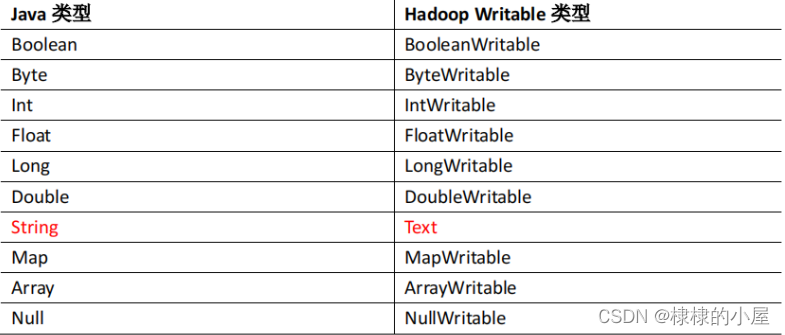

数据类型

编程规范

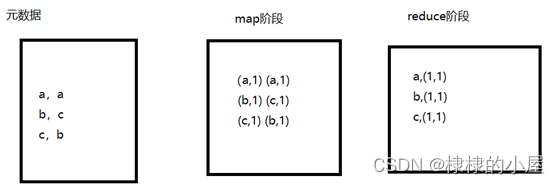

Mapper阶段:

用户自定义mapper要继承父类

mapper输入,输出必须是key-value形式

Reduce阶段:

用户自定义reduce要继承父类

map输出的类型要对应reduce输入的类型

reduce的业务逻辑在reduce方法中

代码展现

将一下配置粘到pom.xml

<dependencies>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.13</version>

</dependency>

<dependency>

<groupId>org.apache.logging.log4j</groupId>

<artifactId>log4j-core</artifactId>

<version>2.8.2</version>

</dependency>

<!-- 辅助模块包 -->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>2.7.2</version>

</dependency>

<!-- 包含mr -->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>2.7.2</version>

</dependency>

<!-- hdfs -->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-hdfs</artifactId>

<version>2.7.2</version>

</dependency>

</dependencies>

编写Mapper类

public class Mapper1 extends Mapper<LongWritable, Text, Text, IntWritable> {

@Override

protected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

//获取一行字符串并用文件中所有的格式进行切割

//试过\t和 | 切割都有问题

String [] s = value.toString().split(",");

//遍历数组

for(String str:s){

//输出

context.write(new Text(str),new IntWritable(1))

);

}

}

}

编写reduce类

public class Reduce1 extends Reducer<Text, IntWritable,Text,IntWritable> {

private IntWritable out=new IntWritable();

@Override

protected void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum=0;

for (IntWritable value : values) {

//把IntWritable转成int类型

sum+=value.get();

}

out.set(sum);

//key 就是map传来对的key

context.write(key,out);

}

}

编写Driver类

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.junit.Test;

import java.io.IOException;

public class Driver1 {

@Test

public void test() throws IOException, ClassNotFoundException, InterruptedException {

//获取job

Configuration conf=new Configuration();

Job job = Job.getInstance(conf);

// 设置jar包

job.setJarByClass(Driver1.class);

// 关联mapper和reduce

job.setMapperClass(Mapper1.class);

job.setReducerClass(Reduce1.class);

// 设置map输出出的kv类型

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(IntWritable.class);

//设置最终输出的kv类型

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

//设置输入路径和输出路径

FileInputFormat.setInputPaths(job,new Path("D:\\hadoop\\input"));

FileOutputFormat.setOutputPath(job,new Path("D:\\hadoop\\output"));

//提交job

boolean result = job.waitForCompletion(true);

System.exit(result ? 0 : 1);

}

}

总结

Mapreduce适合离线计算,不适合实时计算,分为map和reduce,通过ke-value的形式进行计算,map的输出类型要保证和reduce的输入类型保持一致,先进行map转换在通过reduce聚合计算.

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?