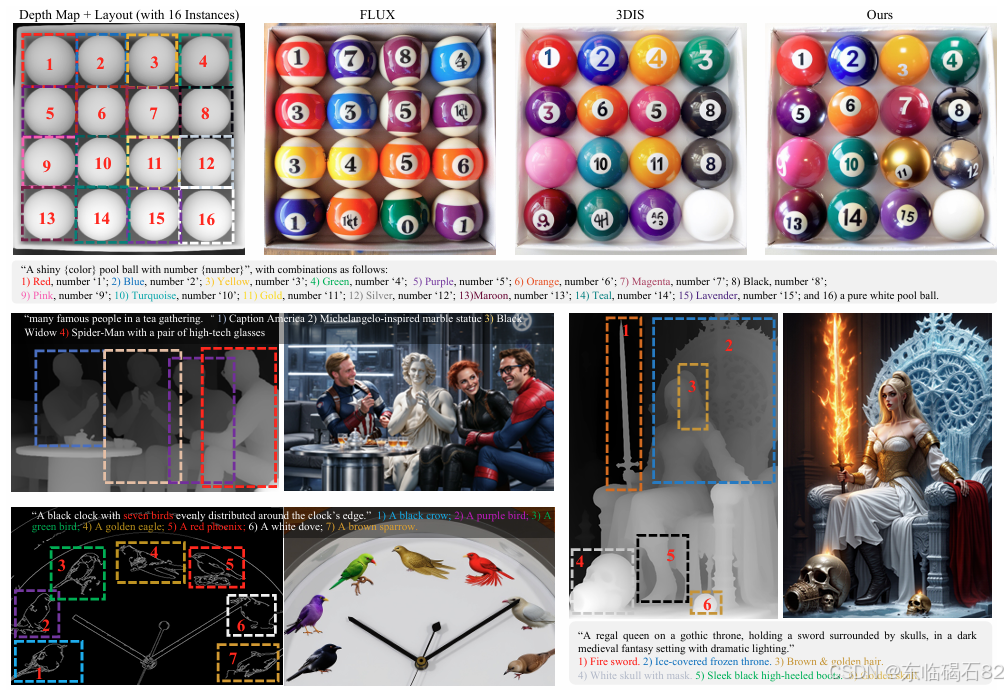

摘要:基于图像条件的生成方法,如基于深度和边缘检测的生成方法,在精确图像合成方面已展现出卓越的能力。然而,现有模型在准确控制多个实例(或区域)的内容方面仍存在困难。即便是像FLUX和3DIS这样的最先进模型,也面临着实例间属性泄露等挑战,这限制了用户的控制能力。为了解决这些问题,我们引入了DreamRenderer,这是一种基于FLUX模型的无需训练的方法。DreamRenderer允许用户通过边界框或掩码来控制每个实例的内容,同时确保整体视觉的和谐。我们提出了两项关键创新:1)用于硬性文本属性绑定的桥接图像标记,该方法使用复制的图像标记作为桥接标记,以确保仅在文本数据上预训练的T5文本嵌入在联合注意力期间为每个实例绑定正确的视觉属性;2)仅应用于关键层的硬性图像属性绑定。通过对FLUX的分析,我们确定了负责实例属性渲染的关键层,并仅在这些层中应用硬性图像属性绑定,而在其他层中使用软绑定。这种方法确保了精确控制的同时保持了图像质量。在COCO-POS和COCO-MIG基准上的评估表明,DreamRenderer相较于FLUX将图像成功率提高了17.7%,并将GLIGEN和3DIS等布局到图像模型的性能提升了高达26.8%。项目页面:https://limuloo.github.io/DreamRenderer/。Huggingface链接:Paper page,论文链接:2503.12885

研究背景和目的

研究背景

随着人工智能技术的飞速发展,文本到图像(Text-to-Image, T2I)生成技术在多个领域展现出了巨大的应用潜力,如艺术创作、广告设计、虚拟现实等。然而,尽管现有的T2I模型在生成高质量图像方面取得了显著进展,但在处理多实例(或区域)内容的精确控制方面仍面临挑战。特别是在复杂的场景中,当需要同时控制多个物体的属性时,现有模型往往难以准确区分和绑定每个实例的文本描述与其对应的视觉属性,导致属性泄露等问题,从而限制了用户的创造力和控制能力。

具体来说,传统的T2I模型,如基于GAN(生成对抗网络)或扩散模型的方法,通常依赖于单一的文本嵌入来指导整个图像的生成过程。这种方法在处理单个实例时表现良好,但在处理多实例场景时,由于文本嵌入缺乏对每个实例的视觉属性的明确绑定机制,因此容易在实例间产生属性混淆。此外,一些最新的模型,如FLUX和3DIS,虽然在一定程度上提高了多实例生成的准确性,但仍存在属性泄露等问题,无法完全满足用户对精确控制的需求。

因此,研究一种能够有效解决多实例属性控制问题的方法,对于提升T2I生成技术的实用性和创造力具有重要意义。这不仅能够拓宽T2I技术的应用范围,还能够为用户提供更加灵活和强大的创作工具。

研究目的

本文旨在提出一种新颖的方法,即DreamRenderer,以解决大规模T2I模型中的多实例属性控制问题。具体来说,本文的研究目的包括以下几个方面:

-

提出一种无需训练的多实例属性控制方法:基于现有的FLUX模型,开发一种无需额外训练的方法,通过引入创新的机制来实现对多实例属性的精确控制。

-

实现精确的多实例属性绑定:通过提出硬性文本属性绑定(Hard Text Attribute Binding)和硬性图像属性绑定(Hard Image Attribute Binding)两种技术,确保每个实例的文本描述能够准确地绑定到其对应的视觉属性上,避免属性泄露等问题。

-

保持整体视觉的和谐性:在精确控制每个实例属性的同时,确保生成的图像在整体上保持视觉的和谐性,不会出现因过度约束而导致的图像质量下降或视觉不连贯等问题。

-

验证方法的有效性和优越性:通过在多个基准数据集上进行实验,验证DreamRenderer在多实例属性控制方面的有效性和优越性,并与现有的方法进行对比分析。

研究方法

方法概述

本文提出的DreamRenderer方法是一种基于FLUX模型的无需训练的多实例属性控制方法。该方法通过引入硬性文本属性绑定和硬性图像属性绑定两种技术,实现了对多实例属性的精确控制。

硬性文本属性绑定

硬性文本属性绑定技术使用复制的图像标记作为桥接标记,确保在联合注意力期间,T5文本嵌入(仅在文本数据上预训练)能够为每个实例绑定正确的视觉属性。具体来说,对于每个实例,DreamRenderer会复制其图像标记作为桥接标记,并将这些桥接标记与文本标记一起参与联合注意力机制。在联合注意力过程中,每个实例的文本标记和桥接标记只会关注彼此,而不会关注其他实例的标记,从而确保文本嵌入能够准确地绑定到对应的视觉属性上。

硬性图像属性绑定

硬性图像属性绑定技术通过在FLUX模型的关键层中应用硬性图像属性绑定,确保每个实例的图像标记在渲染过程中能够保留正确的视觉属性。通过对FLUX模型各层的分析,我们确定了负责实例属性渲染的关键层,并仅在这些层中应用硬性图像属性绑定,而在其他层中使用软绑定。这种方法能够在保持精确控制的同时,避免对整体图像质量产生负面影响。

实验设置

为了验证DreamRenderer的有效性和优越性,我们在多个基准数据集上进行了实验。具体来说,我们选择了COCO-POS和COCO-MIG两个基准数据集进行测试。COCO-POS数据集要求根据指定的布局生成图像,而COCO-MIG数据集则测试多实例生成的准确性和位置控制。在实验过程中,我们使用了多种评估指标来全面衡量DreamRenderer的性能,包括图像成功率(Image Success Ratio, ISR)、实例成功率(Instance Success Ratio, ISR)、平均交并比(Mean Intersection over Union, MIoU)和平均精度(Average Precision, AP)等。

研究结果

定量结果

在COCO-POS基准数据集上,DreamRenderer相较于FLUX模型在图像成功率、实例成功率、平均交并比和平均精度等评估指标上均取得了显著的提升。具体来说,DreamRenderer的图像成功率达到了62.50%,相较于FLUX模型的53.88%提高了8.62个百分点;实例成功率达到了94.51%,相较于FLUX模型的85.13%提高了9.38个百分点;平均交并比达到了84.36%,相较于FLUX模型的76.86%提高了7.50个百分点;平均精度达到了58.95%,相较于FLUX模型的50.72%提高了8.23个百分点。

在COCO-MIG基准数据集上,DreamRenderer同样展现出了优越的性能。通过将DreamRenderer集成到现有的布局到图像模型(如GLIGEN、InstanceDiffusion、MIGC和3DIS)中,我们能够显著提升这些模型的性能。具体来说,DreamRenderer将GLIGEN的图像成功率提升了26.8%,将InstanceDiffusion的图像成功率提升了19.9%,将MIGC的图像成功率提升了8.3%,将3DIS的图像成功率提升了7.4%。

定性结果

除了定量结果外,我们还通过可视化分析来进一步验证DreamRenderer的有效性。通过对比DreamRenderer生成的图像与FLUX模型生成的图像,我们可以清晰地看到DreamRenderer在精确控制多实例属性方面的优势。例如,在包含多个物体的复杂场景中,DreamRenderer能够准确地根据用户指定的文本描述生成对应的物体,并且每个物体的属性都得到了精确的渲染和控制。

研究局限

尽管DreamRenderer在多实例属性控制方面取得了显著的进展,但仍存在一些局限性。首先,DreamRenderer是基于现有的FLUX模型开发的,因此其性能受到FLUX模型本身能力的限制。如果FLUX模型在处理某些复杂场景或物体时表现不佳,那么DreamRenderer的性能也会受到影响。其次,DreamRenderer在处理大规模场景或包含大量实例的图像时可能会面临计算效率的挑战。由于需要为每个实例分配独立的文本和图像标记,并在联合注意力过程中进行复杂的交互计算,因此当实例数量增多时,计算量也会显著增加。

未来研究方向

针对上述局限性,未来的研究工作可以从以下几个方面展开:

-

探索更高效的多实例属性控制方法:研究更加高效和鲁棒的多实例属性控制方法,以减少对基础模型的依赖并提高计算效率。例如,可以尝试将深度学习方法与图论、优化理论等相结合,来开发更加智能和高效的多实例属性控制算法。

-

提升基础模型的性能:通过改进和优化基础模型(如FLUX模型)的性能来提升DreamRenderer的整体表现。例如,可以尝试引入更先进的神经网络结构、优化算法或训练策略来提高基础模型的生成能力和泛化能力。

-

拓展应用场景:将DreamRenderer应用于更多的实际场景中,如艺术创作、广告设计、虚拟现实等,以验证其在实际应用中的有效性和实用性。同时,根据具体应用场景的需求对DreamRenderer进行定制化和优化,以进一步提升其性能和用户体验。

-

加强与其他技术的融合:探索将DreamRenderer与其他相关技术(如自然语言处理、计算机视觉等)进行融合的可能性,以开发出更加智能和全面的多媒体创作工具。例如,可以尝试将DreamRenderer与语音识别、手势识别等技术相结合,实现更加自然和直观的用户交互方式。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?