目 录

一 Flume汇入数据到Hive

1.汇入到Hive指定的HDFS路径中

2. 利用HiveSink汇入数据

二 Flume 汇入数据到HBase

1.SimpleHbaseEventSerializer

2.SimpleAsyncHbaseEventSerializer

3.RegexHbaseEventSerializer

三 总结

Flume是一个分布式、可靠、和高可用的海量日志采集、聚合和传输的系统,支持在系统中定制各类数据发送方,用于收集数据;同时,Flume提供对数据进行简单处理,并写到各种数据接受方(可定制)的能力。

一 Flume汇入数据到Hive

1.汇入到Hive指定的HDFS路径中

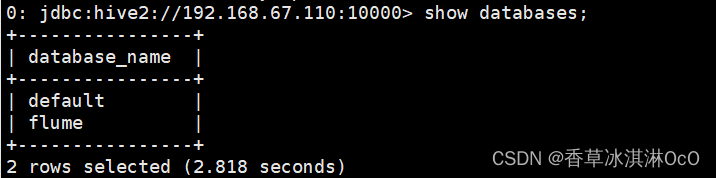

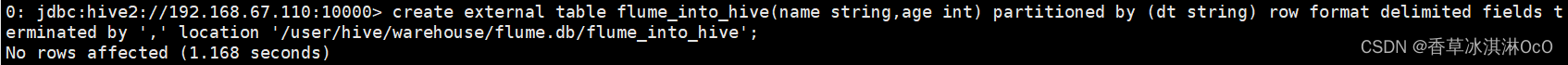

1)在hive中创建数据库和外部表

create database flume;

create external table flume_into_hive(name string,age int) partitioned by (dt string) row format delimited fields terminated by ',' location '/user/hive/warehouse/flume.db/flume_into_hive';

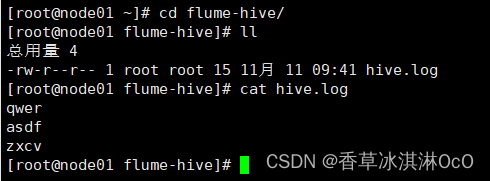

2)在/root中创建hive.log文件

mkdir flume-hive

cd flume-hive/

vi hive.log

3)在flume的conf路径中编写配置文件

cd /opt/software/flume/conf/

vi flume-into-hive-1.conf

agent.sources=r1

agent.channels=c1

agent.sinks=s1

agent.sources.r1.type=exec

agent.sources.r1.command=tail -F /root/flume-hive/hive.log

agent.channels.c1.type=memory

agent.channels.capacity=1000

agent.channels.c1.transactionCapacity=100

agent.sinks.s1.type=hdfs

agent.sinks.s1.hdfs.path = hdfs://node01:90

本文详细介绍了如何使用Flume将数据汇入到Hive和HBase。首先,通过配置Flume将日志数据写入HDFS上的Hive外部表,然后利用HiveSink直接将数据导入Hive。接着,讨论了SimpleHbaseEventSerializer、SimpleAsyncHbaseEventSerializer和RegexHbaseEventSerializer三种不同方式将数据导入HBase。最后,总结了Flume在大数据日志处理中的优点和特性。

本文详细介绍了如何使用Flume将数据汇入到Hive和HBase。首先,通过配置Flume将日志数据写入HDFS上的Hive外部表,然后利用HiveSink直接将数据导入Hive。接着,讨论了SimpleHbaseEventSerializer、SimpleAsyncHbaseEventSerializer和RegexHbaseEventSerializer三种不同方式将数据导入HBase。最后,总结了Flume在大数据日志处理中的优点和特性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?