引起:

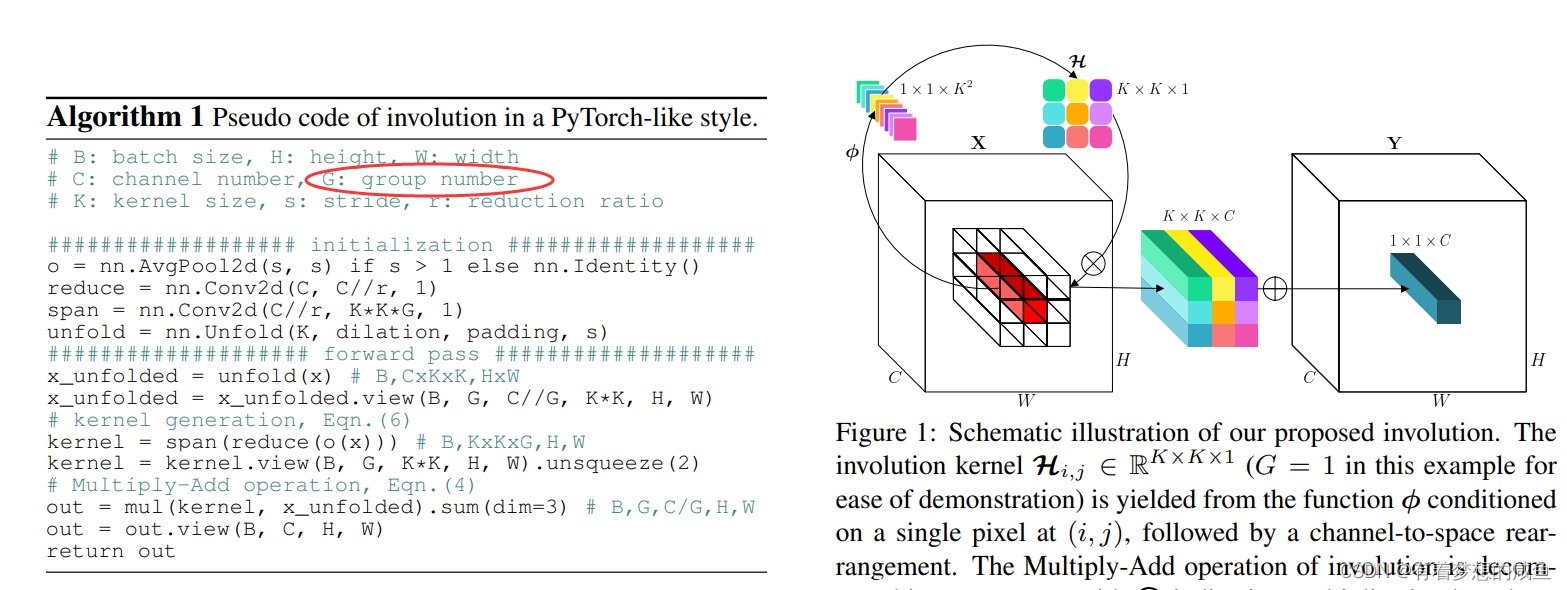

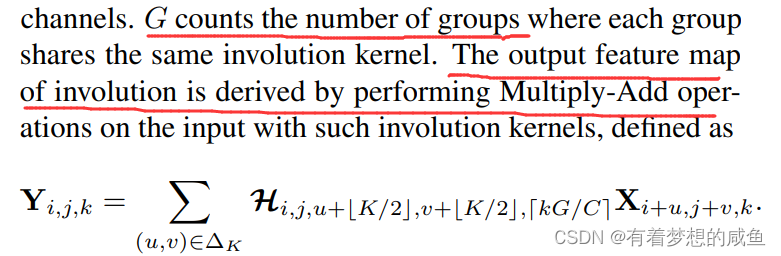

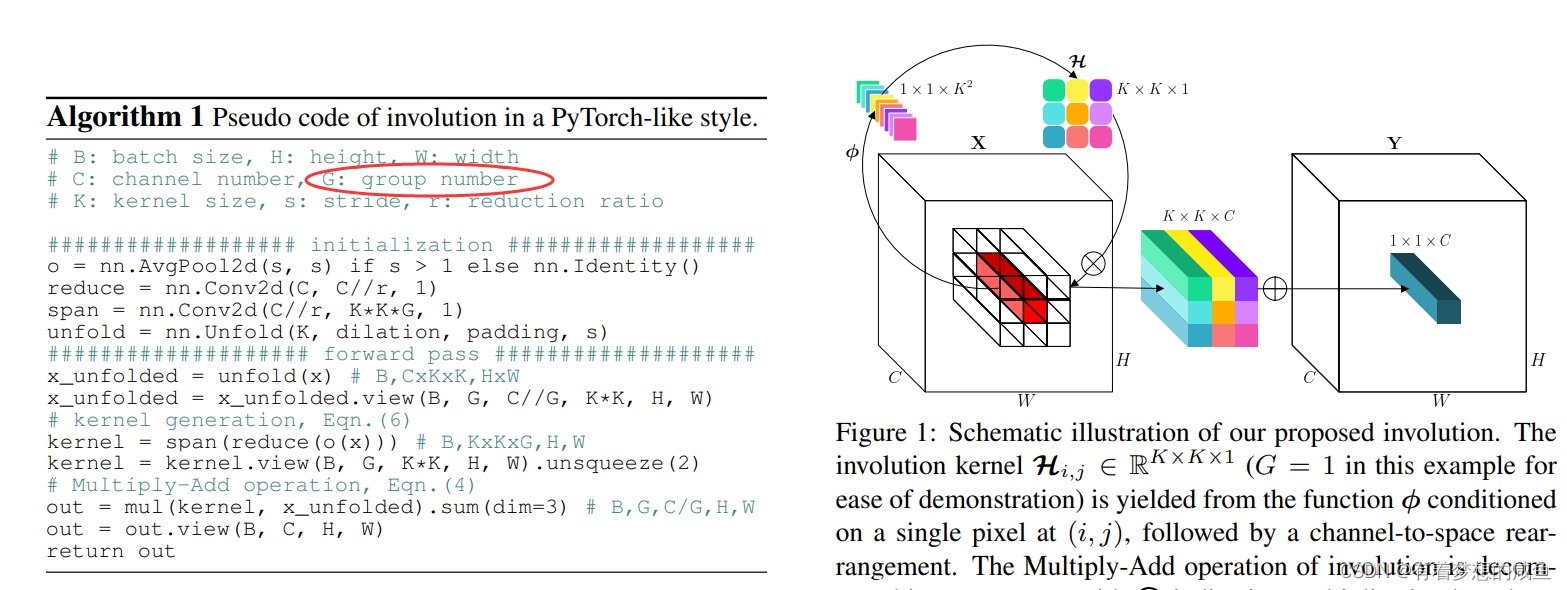

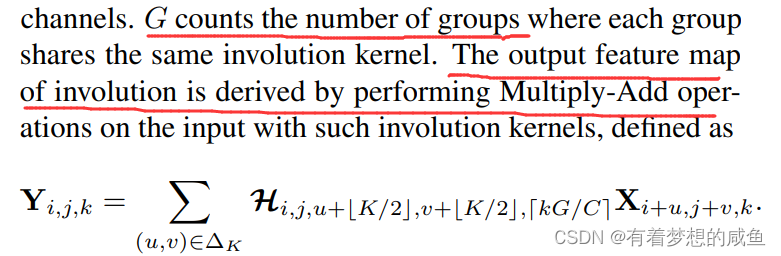

involution:

G-Group这是个啥?

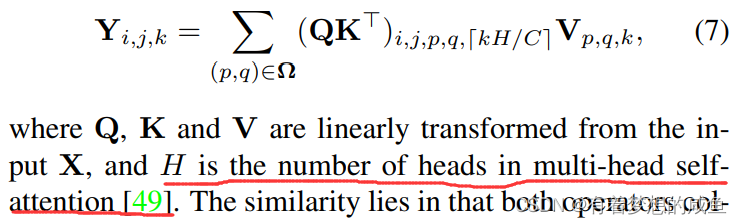

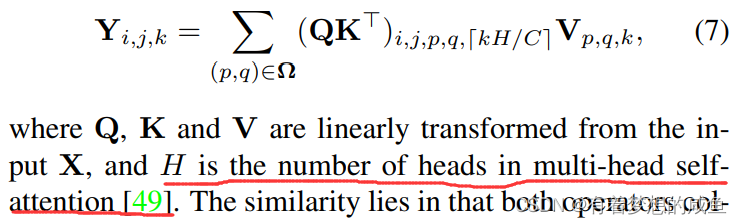

我已经晕了,听师兄说这个H就是Group。。。不说了,先复习self-attention

self-attention:

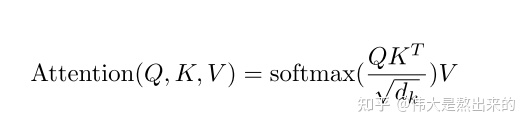

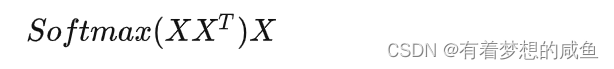

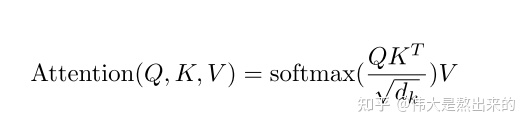

Attention最核心的公式如下:

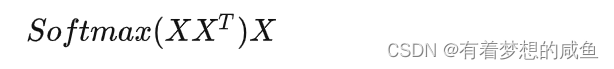

很难理解是吧,看下面的公式:

先抛开Q,K,V不谈,最初的公式是张这样的。

向量的内积代表啥,XXT又代表什么?

向量的内积代表的是两个向量的夹角,表征一个向量在另外一个向量上的投影。

XXT下面有一个实例:自己看吧

involution:

G-Group这是个啥?

我已经晕了,听师兄说这个H就是Group。。。不说了,先复习self-attention

Attention最核心的公式如下:

很难理解是吧,看下面的公式:

先抛开Q,K,V不谈,最初的公式是张这样的。

向量的内积代表啥,XXT又代表什么?

向量的内积代表的是两个向量的夹角,表征一个向量在另外一个向量上的投影。

XXT下面有一个实例:自己看吧

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?