目录

一、什么是决策树

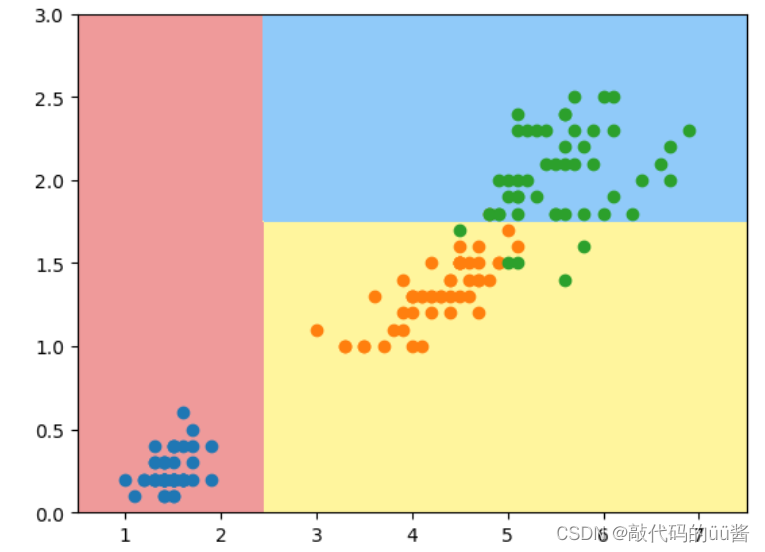

决策树能够通过对数据的逐步分割,构建一棵树形结构来实现预测和判断。在决策树模型中,每个节点表示一个属性或特征,每个分支表示该属性或特征的一个取值,叶子节点表示最终的分类或回归结果。

代码示例:

import numpy as np

import matplotlib.pyplot as plt

from sklearn import datasets

iris = datasets.load_iris()

X = iris.data[:,2:] #选两个特征

y = iris.target

#创建决策树分类器

from sklearn.tree import DecisionTreeClassifier

dt_clf = DecisionTreeClassifier(max_depth=2, criterion="entropy", random_state=42) #max_depth最高深度,自定义划分深度

dt_clf.fit(X, y)

#绘制决策边界

def plot_decision_boundary(model, axis):

x0, x1 = np.meshgrid(

np.linspace(axis[0], axis[1], int((axis[1]-axis[0])*100)).reshape(-1, 1),

np.linspace(axis[2], axis[3], int((axis[3]-axis[2])*100)).reshape(-1, 1),

)

X_new = np.c_[x0.ravel(), x1.ravel()]

y_predict = model.predict(X_new)

zz = y_predict.reshape(x0.shape)

from matplotlib.colors import ListedColormap

custom_cmap = ListedColormap(['#EF9A9A','#FFF59D','#90CAF9'])

plt.contourf(x0, x1, zz, cmap=custom_cmap)

plot_decision_boundary(dt_clf, axis=[0.5, 7.5, 0, 3])

plt.scatter(X[y==0,0], X[y==0,1])

plt.scatter(X[y==1,0], X[y==1,1])

plt.scatter(X[y==2,0], X[y==2,1])

plt.show()运行结果:

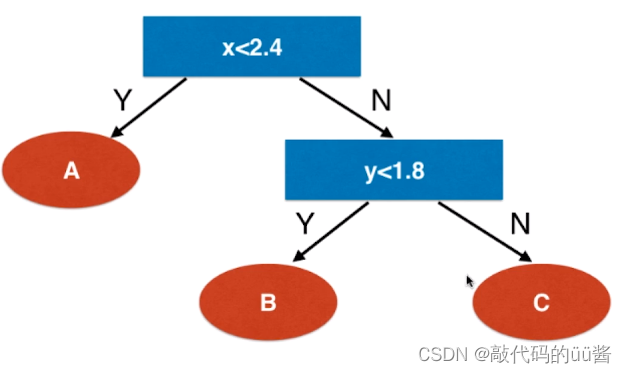

根据以上结果我们可以做出一个决策树,如下所示:

通过以上例子,我们更加直观的了解了决策树,同时它也具备以下几个特点:

- 非参数学习

- 可以解决分类问题

- 可以解决多分类问题

- 可以解决回归问题

- 具有好的可解释性

二、信息熵

1、什么是信息熵

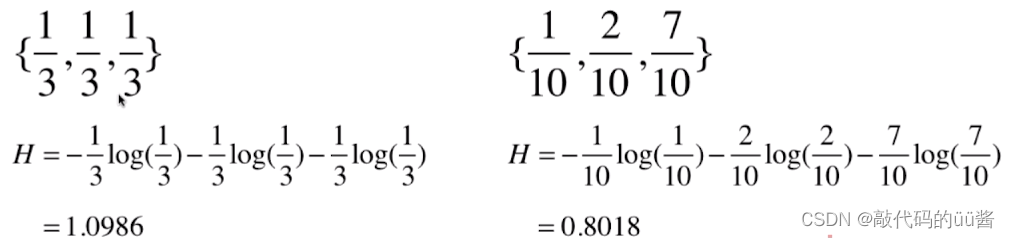

熵在信息论中代表随机变量不确定度的度量。熵越大,数据的不确定性越高;熵越小,数据的不确定性越低。信息熵的计算公式为:

对于一个系统中,有k类信息,每一类信息所占比例为 。由于

是一个小于1的数,

是一个小于0的数,因此加一个负号使它成为大于0的数。举例如下:

上面两组数据结果可以看出,左边的数据所占比列比右边大,且左边的数据结果比右边数据结果大,意味着右边的数据更加稳定。

代码示例:

#定义信息熵公公式

def entropy(p):

return -p * np.log(p) - (1-p) * np.log(1-p)

#生成向量

x = np.linspace(0.01, 0.99, 200) #取200个0.01—0.99的数值

plt.plot(x, entropy(x))

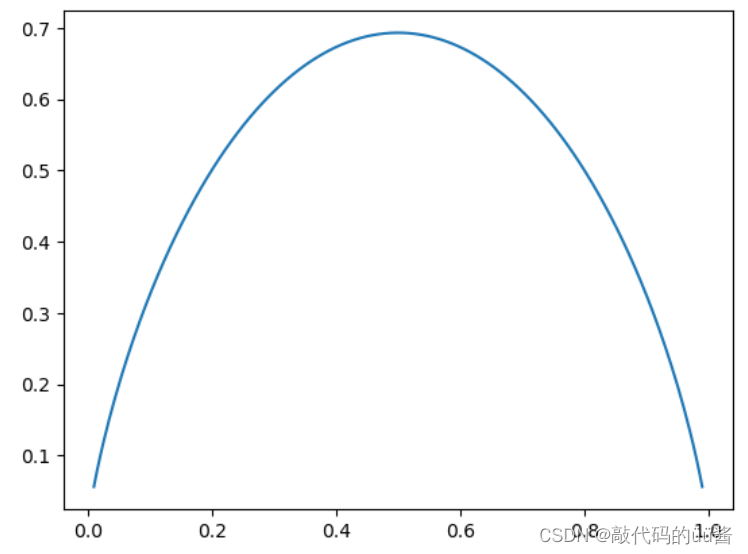

plt.show()运行结果:

根据结果我们可以看出,当x=0.5时,信息熵取得最大值。即当一个类别为 ,另外一个类别为

,那么信息熵就可以取得最大值,此时数据确定性最低。

2、信息熵的最优化分

信息熵划分就是对每个节点的某个维度进行划分,并且在该维度上对某个值进行划分。最优化法可以是信息熵降低,进而数据更稳定。

代码示例:

#数据进行划分

def split(X, y, d, value): #d为维度,value为该维度的值

index_a = (X[:,d] <= value)

index_b = (X[:,d] > value)

return X[index_a], X[index_b], y[index_a], y[index_b]

from collections import Counter

from math import log

#计算熵

def entropy(y):

counter = Counter(y)

res = 0.0

for num in counter.values():

p = num / len(y)

res += -p * log(p)

return res

#在所有数据上寻找维度和值

def try_split(X, y):

best_entropy = float('inf')

best_d, best_v = -1, -1

for d in range(X.shape[1]): #X.shape[0]为行,X.shape[1]为列——维度

sorted_index = np.argsort(X[:,d])

for i in range(1, len(X)):

if X[sorted_index[i], d] != X[sorted_index[i-1], d]:

v = (X[sorted_index[i], d] + X[sorted_index[i-1], d])/2

X_l, X_r, y_l, y_r = split(X, y, d, v)

p_l, p_r = len(X_l) / len(X), len(X_r) / len(X)

e = p_l * entropy(y_l) + p_r * entropy(y_r)

if e < best_entropy:

best_entropy, best_d, best_v = e, d, v

return best_entropy, best_d, best_v

best_entropy, best_d, best_v = try_split(X, y)

print("best_entropy =", best_entropy)

print("best_d =", best_d)

print("best_v =", best_v)

运行结果:

代码示例:

X1_l, X1_r, y1_l, y1_r = split(X, y, best_d, best_v)

entropy(y1_l) #结果降为0

#0.0

entropy(y1_r)

#0.6931471805599453

best_entropy2, best_d2, best_v2 = try_split(X1_r, y1_r) #传入右边的数据

X2_l, X2_r, y2_l, y2_r = split(X1_r, y1_r, best_d2, best_v2)

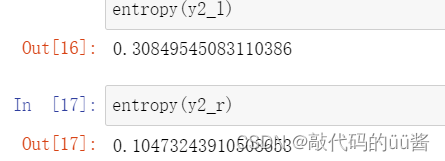

entropy(y2_l)

entropy(y2_r)

运行结果:

由此看出,经过第二次划分,两个子树上的信息熵都没有降为0,因此还可以向更深的方向继续划分。

1209

1209

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?