基于【动手学深度学习】课程,理解并复现softmax回归代码

一、softmax回归简介

Softmax 回归(也称为多项式逻辑回归或最大熵分类器)是一种用于多分类问题的线性模型。它主要用于将输入数据映射到多个离散类别中的一个。Softmax 回归是逻辑回归(Logistic Regression)的扩展,适用于多分类任务,而不是二分类任务。

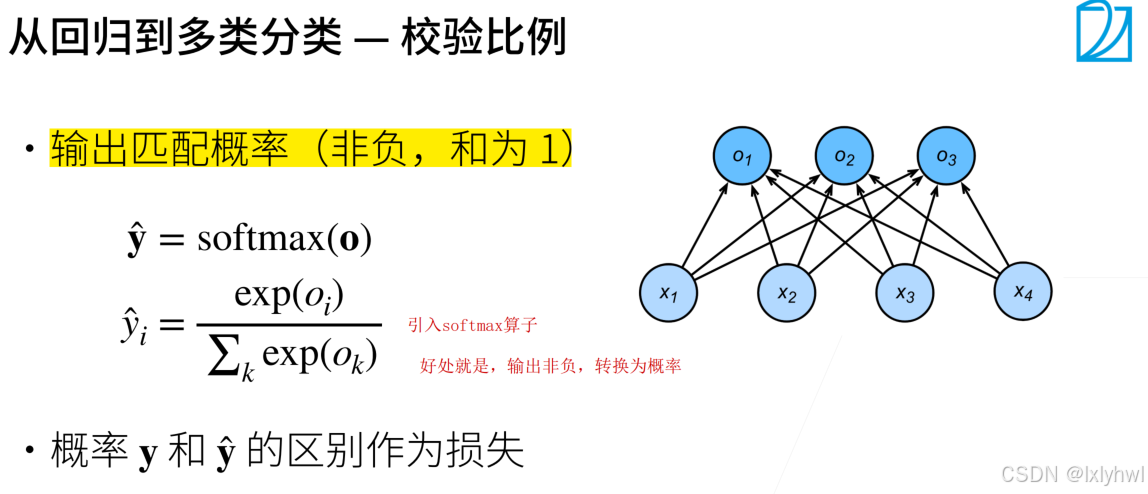

- 用沐神两页ppt阐述softmax回归里的核心概念

二、softmax回归实例

- 直接上代码

(0)数据筛选:直接采用“torchvision.datasets.FashionMNIST”数据集

(1)构建模型:y=softmax(X*w+b)

(2)构建损失函数:

l

(

y

,

y

^

)

=

−

∑

i

y

i

log

y

^

i

=

−

log

y

^

y

l(\mathbf{y},\mathbf{\hat{y}})=-\sum_iy_i\log\hat{y}_i=-\log\hat{y}_y

l(y,y^)=−∑iyilogy^i=−logy^y,即交叉熵

(3)设置超参数:batch_size、lr、num_epochs

(4) 迭代优化:SGD

import torch

import torchvision

from torch.utils import data

from torchvision import transforms

from d2l import torch as d2l

from IPython.display import display,clear_output

def get_dataloader_workers():

"""使用4个进程来读取数据。"""

return 0

batch_size = 256

num_workers = 0

# 训练集和测试集的迭代器

train_iter, test_iter = d2l.load_data_fashion_mnist(num_workers, batch_size)

# 图像为28*28个像素点,但softmax的输入必须为向量,所以将输入转为1维向量,输出为10个类别

num_inputs = 784

num_outputs = 10

W = torch.normal(0, 0.01, size=(num_inputs, num_outputs), requires_grad=True)

b = torch.zeros(num_outputs, requires_grad=True)

# =============================================================================

# X = torch.tensor([[1.0, 2.0, 3.0], [4.0, 5.0, 6.0]])

# print(X.sum(0, keepdim=True))

# print(X.sum(1, keepdim=True))

# =============================================================================

def softmax(X):

X_exp = torch.exp(X)

partition = X_exp.sum(1, keepdim=True)

return X_exp / partition

# =============================================================================

# X = torch.normal(0, 1, (2, 5))

# X_prob = softmax(X)

# print(X,X_prob, X_prob.sum(1))

# =============================================================================

# 实现softmax回归模型

def net(X):

'''softmax(X*w+b)'''

return softmax(torch.matmul(X.reshape((-1, W.shape[0])), W) + b)

# 创建一个数据y_hat,其中包含2个样本在3个类别的预测概率, 使用y作为y_hat中概率的索引

y = torch.tensor([0, 2])

y_hat = torch.tensor([[0.1, 0.3, 0.6], [0.3, 0.2, 0.5]])

print(y_hat[[0, 1], y])

# 实现交叉熵损失函数

def cross_entropy(y_hat, y):

return -torch.log(y_hat[range(len(y_hat)), y])

cross_entropy(y_hat, y)

def accuracy(y_hat, y):

"""计算预测正确的数量。"""

if len(y_hat.shape) > 1 and y_hat.shape[1] > 1:

y_hat = y_hat.argmax(axis=1)

cmp = y_hat.type(y.dtype) == y

return float(cmp.type(y.dtype).sum())

print(accuracy(y_hat, y) / len(y))

def evaluate_accuracy(net, data_iter):

"""计算在指定数据集上模型的精度。"""

if isinstance(net, torch.nn.Module):

net.eval() # 将模型设置为评估模式

metric = Accumulator(2) # 正确预测数、预测总数

for X, y in data_iter:

metric.add(accuracy(net(X), y), y.numel())

return metric[0] / metric[1]

class Accumulator:

"""在`n`个变量上累加。"""

def __init__(self, n):

self.data = [0.0] * n

def add(self, *args):

self.data = [a + float(b) for a, b in zip(self.data, args)]

def reset(self):

self.data = [0.0] * len(self.data)

def __getitem__(self, idx):

return self.data[idx]

print(evaluate_accuracy(net, test_iter))

def train_epoch_ch3(net, train_iter, loss, updater):

"""训练模型一个迭代周期(定义见第3章)。"""

if isinstance(net, torch.nn.Module):

net.train()

metric = Accumulator(3)

for X, y in train_iter:

y_hat = net(X)

l = loss(y_hat, y)

if isinstance(updater, torch.optim.Optimizer):

updater.zero_grad()

l.backward()

updater.step()

metric.add(

float(l) * len(y), accuracy(y_hat, y),

y.size().numel())

else:

l.sum().backward()

updater(X.shape[0])

metric.add(float(l.sum()), accuracy(y_hat, y), y.numel())

return metric[0] / metric[2], metric[1] / metric[2]

class Animator:

"""在动画中绘制数据。"""

def __init__(self, xlabel=None, ylabel=None, legend=None, xlim=None,

ylim=None, xscale='linear', yscale='linear',

fmts=('-', 'm--', 'g-.', 'r:'), nrows=1, ncols=1,

figsize=(3.5, 2.5)):

if legend is None:

legend = []

d2l.use_svg_display()

self.fig, self.axes = d2l.plt.subplots(nrows, ncols, figsize=figsize)

if nrows * ncols == 1:

self.axes = [self.axes,]

self.config_axes = lambda: d2l.set_axes(self.axes[

0], xlabel, ylabel, xlim, ylim, xscale, yscale, legend)

self.X, self.Y, self.fmts = None, None, fmts

def add(self, x, y):

if not hasattr(y, "__len__"):

y = [y]

n = len(y)

if not hasattr(x, "__len__"):

x = [x] * n

if not self.X:

self.X = [[] for _ in range(n)]

if not self.Y:

self.Y = [[] for _ in range(n)]

for i, (a, b) in enumerate(zip(x, y)):

if a is not None and b is not None:

self.X[i].append(a)

self.Y[i].append(b)

self.axes[0].cla()

for x, y, fmt in zip(self.X, self.Y, self.fmts):

self.axes[0].plot(x, y, fmt)

self.config_axes()

# display.display(self.fig)

# display.clear_output(wait=True)

def train_ch3(net, train_iter, test_iter, loss, num_epochs, updater):

"""训练模型(定义见第3章)。"""

animator = Animator(xlabel='epoch', xlim=[1, num_epochs], ylim=[0.3, 0.9],

legend=['train loss', 'train acc', 'test acc'])

for epoch in range(num_epochs):

train_metrics = train_epoch_ch3(net, train_iter, loss, updater)

test_acc = evaluate_accuracy(net, test_iter)

animator.add(epoch + 1, train_metrics + (test_acc,))

train_loss, train_acc = train_metrics

assert train_loss < 0.5, train_loss

assert train_acc <= 1 and train_acc > 0.7, train_acc

assert test_acc <= 1 and test_acc > 0.7, test_acc

lr = 0.1

def updater(batch_size):

return d2l.sgd([W, b], lr, batch_size)

num_epochs = 10

train_ch3(net, train_iter, test_iter, cross_entropy, num_epochs, updater)

def predict_ch3(net, test_iter, n=6):

"""预测标签(定义见第3章)。"""

for X, y in test_iter:

break

trues = d2l.get_fashion_mnist_labels(y)

preds = d2l.get_fashion_mnist_labels(net(X).argmax(axis=1))

titles = [true + '\n' + pred for true, pred in zip(trues, preds)]

d2l.show_images(X[0:n].reshape((n, 28, 28)), 1, n, titles=titles[0:n])

predict_ch3(net, test_iter)

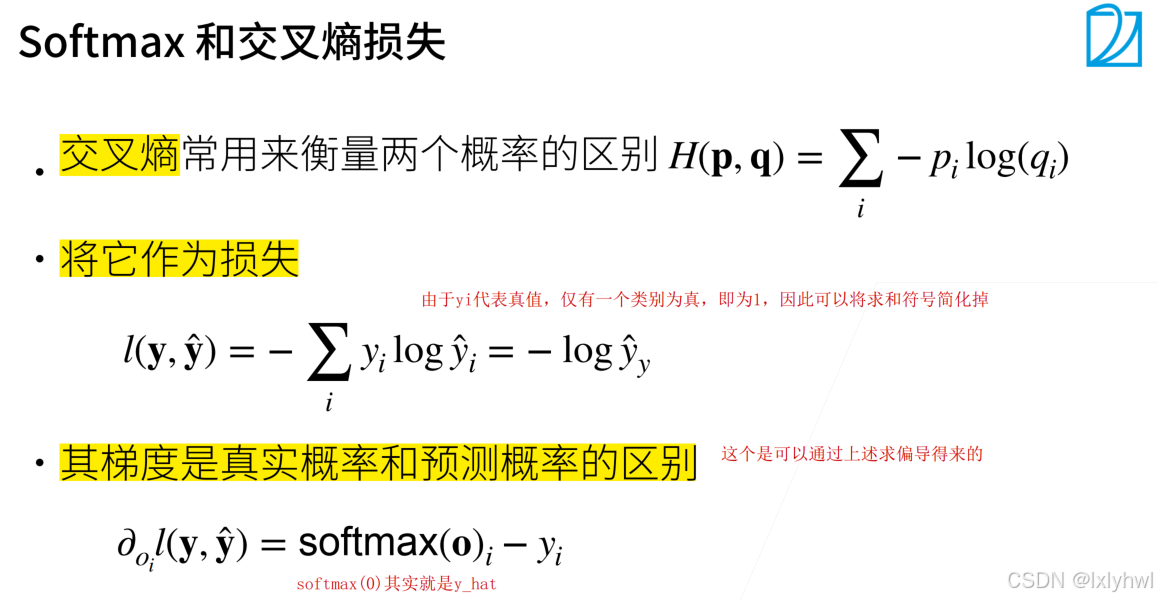

- 准确率和损失函数值的统计结果

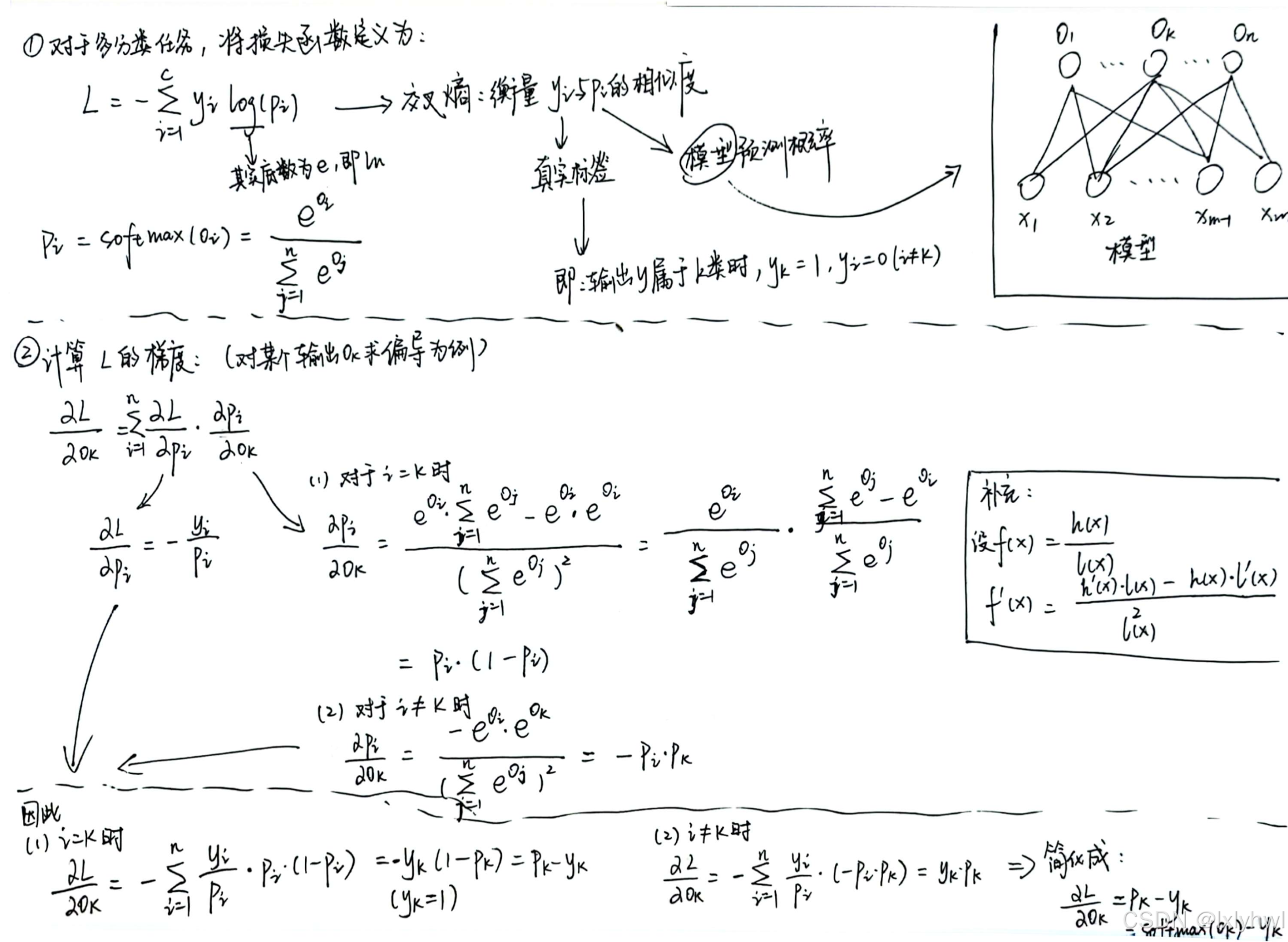

二、多类交叉熵损失函数的梯度计算

交叉熵通常用于衡量两个概率之间的区别。

在多类分类的问题当中,输出为softmax(zi)的概率,可以用于衡量预测值概率与真值概率的区别,从而定义为损失函数进行不断优化。

具体推导过程如下:

887

887

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?