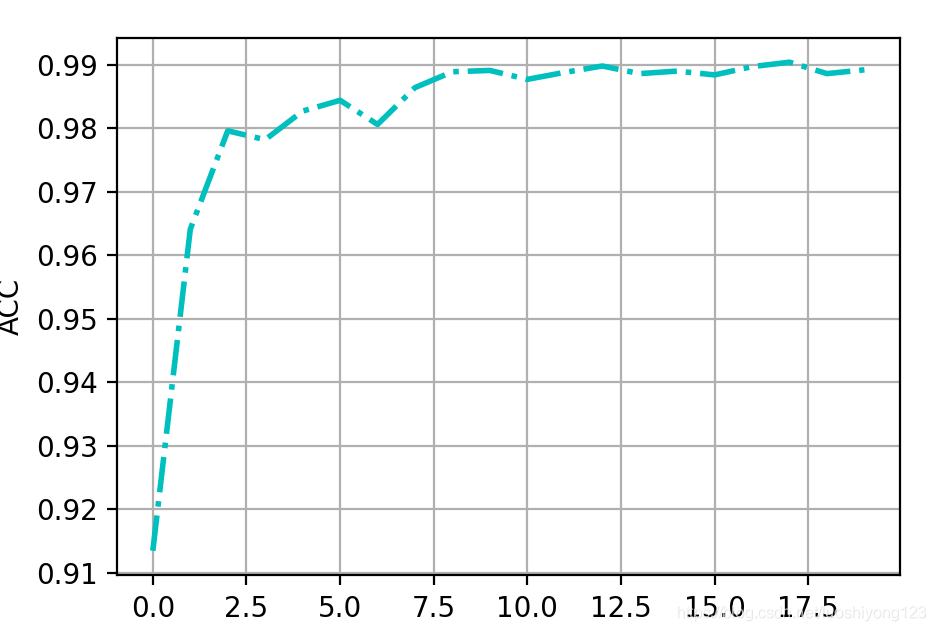

本文旨在探索各种不同的改变对于训练精确率的影响

1.增加全连接层

原来的全连接层由320->10:

self.f1 = torch.nn.Linear(320,10)现在改为:每一个线性单元采用relu激活函数

self.f1 = torch.nn.Linear(320,160)

self.f2 = torch.nn.Linear(160,80)

self.f3 = torch.nn.Linear(80,40)

self.f4 = torch.nn.Linear(40,10)结果:训练20次可达到99%

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?