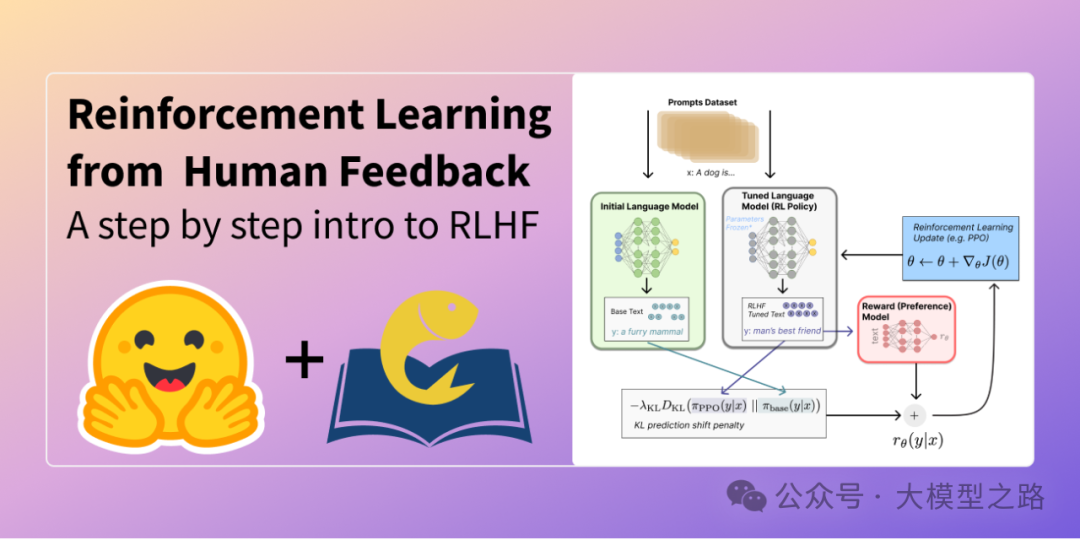

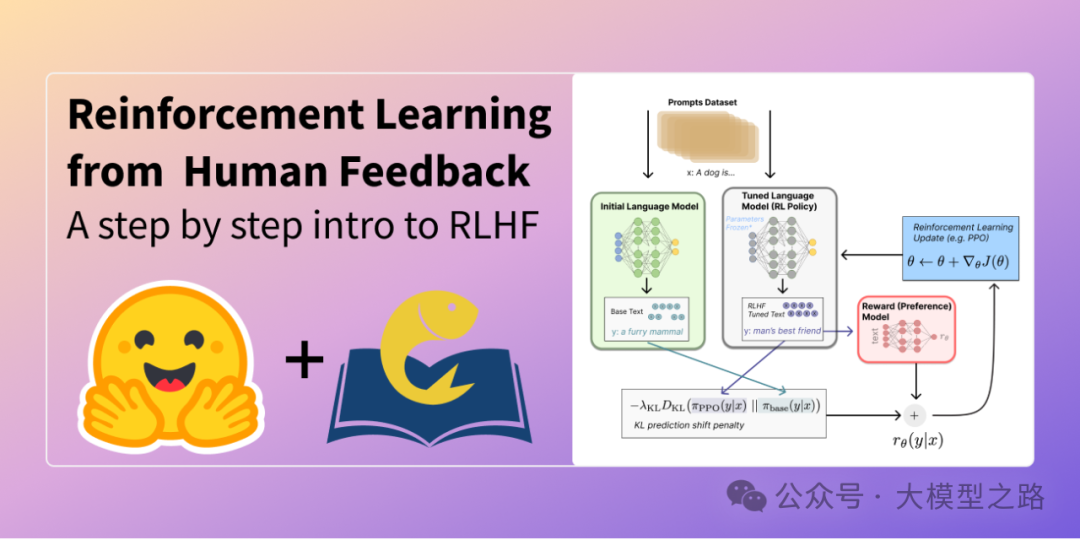

在人工智能(AI)日新月异的今天,我们见证了AI从简单的计算工具逐渐发展成为能够理解复杂指令、生成创造性内容的智能体(Multi-Agent架构:探索AI协作的新纪元)。然而,随着AI的广泛应用,一个关键问题逐渐浮出水面:AI的输出能否真正体现人类的价值观,其行为能否与人类的期望保持一致?强化学习(OpenAI o1背后的技术:强化学习)从人类反馈(RLHF)作为一种有前途的方法,为使 AI 系统更贴近人类价值提供了可能。今天我们一起了解一下 RLHF。

在人工智能(AI)日新月异的今天,我们见证了AI从简单的计算工具逐渐发展成为能够理解复杂指令、生成创造性内容的智能体(Multi-Agent架构:探索AI协作的新纪元)。然而,随着AI的广泛应用,一个关键问题逐渐浮出水面:AI的输出能否真正体现人类的价值观,其行为能否与人类的期望保持一致?强化学习(OpenAI o1背后的技术:强化学习)从人类反馈(RLHF)作为一种有前途的方法,为使 AI 系统更贴近人类价值提供了可能。今天我们一起了解一下 RLHF。

638

638

572

572

2024

2024

5194

5194

291

291

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?