hadoop运行自带wordcount卡住:INFO mapreduce.Job:job_1585916162475_0005

##本人hadoop小白,在搭建好hadoop集群后运行hadoop自带wordount程序

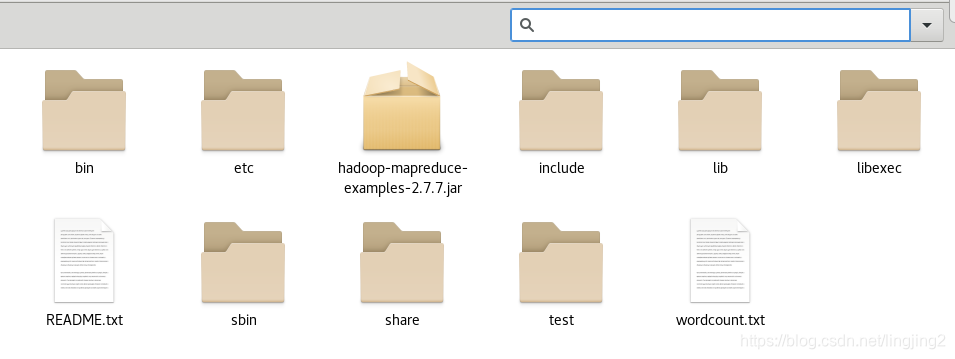

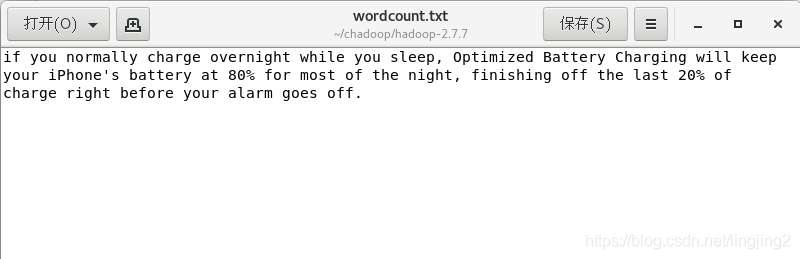

在hadoop文件夹中创建wordcount.txt文件,内容不限,一些简单的英文即可

在hadoop文件夹中创建wordcount.txt文件,内容不限,一些简单的英文即可

1.启动hadoop

1.启动hadoop

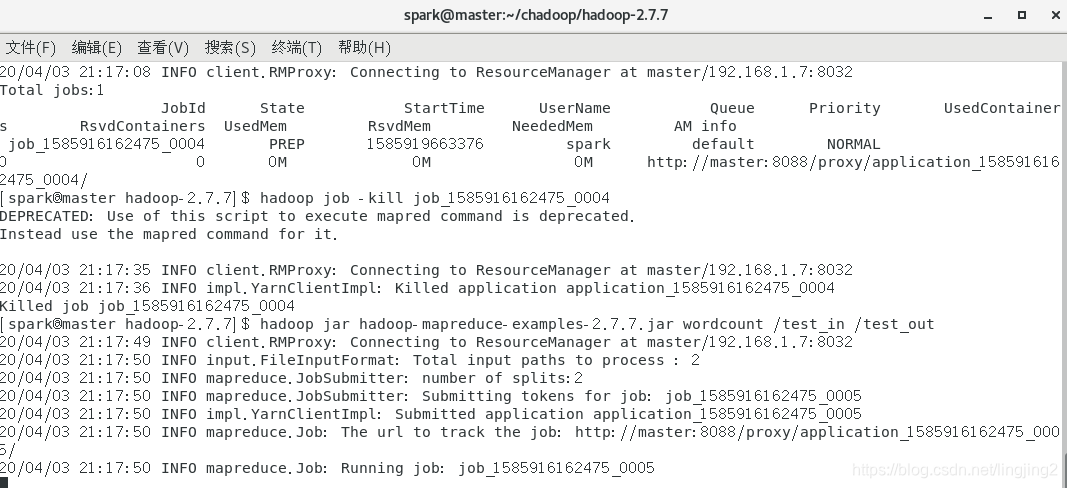

2.进入hadoop目录,运行下面指令

$hadoop fs -mkdir /input

$hadoop fs -ls /input

$hadoop jar hadoop-mapreduce-examples-2.7.7.jar wordcount /input /output

3.发生卡住问题

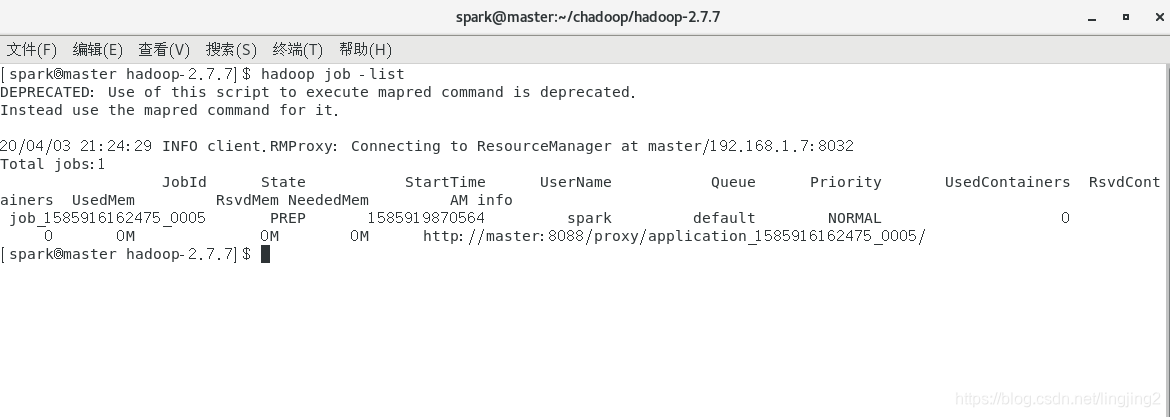

4.查看hadoop job列表

4.查看hadoop job列表

$hadoop job -list

程序没有运行

5.浏览器打开 master:8088(master是我的主机名,8088是端口)

在搭建好的Hadoop集群上运行WordCount程序时遇到卡住问题,错误信息显示为INFO mapreduce.Job:job_1585916162475_0005。通过检查发现所有节点的tmp文件夹存在问题,通过修改core-site.xml配置文件,指定新的tmp路径后,问题得到解决,所有节点恢复正常运行。

在搭建好的Hadoop集群上运行WordCount程序时遇到卡住问题,错误信息显示为INFO mapreduce.Job:job_1585916162475_0005。通过检查发现所有节点的tmp文件夹存在问题,通过修改core-site.xml配置文件,指定新的tmp路径后,问题得到解决,所有节点恢复正常运行。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3873

3873

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?