然后我们再来看这个在本地搭建一个大模型,这里搭建chatglm3-6b模型

cpp (c++ c plus plus)

- 纯 C/C++ 实现,无需外部依赖。

- 针对使用 ARM NEON、Accelerate 和 Metal 框架的 Apple 芯片进行了优化。

- 支持适用于 x86 架构的 AVX、AVX2 和 AVX512。

- 提供 F16/F32 混合精度,并支持 2 位至 8 位整数量化。

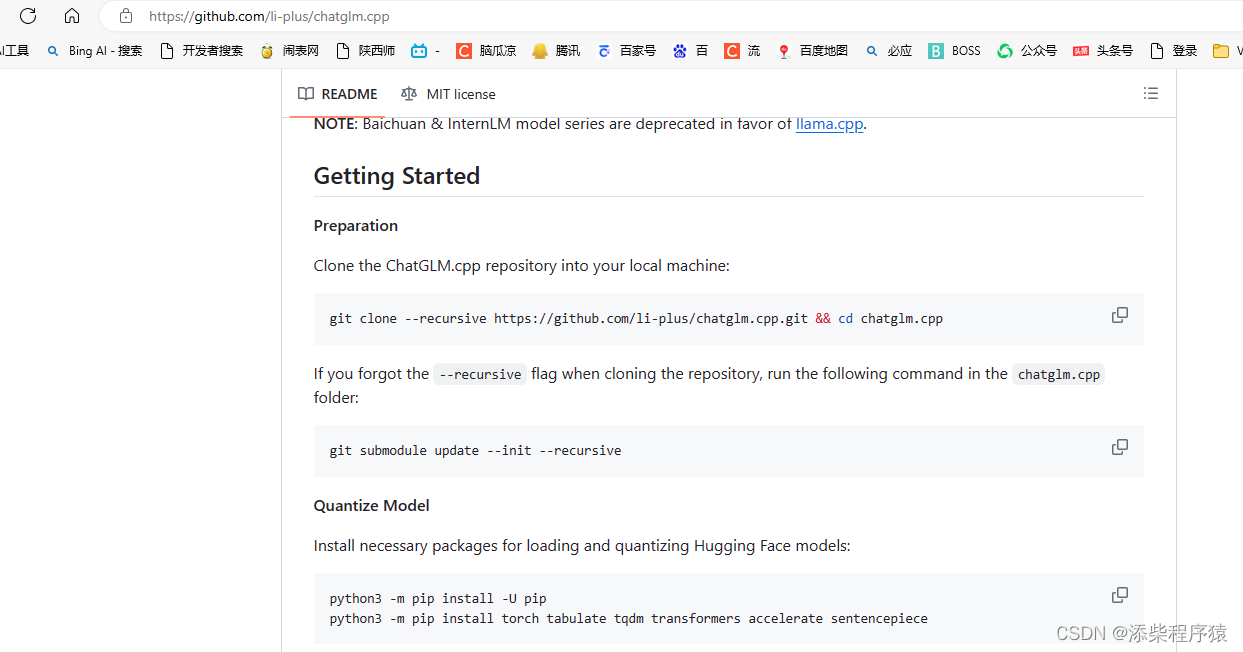

https://github.com/li-plus/chatglm.cpp参考这个网址进行搭建.

这里面有描述如何搭建的过程.

部署 chatglm3

git clone --recursive https://github.com/li-plus/chatglm.cpp.git && cd chatglm.cpp

git submodule update --init --recursive

这篇博客介绍了如何在本地使用C++搭建和部署ChatGLM3大模型,包括量化模型、转换为GGML格式以及通过CMake配置和构建项目。同时,还探讨了Ollama框架,它支持多种热门AI模型的快速部署,可以在Linux环境下运行,提供命令行服务和web界面对接模型。

这篇博客介绍了如何在本地使用C++搭建和部署ChatGLM3大模型,包括量化模型、转换为GGML格式以及通过CMake配置和构建项目。同时,还探讨了Ollama框架,它支持多种热门AI模型的快速部署,可以在Linux环境下运行,提供命令行服务和web界面对接模型。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?