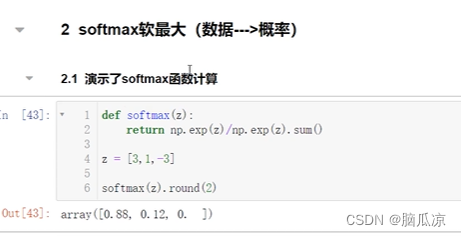

首先我们把softmax的函数写出来

这张图片中的文档内容如下:

def softmax(z):

return np.exp(z)/np.exp(z).sum()

z=[3,1,-3]

softmax(2).round(2)

这个就是按照softmax的公式去写的这个函数对吧

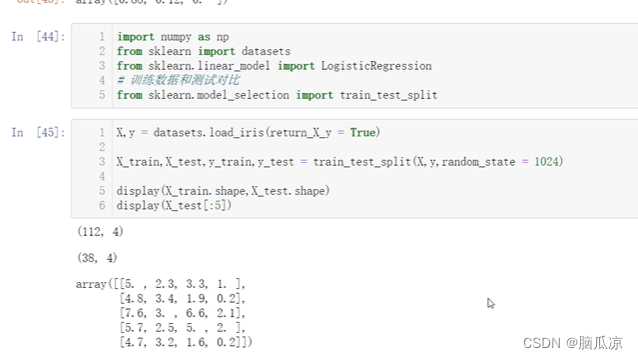

然后我们首先使用LogisticRegression来计算一下,来使用softmax进行一下多分类问题的计算

首先去准备数据

import numpy as np 导入数学计算包

from sklearn import datasets 导入数据

from sklearn.linear_model import LogisticRegression# 训练数据和测试对比

from sklearn.model_selection import train_test_split 导入数据拆分工具

本文介绍了如何手动计算softmax函数以及使用逻辑回归解决多分类问题。通过Python代码展示了softmax的实现,解释了为何在softmax计算中分母应该是每行的总和,并修复了相应错误,最终比较了手动计算与模型预测的概率一致性。

本文介绍了如何手动计算softmax函数以及使用逻辑回归解决多分类问题。通过Python代码展示了softmax的实现,解释了为何在softmax计算中分母应该是每行的总和,并修复了相应错误,最终比较了手动计算与模型预测的概率一致性。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?