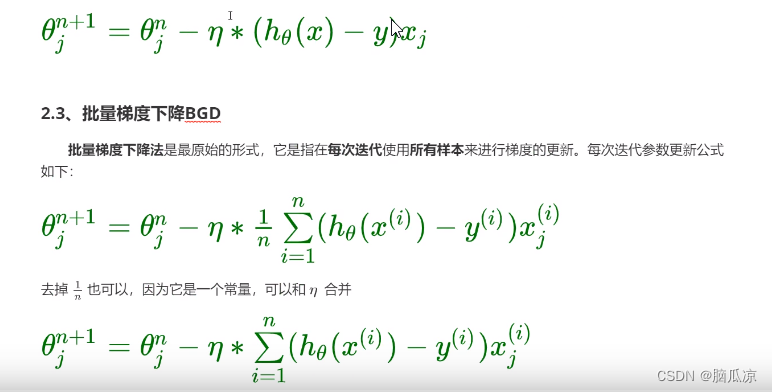

然后我们先来看BGD批量梯度下降,可以看到这里,其实这个公式来源于

梯度下降的公式对吧,其实就是对原始梯度下降公式求偏导以后的梯度下降公式,然后

使用所有样本进行梯度下降得来的,可以看到* 1/n 其实就是求了一个平均数对吧.所有样本的平均数.

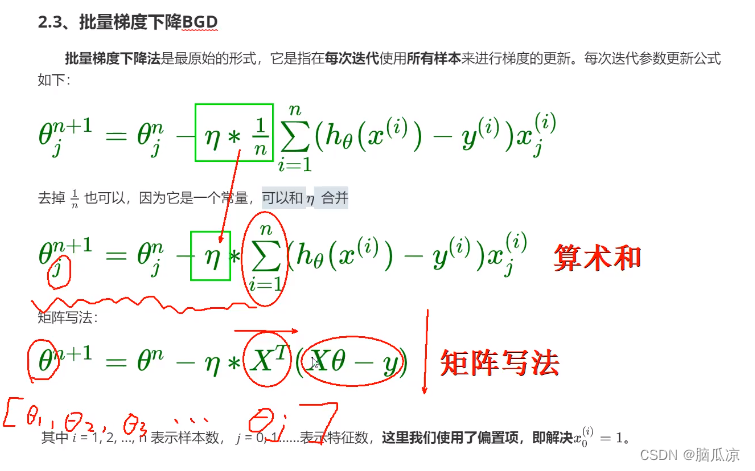

然后我们看,我们这里* 1/n那么前面还有一个eta ,对吧,那么这个1/n是个常量对吧,我们下面

就和eta进行了合并,可以看到,这里的eta * 1/n进行合并以后,就只剩一个eta了,然后

我们再去看,因为是连加的,可以看到有个算术和Ei =1 到n对吧,然后

换成矩阵的写法就简洁多了,可以看到是seta n+1 = seta n - ..

然后这里的seta要注意值得是seta1,seta2...setaj对吧,然后

后面的XT转置,其实就是上面xi -yi 和xi的相乘的,矩阵写法,具体这块,要想详细了解,必须要去

学习矩阵了 那块的数学知识了,我们先知道公式,知道结果就可以了,后面有时间再去学吧,要学的东西太多了.

本文介绍了批量梯度下降(BGD)、随机梯度下降(SGD)和小批量梯度下降(MBGD)的公式推导及优缺点。BGD利用所有样本进行梯度下降,适合并行计算,但训练慢;SGD计算快,可能得到局部最优解;MBGD在准确度和速度上找到平衡。

本文介绍了批量梯度下降(BGD)、随机梯度下降(SGD)和小批量梯度下降(MBGD)的公式推导及优缺点。BGD利用所有样本进行梯度下降,适合并行计算,但训练慢;SGD计算快,可能得到局部最优解;MBGD在准确度和速度上找到平衡。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?