我们会先来说预训练有什么用,其实

之前说的机器学习,其实都是跟数学相关性很大的,比如,支持向量机,回归算法,

1.最早的时候,做机器学习,就是偏数学的,比如用的决策树,支持向量机,线性回归,逻辑回归等算法.

这种是偏向数学的,偏向统计的.

然后这个深度学习,其实就是偏大数据的,需要大量的数据来训练,需要大数据支持.

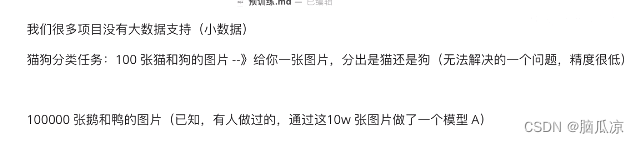

但是呢实际上,很多的项目是没有大数据的支持的,比如,我们有个猫狗分类问题,

我给你100张图片,让你去训练,然后再给你一张

我们会先来说预训练有什么用,其实

之前说的机器学习,其实都是跟数学相关性很大的,比如,支持向量机,回归算法,

1.最早的时候,做机器学习,就是偏数学的,比如用的决策树,支持向量机,线性回归,逻辑回归等算法.

这种是偏向数学的,偏向统计的.

然后这个深度学习,其实就是偏大数据的,需要大量的数据来训练,需要大数据支持.

但是呢实际上,很多的项目是没有大数据的支持的,比如,我们有个猫狗分类问题,

我给你100张图片,让你去训练,然后再给你一张

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?