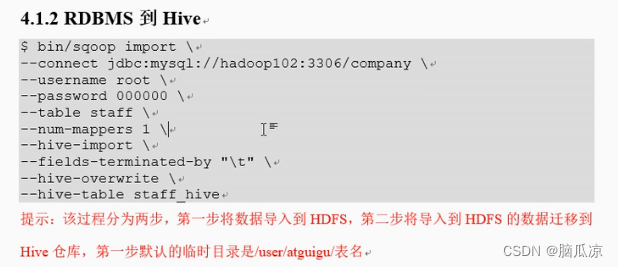

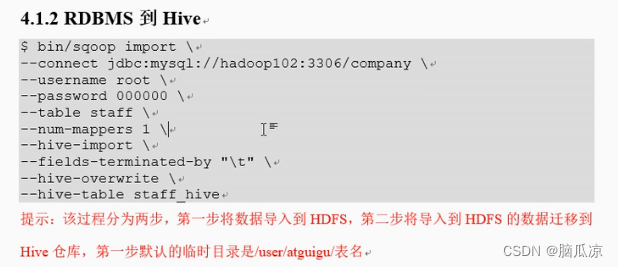

然后来看一下把数据导入到hive中去

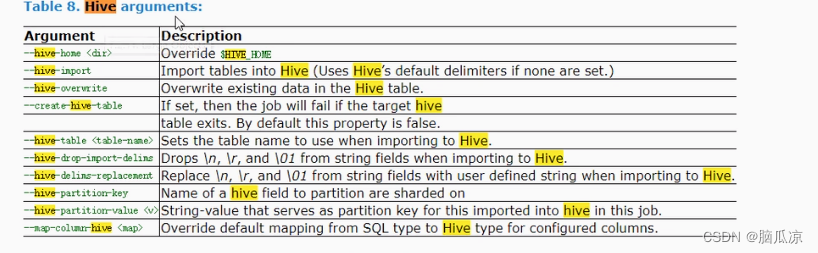

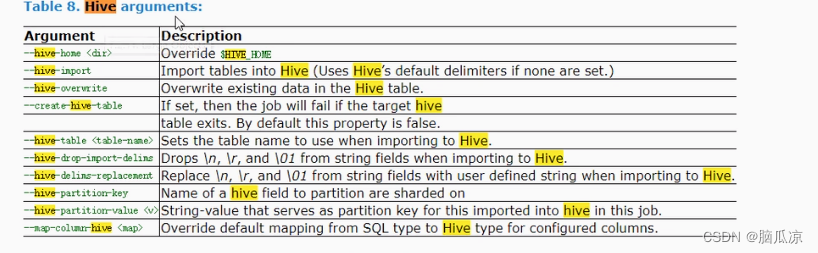

可以去官网去看看文档,有什么参数

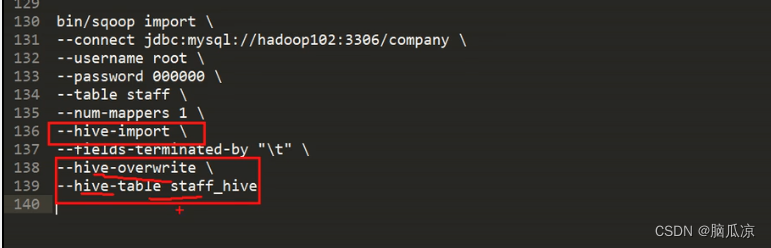

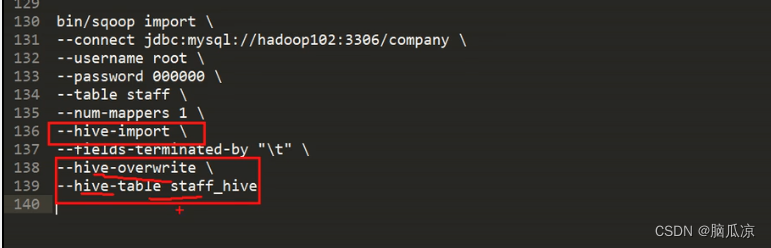

这里用的是hive-import对吧,然后

这里hive-overwrite是覆盖

这个hive-table staff_hive 是创建 一个hive的表是 staff_hive

然后我们先去启动一下hive

然后来看一下把数据导入到hive中去

可以去官网去看看文档,有什么参数

这里用的是hive-import对吧,然后

这里hive-overwrite是覆盖

这个hive-table staff_hive 是创建 一个hive的表是 staff_hive

然后我们先去启动一下hive

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?