然后我们开始来实现我们的案例。

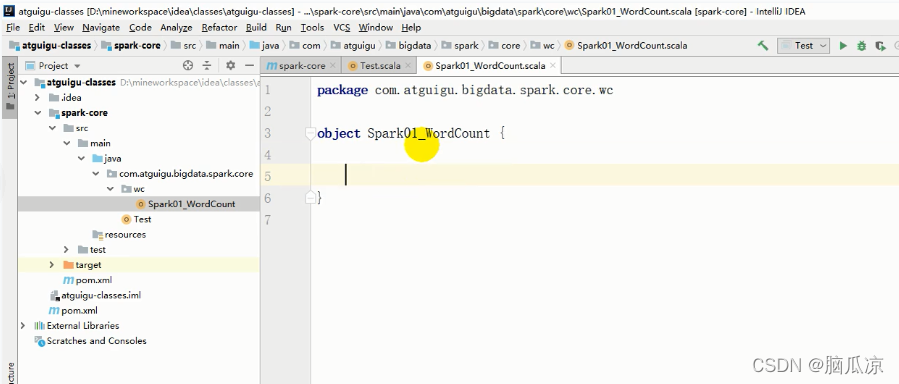

首先我们来去创建一个包wc

然后我们去创建一个object 起名字spark01_wordCount

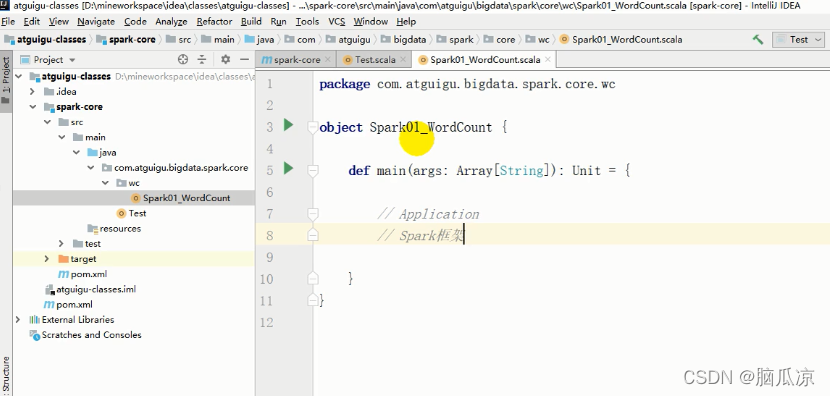

然后我们在里面写上一个main方法。

然后首先我们来理理解一下。我们写的程序实际上是一个application,然后spark其实是一个框架,一个运行环境。就像我们的msyql一样,我们先写好mysql语句发送给mysql服务器。

然后mysql服务器就会去给我们执行。

Spark也是这样,我们先写好应用程序,然后把应用程序发送给spark框架运行环境,让他来帮我们运行

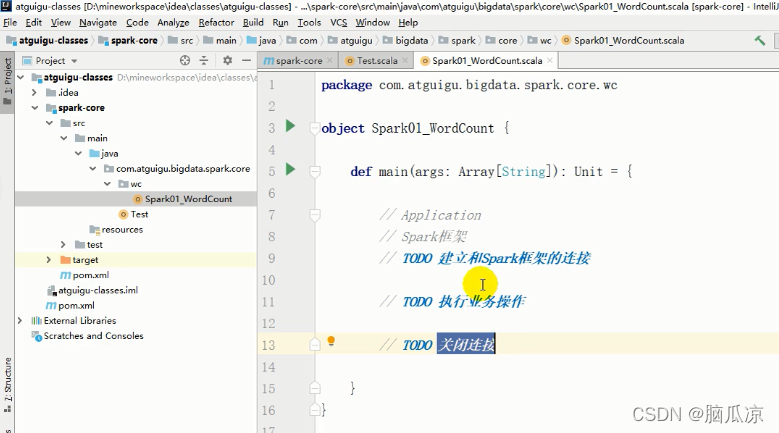

可以看到这个过程包括建立和spark框架的连接,

执行业务操作,

关闭连接。

这篇博客介绍了如何使用Spark框架实现Word Count案例。首先创建包wc和名为spark01_wordCount的object,接着通过编写main方法理解Spark作为应用程序运行环境的角色。详细步骤包括建立SparkContext,添加spark-core依赖,配置本地环境,设置应用名称,最终成功搭建Spark开发环境。

这篇博客介绍了如何使用Spark框架实现Word Count案例。首先创建包wc和名为spark01_wordCount的object,接着通过编写main方法理解Spark作为应用程序运行环境的角色。详细步骤包括建立SparkContext,添加spark-core依赖,配置本地环境,设置应用名称,最终成功搭建Spark开发环境。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?