然后我们再去看一下hdfs文件系统的总结,到现在我们已经把hadoop的,hdfs的部分都说完了.

那么在hadoop的hdfs的部分,哪些部分比较重要,我们总结一下

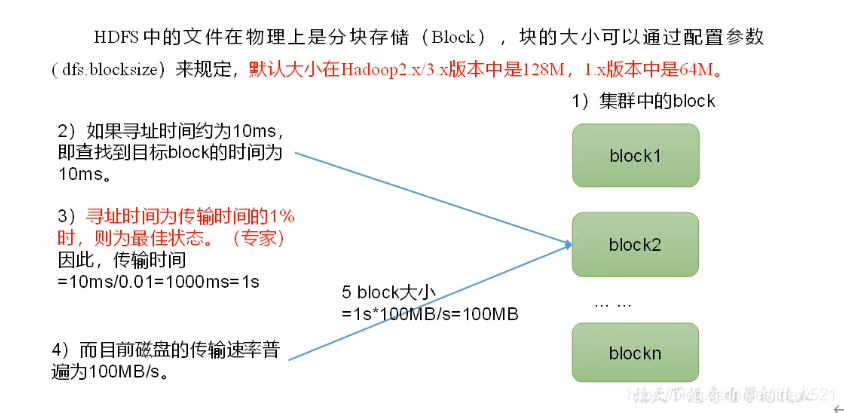

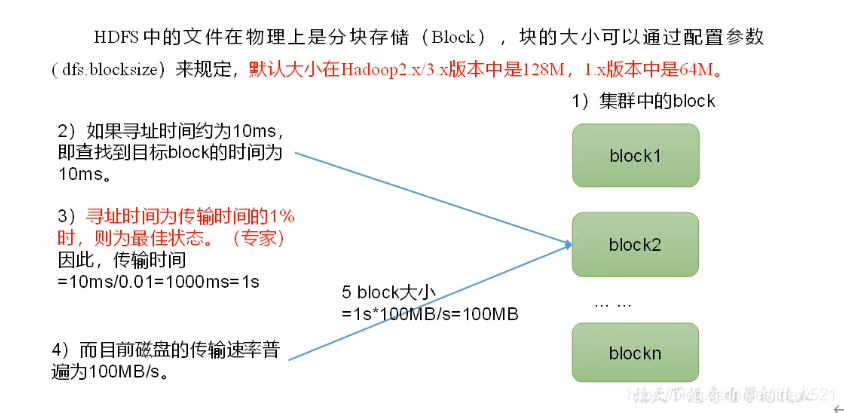

可以看到对于hdfs文件块的配置

原则就是硬盘读写的速度快,HDFS的文件块就可以设置的大一些,如果硬盘读写速度慢,

文件块就可以设置的小一些.,一般在公司里,大公司设置成256m,中小公司设置成128m

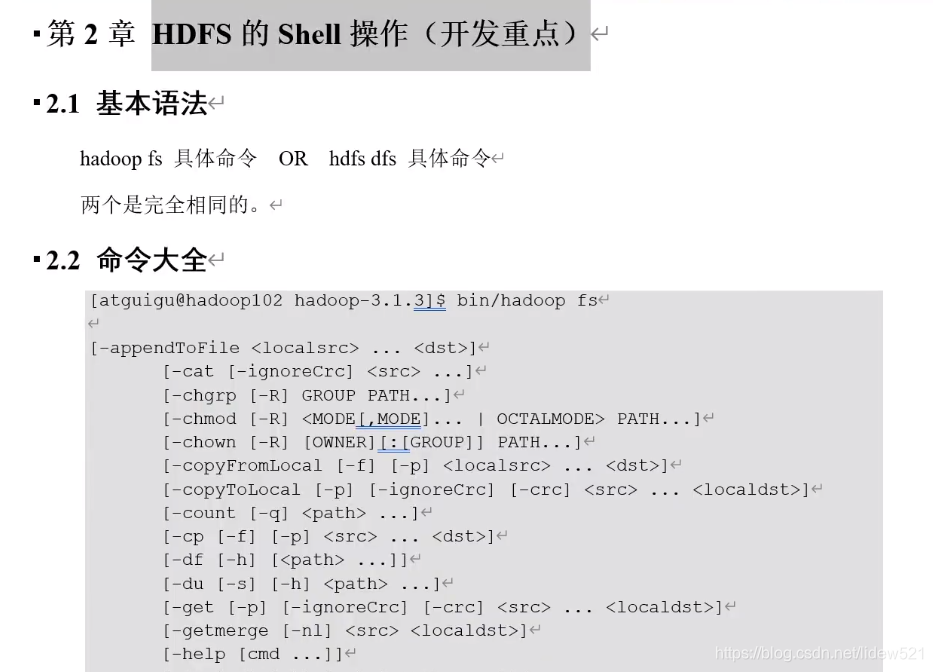

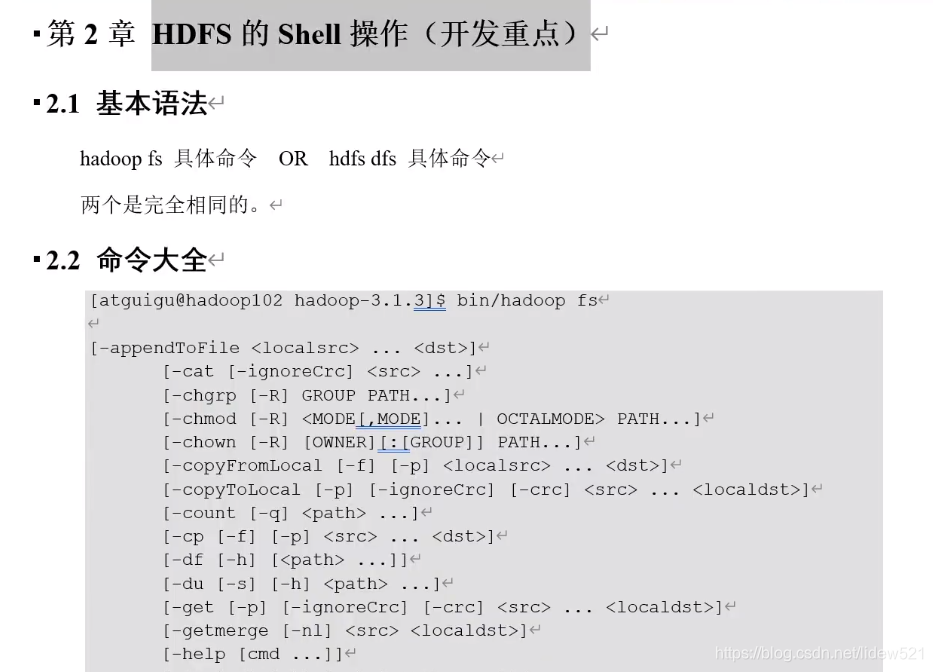

还有就是这个hadoop dfs 的相关命令一定要记住这个重要,

然后我们再去看一下hdfs文件系统的总结,到现在我们已经把hadoop的,hdfs的部分都说完了.

那么在hadoop的hdfs的部分,哪些部分比较重要,我们总结一下

可以看到对于hdfs文件块的配置

原则就是硬盘读写的速度快,HDFS的文件块就可以设置的大一些,如果硬盘读写速度慢,

文件块就可以设置的小一些.,一般在公司里,大公司设置成256m,中小公司设置成128m

还有就是这个hadoop dfs 的相关命令一定要记住这个重要,

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?