一、岭回归

岭回归可以弥补线性回归的不足,它引入了正则化参数来”缩减”相关系数,可以理解为对相关系数做选择。当数据集中存在共线性的时候,岭回归就会有用。

让我们加载一个不满秩(low effective rank)数据集来比较岭回归和线性回归。秩是矩阵线性无关组的数量,满秩是指一个 m×n 矩阵中行向量或列向量中线性无关组的数量等于 min(m,n)。

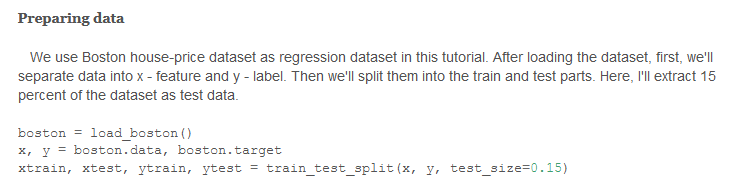

1、准备数据

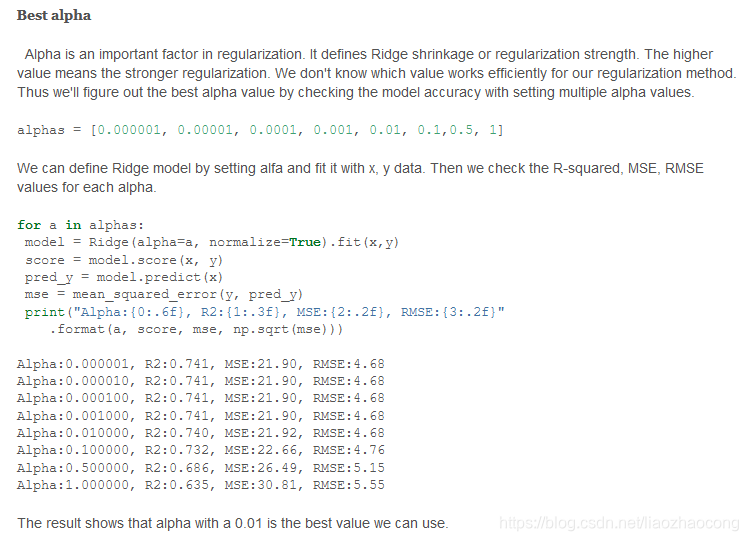

2、最佳alpha

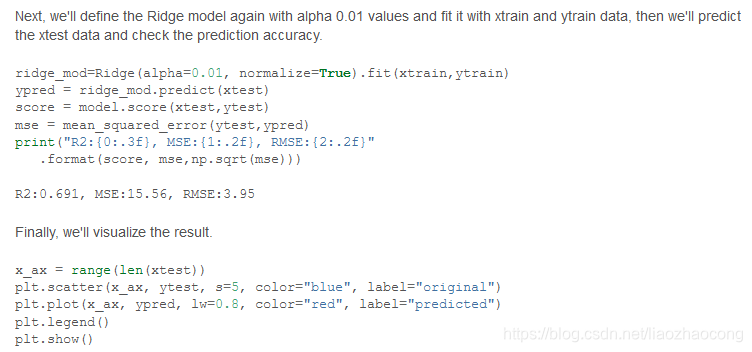

3、训练模型与检查结果

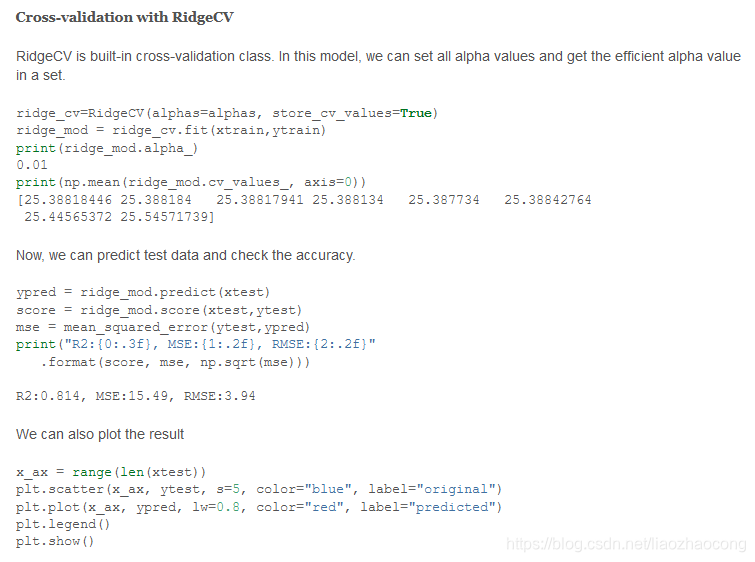

4、利用岭回归交叉验证

5、源码

from sklearn.datasets import load_boston

from sklearn.linear_model import Ridge, RidgeCV

from sklearn.metrics import mean_squared_error

from sklearn.model_selection import train_test_split

import matplotlib.pyplot as plt

import numpy as np

boston = load_boston()

x, y = boston.data, boston.target

xtrain, xtest, ytrain, ytest = train_test_split(x, y, test_size=0.15)

alphas = [0.000001, 0.00001, 0.0001, 0.001, 0.01, 0.1,0.5, 1]

for a in alphas:

model = Ridge(alpha=a, normalize=

本文深入探讨了岭回归在处理共线性数据时的优势,并通过实例展示了如何在Python中进行岭回归的实现。内容包括数据准备、最佳正则化参数alpha的选择、模型训练及检查、交叉验证的应用,以及使用RidgeCV和LassoCV调整正则化参数。

本文深入探讨了岭回归在处理共线性数据时的优势,并通过实例展示了如何在Python中进行岭回归的实现。内容包括数据准备、最佳正则化参数alpha的选择、模型训练及检查、交叉验证的应用,以及使用RidgeCV和LassoCV调整正则化参数。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5304

5304

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?