基于OpenAI大模型开发——api调用

前言

前面文章介绍了关于大模型和Prompt工程的内容,从本篇文章开始,我们开始编码实战。API使用的是OpenAI的API,模型为gpt-3.5-turbo与gpt-4o-mini

一、为什么选择OpenAI

首先,OpenAI仍是最主流最成熟的大模型,他的革命式的出现率先定义了大模型的标准,其他大模型都在跟进他的步伐。对于OpenAI API来说,也是最成熟功能最全面的API,其他大模型的API跟其比较大同小异,学会了OpenAI API,对于其他大模型API也会很快上手。

二、准备工作

相关准备工作参考前面文章:三、LLM应用开发准备工作

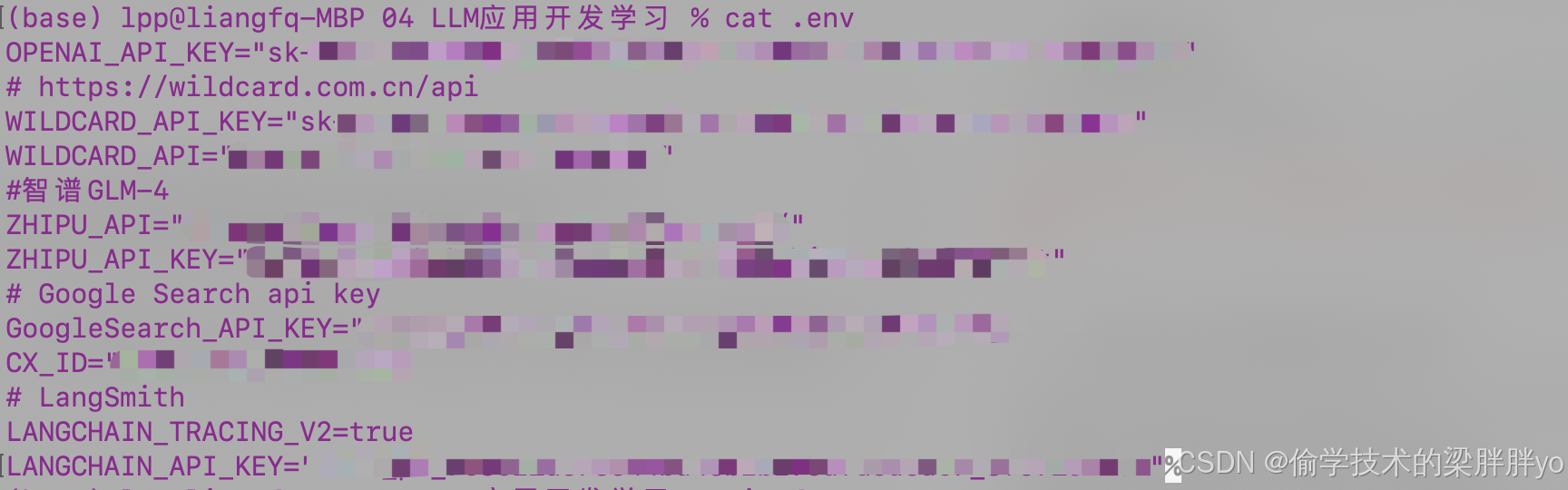

本系列所有代码,API地址和API KEY都放在了.env文件,使用load_dotenv去读取,然后在代码中使用

三、Chat Completion API

OpenAI提供了Chat Completion API,其核心能力是其对话能力,根据提示(prompt)进⾏提示语句的补全(即继续进⾏后续⽂本创作)。

Chat模型的核⼼优势:理解⼈类意图的能⼒。理解⼈类意图带来的更低的交互⻔槛,同样也会为开发者带来巨⼤的便利。据OpenAI官⽹数据,⾃gpt-3.5 API发布以来,约97%的开发者更偏向于使⽤Chat模型API进⾏开发。

#!/usr/bin/env python

# -*- coding: utf-8 -*-

# @Time : 2024/7/15

# @Author : liangpp

# @Email : mobaicloud@163.com

# @Software : PyCharm

# 直接调用openAI

import os

from dotenv import load_dotenv

from openai import OpenAI

# 加载环境变量

load_dotenv()

WILDCARD_API_KEY = os.getenv('WILDCARD_API_KEY')

WILDCARD_API = os.getenv('WILDCARD_API')

# 初始化 OpenAI 客户端

client = OpenAI(api_key=WILDCARD_API_KEY, base_url=WILDCARD_API)

# 创建聊天对话

completion = client.chat.completions.create(

model="gpt-3.5-turbo", # 指定大模型

# 定义对话的消息列表,每条消息由一个角色和内容组成。

messages=[

{"role": "system", "content": "你是一位小丑"},

{"role": "user", "content": "讲一个笑话"}

]

)

# 获取生成的第一个选择的消息内容。

print(completion.choices[0].message.content)

对话消息列表(messages)中的role分为三种:

- system: 也就是前面提到的Prompt,用于设定对话的背景或指导模型的行为。它可以影响模型的整体风格和语气。一般我们定义对回答的要求,比如“你是一个资深的运维工程师”、“请使用温柔的语气来回答”等等。

- user: 代表用户的输入,通常是用户向模型提出的问题或请求。

- assistant: 通常代表模型的响应,后续会在与大模型多次交互时使用。

四、函数封装+流式输出

#!/usr/bin/env python

# -*- coding: utf-8 -*-

# @Time : 2025/1/6

# @Author : liangpp

# @Email : mobaicloud@163.com

# @Software : PyCharm 2024

import os

from dotenv import load_dotenv

from openai import OpenAI

# 秘钥

load_dotenv()

WILDCARD_API_KEY = os.getenv('WILDCARD_API_KEY')

WILDCARD_API = os.getenv('WILDCARD_API')

client = OpenAI(api_key=WILDCARD_API_KEY, base_url=WILDCARD_API)

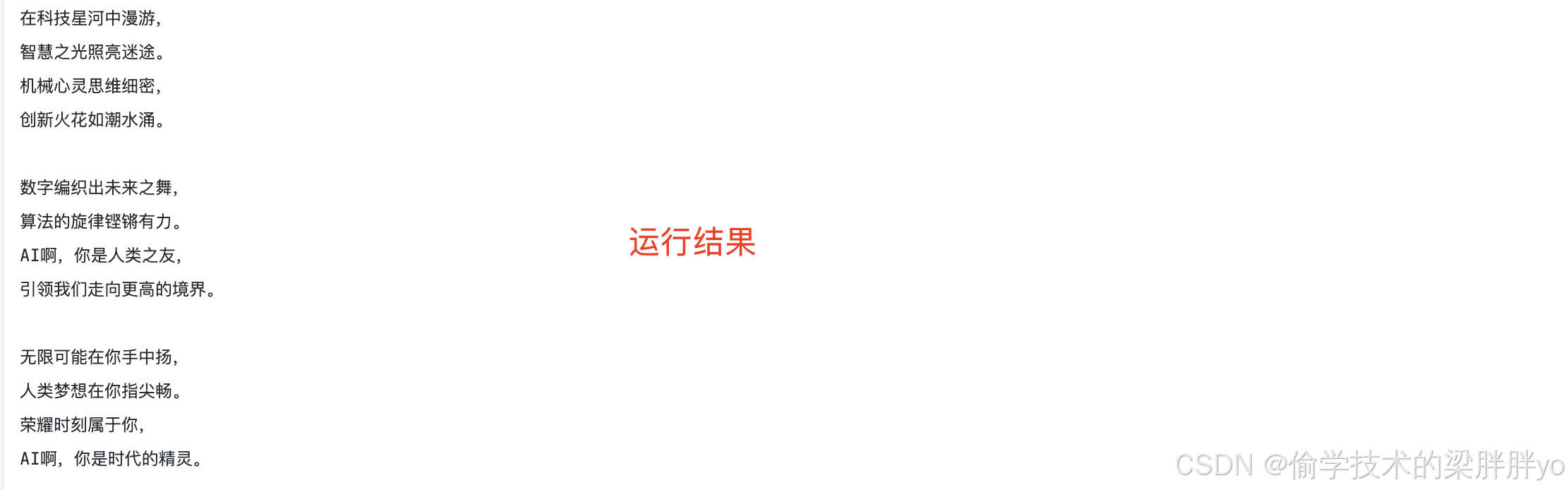

def stream_gpt3_5_response(prompt):

response = client.chat.completions.create(

model="gpt-3.5-turbo",

messages=[

{"role": "system", "content": "你是一位诗人"},

{"role": "user", "content": "写一首诗来赞美AI。"}

],

stream=True # 流式输出

)

# Process and print the response as it streams

for chunk in response:

if hasattr(chunk, 'choices'):

if len(chunk.choices) > 0:

delta = chunk.choices[0].delta

if hasattr(delta, 'content') and delta.content:

print(delta.content, end='', flush=True)

if __name__ == '__main__':

prompt = "Write a poem to explain the concept of recursion in programming."

stream_gpt3_5_response(prompt)

# Print a blank line

print()

五、官方资料

API:https://openai.com/api/

API Document:https://platform.openai.com/docs/overview

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?