目录

LeNet网络实战

import torch

from torch.utils.data import DataLoader

from torchvision import datasets

from torchvision import transforms

from torch import nn

from lenet5 import Lenet5

from torch import optim

def main():

batch_size=32

cifar_train=datasets.CIFAR10('cifar',True,transform=transforms.Compose([

transforms.Resize((32, 32)),

transforms.ToTensor()

]),download=True)

cifar_train=DataLoader(cifar_train,batch_size=batch_size,shuffle=True)

cifar_test = datasets.CIFAR10('cifar', False, transform=transforms.Compose([

transforms.Resize((32, 32)),

transforms.ToTensor()

]), download=True)

cifar_test = DataLoader(cifar_train, batch_size=batch_size, shuffle=True)

x,label=iter(cifar_train).next()

print('x:', x.shape, 'label:', label.shape)

model.train()

device = torch.device('cuda')

model = Lenet5().to(device)

# CrossEntropyLoss进行交叉熵运算(包括了softmax计算),判断多分类问题中预测试与真实值的差距

criteon = nn.CrossEntropyLoss().to(device)

optimizer = optim.Adam(model.parameters(), lr=1e-3)

print(model)

for epoch in range(1000):

for batchidx,(x,label) in enumerate(cifar_train):

# x [b, 3, 32, 32]

# label [b]

x, label = x.to(device), label.to(device)

logits=model(x)

# logits: [b, 10]

# label: [b]

# loss: tensor scalar

loss = criteon(logits, label)

# backprop

#先将梯度清零,再进行反向传播,再进行梯度更新

optimize

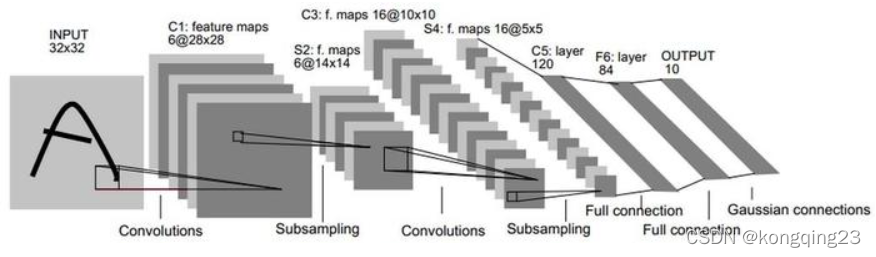

这篇博客介绍了PyTorch中卷积神经网络的实战应用,包括LeNet和ResNet两种经典网络结构的实现,并详细讲解了训练函数的构建过程。

这篇博客介绍了PyTorch中卷积神经网络的实战应用,包括LeNet和ResNet两种经典网络结构的实现,并详细讲解了训练函数的构建过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

318

318